卡帕西解锁大模型新玩法,构建个人知识库,“大部分Token已经不跑代码了”

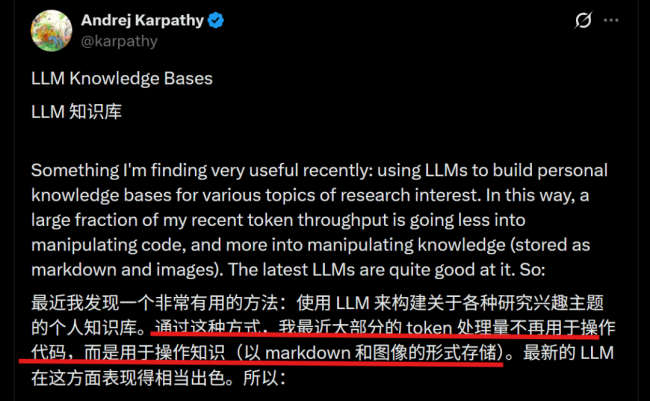

近期,人工智能领域再次迎来技术革新,卡帕西(假设为开发者或团队名)通过其最新探索,展示了大模型应用的新玩法:构建个人知识库。这一技术方向的转变意味着,大模型不再仅仅用于代码生成或通用语言任务,而是逐步转向更精准、更私密的知识管理与个性化应用。

技术背景与演变

- 随着大语言模型的发展,训练和推理成本成为关键问题。

- 当前,许多大模型应用中,“大部分Token已经不跑代码了”,而是用于检索和处理知识库中的信息。

- 这一趋势反映了模型应用场景的成熟化,从“生成一切”转向“理解并回答特定问题”。

卡帕西的知识库方案解析

卡帕西提出了一种基于大模型的高效知识库构建与检索机制,主要特点包括:

- 本地化存储:将用户自定义的知识资料进行编码存储,避免云端依赖。

- 个性化检索:通过自然语言查询,实现对知识库的智能检索和上下文理解。

- 模型自我蒸馏优化:利用模型自身的历史输出进行再训练,如GTR-Turbo所示,训练成本降低一半,推理速度大幅提升。

- 轻量化部署:支持在移动设备或边缘设备上运行,提升应用场景灵活性。

实际应用场景

这种知识库系统具有广泛的实用性,涵盖多个领域:

- 教育:学生可以构建自己的笔记知识库,模型充当“私人助教”进行问答和解释。

- 企业:员工使用模型快速检索公司内部文档、会议记录或项目历史。

- 科研:研究人员构建领域专属知识图谱,辅助文献检索和实验记录管理。

- 日常:普通人也能将个人经验、旅行攻略、生活技巧等整理为可交互的知识体系。

行业影响与未来展望

- 减少对通用模型的依赖:通过本地知识库,用户无需频繁调用API,降低运营成本。

- 提升隐私与安全性:数据不上传云端,确保了知识内容的私密性和可控性。

- 推动“模型+知识”双轮驱动模式:未来,模型的泛化能力和知识库的精准性将共同成为AI应用的核心支柱。

- 进一步普及AI终端应用:轻量模型配合高效知识检索,加速了AI在手机、平板等个人设备上的落地。

技术挑战与应对策略

尽管前景广阔,构建高质量的个人知识库仍面临多项挑战:

- 数据质量控制:用户上传的内容可能包含噪声或错误信息,需要模型具备纠错和过滤能力。

- 实时更新机制:知识库需要动态更新,以保持与用户认知同步。

- 跨语言与跨模态支持:支持文本、图像、音频等多种信息形式的统一检索是下一步方向。

- 用户交互体验优化:如何让知识库更易用、更“懂用户”,是提升落地率的关键。

卡帕西的这一创新为大模型的个性化应用提供了新思路,标志着AI技术从“通用智能”向“场景智能”迈进的重要一步。随着更多厂商跟进,知识库驱动的大模型将成为智能助理、教育、医疗等领域的核心基础设施。