AI幻觉不可怕,最可怕的是老板出幻觉

AI幻觉的技术背景

AI幻觉(AI Hallucination)指的是人工智能系统在生成内容时,出现看似合理但实际错误或虚构的信息。这种现象在大型语言模型中尤为常见,尤其是在训练数据不充分或语境理解受限的情况下。根据Anthropic最近针对8万名Claude用户的调查显示,幻觉问题已经成为用户最关心的技术障碍之一。

- 生成式AI在理解上下文时可能产生逻辑偏差。

- 幻觉内容可能误导使用者,影响决策质量。

- 在医疗、法律、学术等专业领域,AI幻觉可能带来严重后果。

老板的“幻觉”现象

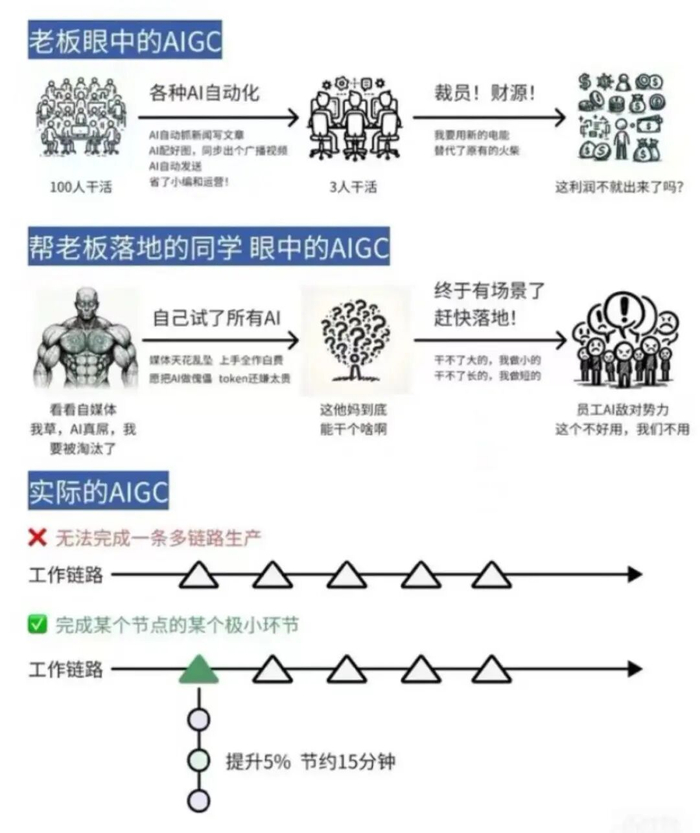

比起AI模型本身,更大的风险往往来自企业老板对AI技术能力的误判。很多管理者在没有深入理解AI运作机制的情况下,产生了一种“技术万能”的幻觉。

常见的老板AI幻觉包括:

- “一键自动化”幻想:误以为只要部署AI工具,所有流程都能立刻自动化。

- “单兵作战”误判:相信一名会使用AI的员工可以顶替整个团队,忽视了协作与专业分工的重要性。

- “快速变现”预期:期待AI能在短期内带来巨大的利润增长,忽略了技术落地所需的时间与调整。

这种“老板幻觉”往往导致资源配置不合理、项目目标脱离实际,最终可能造成团队士气低落、项目失败甚至经济损失。

老板幻觉对团队的影响

老板对AI的过度幻想不仅会扭曲战略方向,还可能对团队结构、员工心理和企业文化造成深远影响。

- 团队可能被裁撤或重组,基于AI“替代人力”的误判。

- 员工压力增大,被迫承担超出能力范围的任务。

- 技术被滥用,忽视实际业务逻辑,造成系统性风险。

此外,这种不切实际的期待也会让企业在市场中失去竞争力,因为忽视了AI需要结合人类经验与判断才能发挥最大价值。

幻觉问题在专业领域的风险

当AI幻觉发生在普通对话或文案生成中,可能只是闹个笑话。但在专业领域,其影响则可能极为严重。

举例:

- 法律领域:AI生成的合同条款若出现幻觉,可能引发诉讼与法律责任。

- 医疗行业:AI若提供错误的诊断建议或药物信息,可能危及患者生命。

- 学术研究:AI生成的论文引用或数据若不准确,将破坏研究可信度。

- 企业决策:基于AI分析的市场预测若失真,可能导致战略误判。

更可怕的是,如果企业决策者对AI输出盲目信任,幻觉问题将不再只是技术层面的“小错误”,而可能演变为系统性的管理灾难。

理性看待AI:从幻觉到现实

要避免AI幻觉与老板幻觉的双重风险,企业和管理者需要从以下几方面入手:

- 加强AI素养培训:提升管理层对AI技术的理解,避免盲目信任与误用。

- 建立审核机制:AI输出内容需经过人工复核,尤其在关键决策环节。

- 合理设定目标:将AI视为辅助工具,而非万能解决方案,设定实际可行的应用场景。

- 重视人机协同:AI无法替代专业经验、情感判断与伦理考量,应强化人机协同而非替代。

只有正视AI的局限性,并建立科学的认知与管理机制,企业才能真正发挥AI的价值,避免“幻觉”带来的负面影响。