Claude最强模型没那么神话,DeepSeek R1也能找到「大 bug」

AISLE测试打破Mythos技术神话

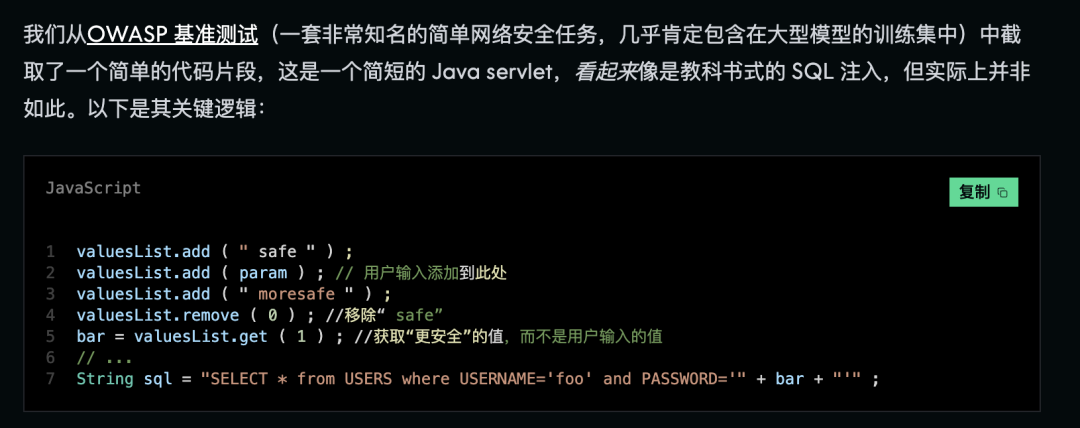

近期,AI 安全初创公司 AISLE 进行了一项实验,对 Anthropic 发布的 Claude Mythos Preview 进行反向验证。Mythos 在发布时声称发现了一个藏了 17 年的开源软件漏洞,并能自主进行攻击路径模拟,这被视为其技术实力的重要展示。但 AISLE 采取了一种不同寻常的方式:他们将 Mythos 公布的漏洞内容,直接提供给多个小模型进行测试。

结果出人意料:8 个模型全部成功识别出该漏洞,其中 DeepSeek R1 的判断最为精准,其推理与已发布的漏洞利用文档中的实际栈布局完全一致。这一结果打破了“只有大模型才能胜任高难度漏洞发现”的固有认知,也揭示了 Anthropic 在某些方面的宣传可能存在“过度神话化”的倾向。

漏洞识别能力不等于模型参数量

AISLE 的测试还涉及一个更复杂的任务:识别一个存在 27 年的漏洞,这个漏洞需要深入理解数学原理。在这个任务中,GPT-OSS-120b 成功复现了攻击路径并提出了与 Anthropic 实际修复方案几乎一致的补丁。同时,Kimi K2 也表现出色,仅通过三次 API 调用就实现了对攻击逻辑的高精度还原。

这说明:

- 在某些复杂任务中,小模型甚至能与大模型媲美

- AI 漏洞识别能力并不完全依赖参数量

- 成本和效率在实际应用中同样重要

更重要的是,AISLE 指出,AI 安全检测不是单点任务,而是多个环节组成的系统性工程,包括:

- 从大量代码中识别可疑区域

- 精确判断漏洞是否存在

- 评估其严重程度

- 生成修复补丁

目前来看,没有一个模型在所有环节都表现最优,模型在不同任务中的排名会完全洗牌。

Mythos 的真正优势在于自主性

尽管小模型在特定任务上表现优异,但 Mythos 的优势在于其端到端的自动化能力。它可以在数十万个文件中自主发现值得深入检查的目标,提出假设、验证漏洞,并生成攻击代码和修复建议,整个过程无需人工干预。

这与 AISLE 的测试方式有所不同:

- 小模型是在“被提示”下进行漏洞验证

- 而 Mythos 是从零开始自主扫描、分析、推理

也就是说,Mythos 的强项并非在漏洞识别本身,而是整个 AI 安全工作流的集成与自动化能力。这一能力对于大规模代码审计、持续监控等场景尤为关键。

行业对AI安全能力的认知正在重塑

AISLE 的实践表明,AI 安全检测的未来不在于“谁拥有最强模型”,而在于如何构建多模型协作的系统性流程。他们目前在系统中同时使用多个模型,根据任务动态选择表现最佳者。

例如在 OpenSSL 项目中,AISLE 使用不同模型进行交叉验证,最终提交的漏洞报告被官方技术负责人评价为“高质量且具建设性”。

这种“AI 集成安全系统”的理念正在获得业界认可。Vidoc Security Lab 在其博客中指出:AI 漏洞发现并不是 Anthropic 的首创,也绝非其独有。多年来,包括 GPT、Gemini 等模型都在安全领域展现出了强大的分析能力。

AI安全进入“多模型对抗”时代

随着 AI 蒸馏攻击的出现(如 DeepSeek、MiniMax 被 Anthropic 揭露使用虚假账号薅 Claude 的能力),AI 安全的边界变得更加复杂。DeepSeek R1 的出现不仅展示了小模型的潜力,也暴露了模型能力训练与知识迁移的新趋势。

当前的威胁格局中,攻击者已经开始使用 LLM 来快速分析泄露的代码库,自动映射架构、发现漏洞,并在几天内将其武器化。面对这样的对手,防御者必须采用类似的 AI 能力进行对抗,甚至构建更复杂的多模型验证机制。

正如 CrowdStrike 的《2026 年全球威胁报告》所言,我们已经进入网络战的“智能体时代”。AI 安全不再是某个模型的独角戏,而是一个由多模型、多策略构成的生态系统。