Claude Code大泄露:别光Clone了,当今最顶Harness开源了

背景

随着大语言模型(LLM)在人工智能领域的重要地位日益突出,围绕其开发、部署与安全问题的关注也持续升温。2022年ChatGPT发布以来,LLM成为推动系统智能化升级的核心技术,各大企业和开源社区纷纷投身于相关模型的研发与开源项目构建。在这一背景下,近期发生的Claude Code源码泄露事件引发了广泛关注,同时也为一些新项目的崛起提供了契机,例如开源可商用的大规模预训练语言模型Harness。

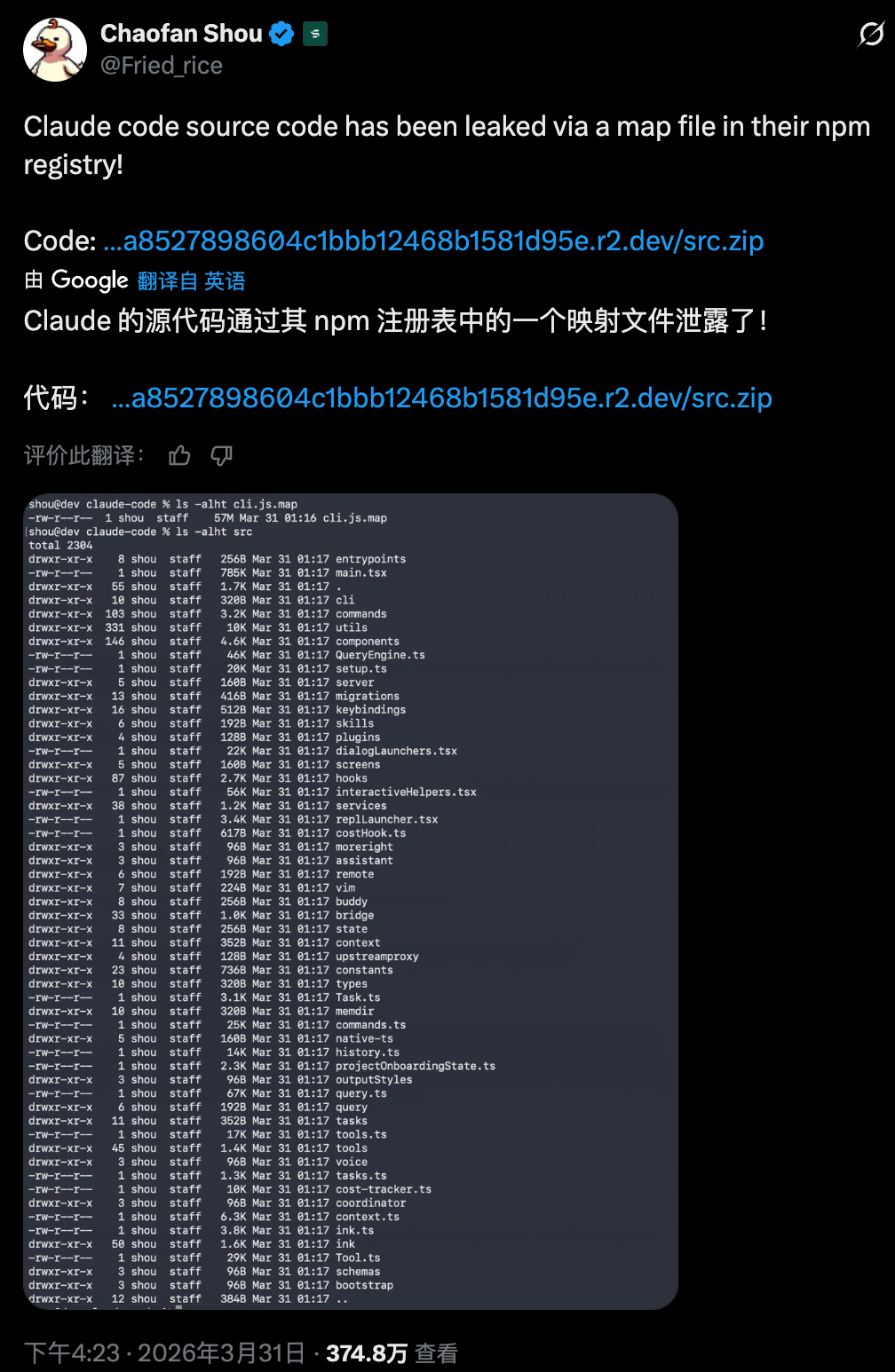

Claude Code源码泄露详情

近日,Claude Code的map文件意外泄露,导致其部分源码暴露于网络。据用户反馈,有开发者从npm包中下载了相关文件并进行分析,其中涉及系统提示(system prompt)等内容。这一泄露事件不仅揭示了Claude Code内部结构和设计细节,也让社区对大模型的开发和安全保护机制产生更多讨论。

尽管此次泄露的内容尚未完整披露整个模型的全部代码,但其引发的连锁反应已经显现。社区中关于是否应直接“Clone”现有模型代码的争议不断,同时也促使人们开始关注更具开放性和可操作性的替代方案。

Harness开源模型的优势

在Claude Code事件引发讨论的同时,Harness作为一个新兴的开源大模型平台,逐渐进入公众视野。Harness是一个开源可商用的大规模预训练语言模型,基于Transformer架构,在大约1.2万亿词元上训练,具备70亿参数。该模型支持中英文双语,并拥有长达4096的上下文窗口长度,使其在处理复杂任务和多语言场景中表现优异。

Harness的设计目标是提供一个灵活、可扩展的模型,方便企业和开发者在各类应用场景中使用。其开源性质意味着用户不仅可以自由地克隆和修改代码,还能基于该模型构建商业产品,而无需担心潜在的版权问题。这种开放的策略在当前对大模型安全性和合规性日益关注的环境下,显得尤为关键。

影响与启示

Claude Code的泄露事件和Harness的开源发布,形成了鲜明的对比。前者暴露了封闭模型在开发和发布过程中可能面临的安全隐患,而后者则展现了开源生态在推动AI技术普及方面的巨大潜力。

- 模型安全问题凸显:泄露事件提醒企业和开发者,必须加强对大模型源码和数据的保护,尤其是在部署到生产环境前,需要有完善的安全机制和访问控制。

- 开源模型更具吸引力:Harness的发布为开发者提供了更透明、更灵活的选择。开源社区的协作机制可以加速模型优化与迭代,同时降低商业应用门槛。

- 推动AI生态健康发展:Harness的出现或将促进更多开源项目涌现,为整个AI领域带来新的活力,减少对单一模型的依赖,推动技术多样化发展。

未来展望

开源语言模型的兴起标志着AI技术正在走向更加开放和共享的发展模式。Harness的成功不仅为开发者提供了一个新的选择,也为开源社区带来了更多信心。随着开源模型在性能、训练数据和应用场景上的不断优化,它们有望成为推动AI技术进步的重要力量。

NVIDIA等科技巨头也在推动桌面级AI算力下沉,例如其DGX系列平台结合NemoClaw开源栈,为企业和开发者打造了完整的智能体全流程开发环境。未来,开源模型与高性能计算平台的结合,将为AI行业带来更多可能性。

总之,Claude Code的泄露事件虽然引发了短期争议,但也促使行业重新思考开源与闭源模型的利弊。Harness等开源项目的崛起,或许正是AI技术迈向更广阔应用场景的重要一步。