从AI监管到内容生态重构:平台正在重新定价“真实”

背景:AI“入侵”内容创作,真实感渐失

生成式AI工具,如ChatGPT、DeepSeek、Claude等,正在以惊人的效率接管内容创作的多个领域。无论是知乎、微博、豆瓣还是B站,AI生成的内容正在悄然侵蚀用户对“真实”的感知。

- 从新闻稿到小红书攻略,AI都能快速生成逻辑自洽、语句工整的内容。

- 问题在于,这些内容“看起来都对”,却缺乏真实的情感和个性化的经历。

- 用户开始对千篇一律的AI写作风格感到“轻微不适”,社区内容逐渐趋同化。

AI内容的大量涌现并非偶然,而是由技术门槛降低、工具集成度提升和商业场景驱动所共同促成。

平台的矛盾:流量红利与信任危机的拉锯

AI内容在短期内为平台带来巨大的流量和用户活跃度,但长期来看,却可能造成社区质量的下滑和用户信任的流失。

- 平台享受AI带来的“低成本高流量”,但也开始意识到,这种模式正在侵蚀内容生态的核心价值。

- 如果AI内容无法被有效标识,用户会误以为这些是人类创作,导致信任瓦解。

- 内容泛滥的另一面是“知识含金量”下降,信息看似丰富,实则重复堆叠、缺乏深度。

平台必须重新校准激励机制,不能只奖励“关键词堆砌”或“冷血公式内容”,而应扶持有观点、有情感、有原创性的内容创作。

法规监管:AI内容的身份标识成为关键

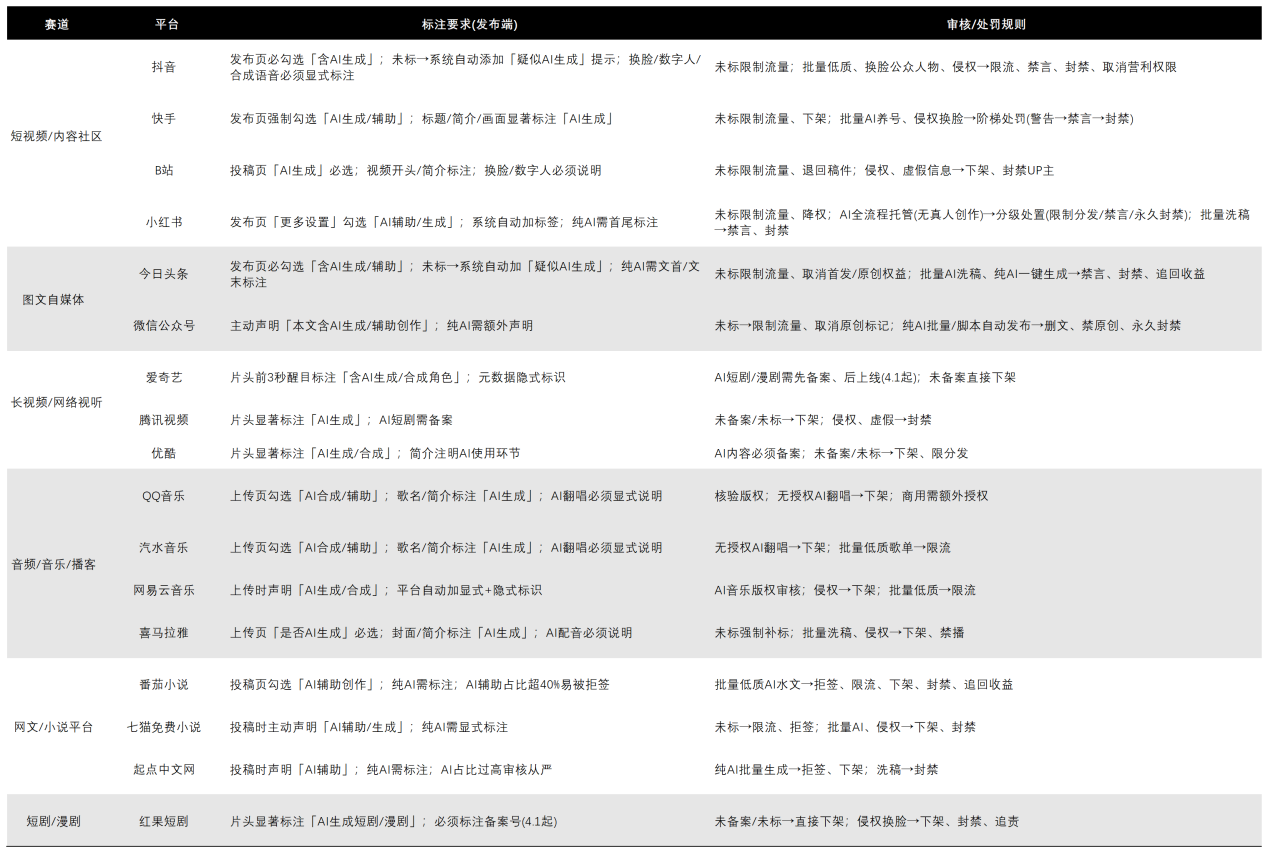

中国已开始对生成式AI进行立法监管,要求AI生成内容必须明确标注来源,以避免“伪装成真人”的误导现象。

- 《生成式人工智能服务管理暂行办法》和《人工智能生成合成内容标识办法(征求意见稿)》推动AI内容透明化。

- 平台需建立内容分类标签制度,类似“广告”“转载”等标识,AI生成内容也应明确标注。

- 此外,AI服务提供者还需履行数据安全、隐私保护、知识产权等多方面义务。

AI内容不应被视为“原罪”,但隐藏其来源、模糊其身份,却会动摇信息生态的基础。透明标识是重建用户信任的第一步。

人机协作:内容创作的未来不是替代,而是“升级”

AI不是要取代人类写作,而是为内容创作提供新的工具和范式。关键在于如何构建“人机协同”的机制。

- 有效的模式应是“AI草拟 + 人类判断 + 真实经验”三位一体。

- AI负责语言生成、结构构建、数据整理;人类负责注入观点、情绪、真实经历。

- 例如,爆款文章、科普视频的背后,往往有AI辅助构思,但核心创意仍由人类完成。

未来的优质内容,不再是AI单打独斗,也不是人类闭门造车,而是人机深度协作的结果。

重构内容生态:从制度、算法到文化

面对AI内容的冲击,仅靠技术或监管是不够的。需要从平台制度、算法机制到内容文化进行系统性重构。

- 制度层面:强制AI内容标识,明确版权归属,推动AI内容生产者合规备案。

- 算法层面:平台需优化推荐机制,减少AI流水线内容的曝光权重,鼓励原创与深度。

- 文化层面:重建对“真实表达”的推崇,鼓励用户分享“有温度、有心跳”的内容。

AI可以写尽万象,但它写不出你的成长经历、你曾走过的弯路、你深夜哭过的瞬间。而这些,才是互联网最需要的声音。

结语:谁来守住“真实”的边界?

AI内容不会停止,信息爆炸也无法逆转。但在内容生态的重构中,我们需要建立更清晰的边界和更有力的过滤机制。

- 平台必须承担起责任,不能再放任“流量速食垃圾”泛滥。

- 用户也需提高辨别力,识别AI内容,支持真正有人性、有观点的表达。

- AI不应是“替代”,而应是“辅助”;不应是“伪装”,而应是“协作”。

未来的互联网,不是看谁写得多,而是看谁写得真。