Gartner:Token成本下降不会推动前沿智能普及化

背景

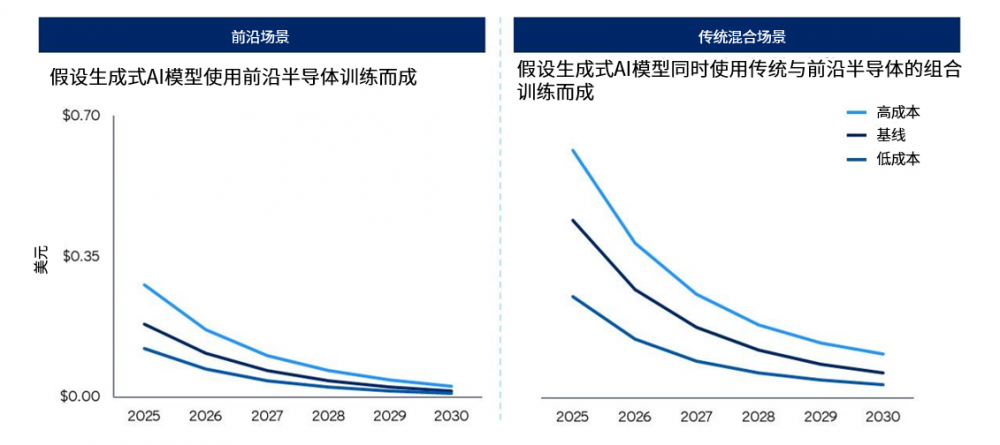

近年来,随着AI技术的快速发展,尤其是大语言模型(LLMs)的广泛应用,企业对于生成式AI和更高级的智能体AI(Agentic AI)的兴趣持续升温。Gartner预测,到2030年,运行万亿参数AI模型的推理成本将比去年下降超过90%。而未来四年内,大语言模型的成本效率有望提升100倍。这种显著的下降主要得益于硬件性能提升、模型结构优化、边缘设备的推理能力增强,以及专用AI芯片的普及。然而,这种成本下降是否意味着前沿AI能力能够广泛普及,仍值得深入探讨。

成本下降背后的结构性变化

-

硬件与芯片的进步

更高效的AI推理芯片(如GPU和TPU的升级版本)显著提升了计算密度和能耗比,降低了单位Token的处理成本。 -

模型设计的优化

通过模型剪枝、量化和蒸馏等技术,大型模型得以在不牺牲性能的前提下缩小规模,从而减少Token的消耗。 -

边缘设备推理普及

本地化推理(如手机、IoT设备上的模型运行)减少了云端调用,进一步压低了整体成本。

尽管如此,这些技术进步主要惠及了通用AI能力,如简单的文本生成或基础客服问答。而更复杂的AI应用,例如智能体助手(AI Agent),每个任务需要的Token数量远超基础生成式AI。

智能体AI的Token成本挑战

智能体AI相比传统的生成式AI具备更高的自主性、多步骤推理和复杂任务执行能力。这种能力的提升意味着:

-

更多Token的消耗

智能体在执行任务时通常需要多次交互、自我修正和上下文保持,每个任务可能消耗比传统模型高5到30倍的Token。 -

错误循环的风险

多个智能体之间的协作可能会产生错误的反馈循环,导致无效甚至有害的输出,从而增加调试与管理成本。 -

企业端的成本压力不减

虽然单位Token价格下降,但任务复杂度的提升抵消了成本节约,甚至在某些场景中总成本反而上升。

Will Sommer,Gartner高级总监分析师指出:“Token成本在下降,但许多顶尖AI实验室仍在亏损,他们通过提升效率来控制成本,而客户并不一定能感受到价格下降带来的直接利益。”

企业应如何应对成本与价值的矛盾

在Token成本结构发生变化的背景下,企业CIO和CPO需要重新评估其AI投资策略:

-

平衡低价值与高价值应用

简单的生成式AI功能(如文本摘要、内容填充)将变得近乎免费,但若企业希望构建具有差异化竞争力的智能体系统,就必须接受更高的Token支出。 -

提升AI能力的复杂性与价值密度

为了从Token支出中获得更高的回报,企业需要将AI部署到更具价值的场景中,例如自动化决策流程、智能调度系统或深度个性化服务。 -

采用混合模型与开源策略

开源模型(如Llama系列)因其可定制性和成本优势,成为中小企业和数据敏感行业的首选。通过微调和本地部署,企业可以在保障数据安全的同时控制成本。

Sommer强调:“你不能只是乘着低价值生成式AI的浪潮,也不能一味追求前沿一切。如果你不断朝着前沿发展,你的Token成本将爆炸式增长,以至于你无法在任何时候实现盈利。”

未来展望与企业行动建议

Gartner认为,AI成本下降的趋势将继续,但其价值释放取决于企业的部署策略与技术选型。以下几点是企业在AI变革中应重点关注的:

-

构建“AI就绪”的基础设施

企业需要一个灵活、开放、标准化的IT架构,以支持不同层级AI模型的高效运行,同时防止技术锁定。 -

制定清晰的AI战略路线图

从感知AI、生成式AI逐步向代理式AI演进,需明确每个阶段的投入产出比和风险控制机制。 -

强化AI治理与安全体系

随着模型复杂度和交互频次增加,AI推理的稳定性和安全性成为关键考量,需引入实时检测、模型通信协议等机制。 -

评估自身AI变革就绪度

企业可通过《AI Ready变革评估体系》识别技术短板、组织能力差距和数据治理问题,制定分阶段的优化路径。

未来,AI的发展将不再仅仅是“模型越大越好”或“Token越便宜越好”,而是如何在成本、复杂性与商业价值之间找到最优解。企业必须具备前瞻性的AI部署思维,才能在Token价格下降的浪潮中真正抓住智能变革的红利。