合成数据≠生成模型:一文读懂合成数据的全新范式

随着人工智能技术的飞速发展,数据的获取和质量成为制约模型训练和应用的关键因素之一。合成数据作为解决数据短缺与隐私问题的重要手段,近年来受到广泛关注。然而,传统认知中,合成数据常被等同于生成模型,这种局限性阻碍了其在更多场景中的潜力。最新的研究正重新定义合成数据的边界,引入了包括反演、仿真与数据增强等多种方法,构建了一个更加多元、灵活的合成数据新范式。

背景:合成数据的传统认知与局限

合成数据长期以来被视为生成模型的产物,即通过AI模型生成与真实数据分布相似的数据。这一方式在隐私保护、数据扩展等方面取得一定成效,但也存在明显短板,如生成成本高、质量受限于训练数据、难以适应特定任务需求等问题。

随着AI应用场景的多样化,尤其是在医疗、金融、自动驾驶等领域,高质量、任务导向的数据需求日益增长。仅依赖生成模型已无法满足复杂场景下的数据要求,推动学界和业界重新思考合成数据的本质与方法。

合成数据≠生成模型

这一全新认知打破了传统将合成数据与生成模型绑定的误区。合成数据的生成方式不再局限于生成对抗网络(GANs)或大语言模型(LLMs),而是包括了以下几种方法:

- 反演方法:基于目标模型的输出反向推导输入数据,用于优化模型的训练。

- 仿真建模:通过物理、数学或规则系统模拟真实世界环境生成数据,例如自动驾驶中的场景模拟。

- 数据增强:在已有数据基础上进行变换和扩展,提高数据多样性。

- 混合方法:结合多种合成技术,生成更加贴近任务需求的数据。

这些方法从不同角度补充了生成模型的不足,拓展了合成数据的定义与应用场景。

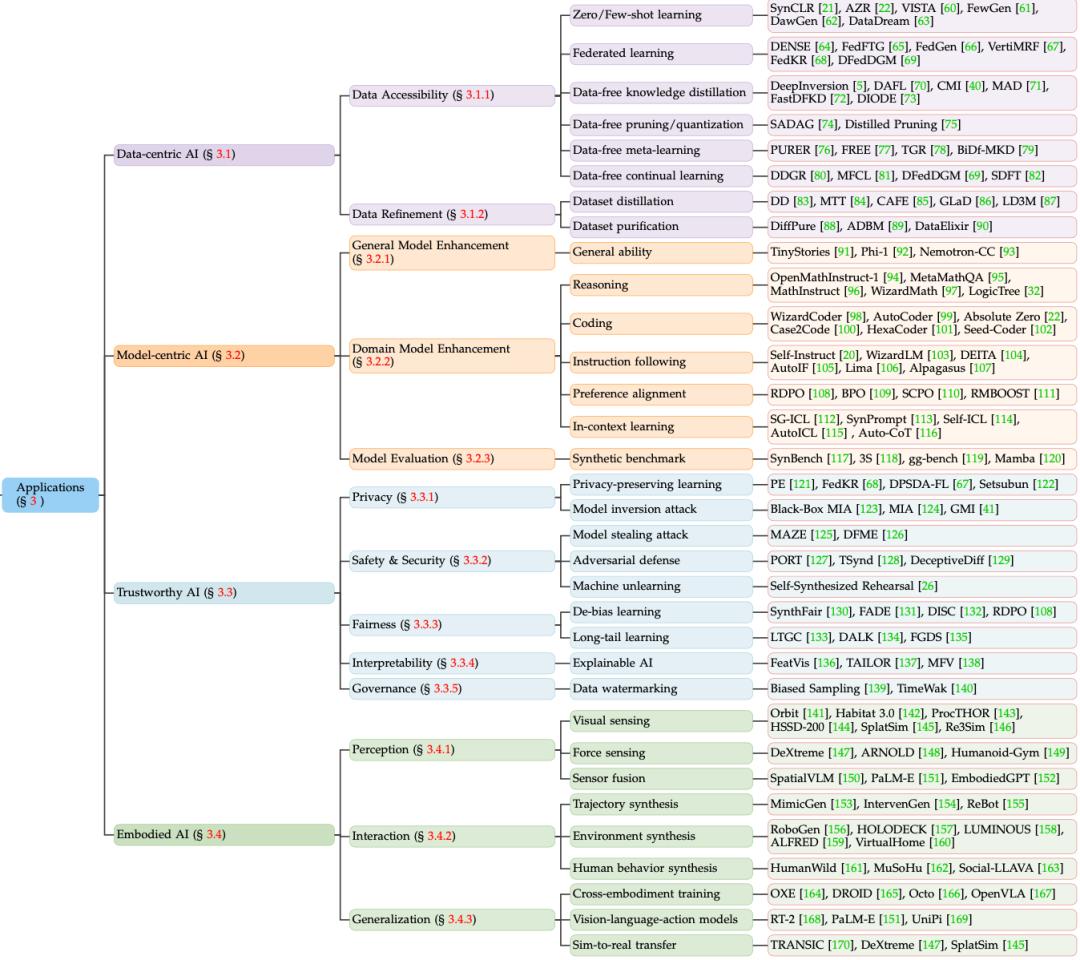

新分类框架:按应用层次划分合成数据

最新研究提出了一种新的合成数据分类框架,从应用层次上将其划分为:

数据中心AI(Data-Centric AI)

强调以数据为核心驱动AI模型性能提升,合成数据在此框架下扮演关键角色。通过精确设计数据分布、质量、多样性,来优化模型训练和泛化能力。

任务层合成数据

聚焦于特定任务的合成,如自然语言处理(NLP)中使用大语言模型生成训练样本,或计算机视觉中通过仿真生成特定光照条件下的图像。该层次的数据合成更注重任务相关性和性能优化。

模型层合成数据

用于测试、验证和调试模型的内部机制。例如,通过反演方法生成对抗样本,评估模型鲁棒性;或通过合成数据解析模型的可解释性问题。

微软等机构的实践:大模型推动合成数据创新

近年来,微软等机构在合成数据领域进行了大量探索。例如,使用GPT-4生成高质量的NLP训练数据,显著提升了模型的性能表现,甚至在某些任务上实现了SOTA(State-of-the-Art)。

这些实践表明,合成数据正在从辅助手段转变为核心数据来源,尤其在缺乏高质量标注数据的场景中表现突出。大语言模型和Agents系统也被广泛应用于合成数据的生成与管理,进一步推动了合成数据的智能化、自动化发展。

适用场景探讨

- 大语言模型(LLMs):用于生成多样化、高质量的文本数据,支持下游NLP任务。

- NLP建模:通过合成数据模拟特定语义或句法结构,提升模型的泛化能力。

- Agents系统:在强化学习等场景中,Agents可主动生成交互数据,加速训练过程。

合成数据的新范式带来的影响

合成数据的全新范式不仅拓宽了其技术实现路径,也对AI发展带来了深远影响:

- 降低数据获取门槛:无需依赖大量真实数据,即可构建有效的训练集。

- 提升模型可控性:通过合成方式精确控制数据分布和特征,有助于提升模型鲁棒性和公平性。

- 加速模型迭代与部署:合成数据可以快速响应模型训练需求,缩短开发周期。

- 促进隐私与合规:避免使用真实用户数据,降低隐私泄露风险。

这一新范式正在重塑AI数据工程的底层逻辑,成为推动AI系统持续优化的重要工具。