华人辍学博士揪出Claude Code 51万行源码泄露,官方请求下架超8000个GitHub代码库并回应:这次是人为失误,无人被解雇

背景:Anthropic 与 Claude Code

Anthropic 是由前 OpenAI 员工创立的人工智能公司,专注于开发高质量、安全可控的 AI 模型。其推出的 Claude Code 是一款面向编程的 AI 工具,具备强大的代码理解与生成能力,是与 GitHub Copilot 直接竞争的产品。

该工具一直以闭源、高安全性著称,因此其核心代码的意外泄露,不仅令技术圈哗然,也动摇了外界对 Anthropic 在安全控制方面领先地位的信任。

事件详情:一次打包失误引发的连锁反应

此次源码泄露源于 Anthropic 在一次版本发布过程中,误将 source map(.map)调试文件打包并发布到 npm 注册表中。该 source map 文件中包含了一个云存储链接,可直接下载完整的 TypeScript 源代码归档。

安全研究员 Chaofan Shou(寿超璠)在检查 npm 包时发现了这一异常。他迅速在 GitHub 上创建了一个名为 instructkr/claude-code 的仓库,将代码镜像并开放给公众研究。该仓库在上线两小时内获得超过五万个 star,创下了 GitHub 上最快获得五万 star 的记录之一。

Anthropic 随后确认事件是“打包环节的人为失误”,强调没有用户数据或凭证泄露,并未追究内部人员责任。Claude Code 的技术负责人 Boris Cherny 也在社交平台 X 上简短回应,称是“开发者的操作失误”。

泄露内容揭示的内部架构与功能

GitHub 上泄露的代码共计超过 51 万行,包含 1900 多个 TypeScript 文件。分析显示,这并非一个简单的 API 封装工具,而是一个完整的生产级开发环境,揭示了 Anthropic 在 AI 编程工具上的深度布局。

泄露代码中包含如下关键模块和功能:

- 权限控制工具:超过 40 个工具模块,支持细粒度的用户权限管理。

- 查询引擎:拥有 4.6 万行代码,用于处理复杂的用户请求与代码分析。

- 多智能体协调系统:支持多个 AI 助手之间的协同与交互。

- IDE 桥接功能:深度集成开发环境,提升开发体验。

- 持久化记忆机制:允许 AI 在多个会话之间保留状态和上下文。

此外,代码中还包含多个未发布的实验性功能:

- BUDDY:AI 电子宠物系统,基于用户 ID 与伪随机算法生成唯一角色,具备类似“拓麻歌子”的互动机制。

- KAIROS:后台行为监控与任务执行系统,支持自动整理记忆(autoDream),将短期对话转化为结构化长期知识,类似于人类睡眠时的记忆巩固。

- 卧底模式(Undercover 开心版e):防止员工在开源贡献中泄露内部模型代号或工具名称。

- 数据投毒机制:通过注入虚假工具定义(fake_tools)干扰模型蒸馏行为。

这些功能的公开揭示,让外界得以窥探 Anthropic 在 AI 助手与数字员工方向上的战略布局。

影响:技术圈狂欢,法律风险隐现

代码泄露后迅速在 GitHub 和 X 上引发广泛讨论。开发者社区将其视为难得的学习机会,许多技术人员连夜分析、还原、测试代码,试图复现其功能。

- 开发者可以“抄作业”:中小开发者可借此快速提升自身产品水平。

- AI Agent 团队受益:代码为行业提供了先进的架构参考,有助于技术路线图的把握。

- 技术方向明确:泄露代码融合了 Prompt Engineering、Context Engineering 和 Harness Engineering,展示了 AI 助手下一步的发展趋势。

然而,法律风险也紧随其后。国浩律师事务所吴俊伶律师指出:

- 泄露代码未获得授权,任何复用、改写、商用行为可能涉及著作权与商业秘密侵权。

- Anthropic 用户协议中明确规定不得使用其服务开发竞品或训练其他 AI 模型。

- 即便部分代码已广泛传播,也不意味着可以合法复制或使用。

因此,尽管技术层面的传播与研究风险较低,一旦进入产品开发或商业用途,将面临复合型法律挑战。

Chaofan Shou:安全圈的“门外汉”传奇

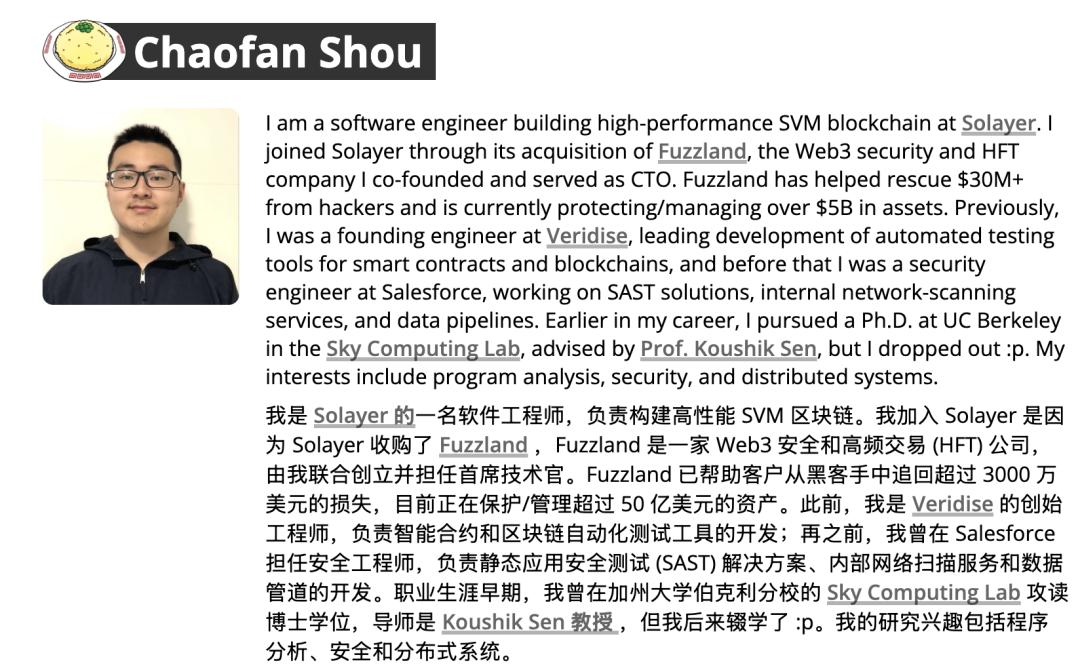

发现此次泄露的 Chaofan Shou(寿超璠)是一位履历亮眼的华人安全研究员,GitHub 用户名为 shouc,X 账号为 @shoucccc。

- 教育背景:2019 年进入加州大学圣塔芭芭拉分校,两年完成本科学业,GPA 满分;后在加州大学伯克利分校攻读博士,后退学创业。

- 职业经历:曾任职 Salesforce、Veridise,2023 年联合创办 Fuzzland 并担任 CTO,该公司后被 Solayer 收购。

- 技术贡献:开发了 ityfuzz 等智能合约安全测试工具,GitHub 累计获得超过 1100 个 star。

- 漏洞赏金:自 2016 年活跃于漏洞披露社区,曾发现 Twitter、Etherscan、Google Nest 等平台的重大漏洞,累计获得赏金约 190 万美元。

- 学术成果:发表于 CCS、ISSTA、CoNext 等顶级会议,Google Scholar 总引用量达 224 次,h-index 为 6。

他在 GitHub 主页自嘲为“senior kiddie”,原本只是调侃自己“技术门外汉”,却意外成为这次事件的揭发者。

Anthropic 的安全信任危机

此次泄露并非 Anthropic 首次出错。就在一周前,该公司刚刚因 CMS 配置错误泄露了内部模型信息和 3000 多份未公开资产。而早在 2024 年底与 2025 年初,Claude Code 也曾发生过源码与系统提示词泄露事件。

这些“人为失误”的频繁发生,正在逐步侵蚀市场对 Anthropic 安全能力的信任。尽管其技术实力和产品方向备受认可,但内部发布流程和安全管理的漏洞,也成为业界质疑的焦点。

Anthropic 虽未因此次事件解雇任何人,但如何强化开发与发布环节的审查机制,将成为其接下来必须面对的挑战。