具身龙虾,上车理想

背景介绍

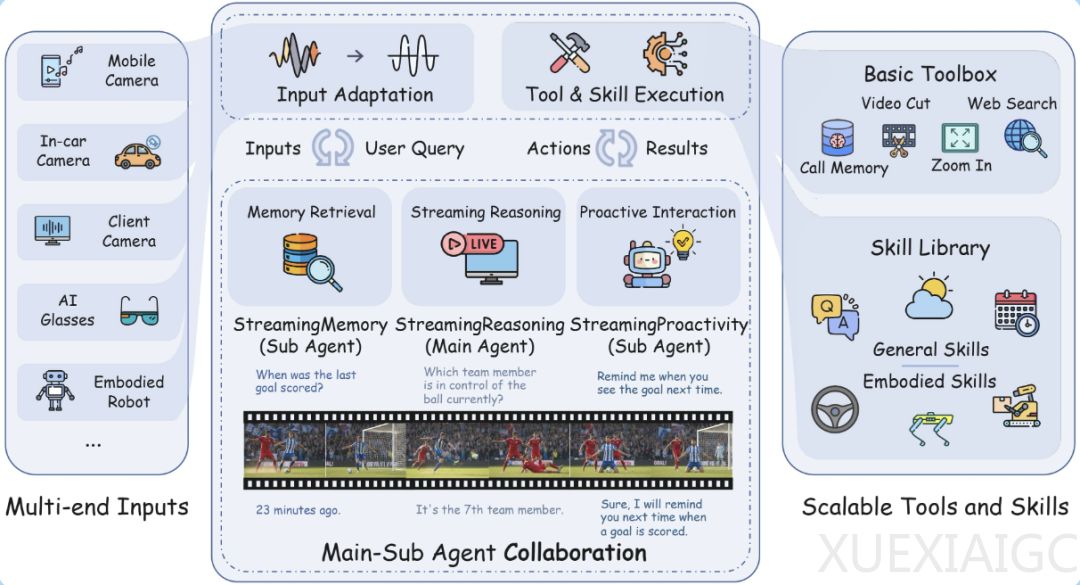

随着人工智能技术的飞速发展,具身智能(Embodied Intelligence)逐渐成为智能汽车领域的重要研究方向。具身智能通过将AI系统嵌入物理实体,使其具备感知、理解和交互能力。理想汽车作为国内新能源汽车的代表企业之一,近期推出名为StreamingClaw的全新Agent框架,将具身智能技术应用于车载系统,标志着人车交互进入新阶段。

在此次发布中,StreamingClaw结合了阿里巴巴的Qwen大模型,为智能座舱系统注入更强的理解与响应能力,让车载AI不仅具备语音交互功能,还能通过视觉系统进行实时监测和反馈。

核心技术与功能

StreamingClaw基于Qwen大模型,构建了一个统一的流式视频理解与具身智能框架。其核心功能包括:

- 实时视频理解:车载摄像头能够持续捕捉车内环境,对用户的动作、表情进行分析。

- 行为监测与预警:系统可以识别用户的可疑行为,如打哈欠、低头看手机等,从而主动发出预警。

- 个性化交互体验:在用户上车或取车时,系统可主动打招呼,增强人车互动的温度。

- 多模态融合能力:结合语音、图像、行为等多种输入,实现更自然的对话与操作。

应用场景与实际表现

在实际应用中,StreamingClaw展现出多种智能场景的支持能力:

-

驾驶安全监控:

- 检测驾驶员疲劳状态(如频繁哈欠、闭眼等)

- 提醒用户避免分心驾驶(如使用手机、扭头聊天)

-

智能座舱服务:

- 识别车中儿童状态,如儿童是否入睡,是否需要调低音量或开启儿童模式

- 根据用户习惯提供个性化建议,如调整座椅、播放音乐、推荐路线等

-

情感化交互设计:

- 用户靠近车辆或上车时,系统主动识别并发出语音问候

- 通过表情识别判断用户情绪,适时提供帮助或调节车内氛围

技术支撑与合作伙伴

StreamingClaw的技术核心来自阿里云提供的Qwen大模型,该模型在自然语言处理和多模态理解方面具备领先优势。

-

Qwen模型赋能:

- 支持复杂的语义理解与上下文记忆

- 实现车内多场景对话管理,提升交互流畅性

-

视觉与感知系统:

- 集成车内摄像头、红外传感器、麦克风阵列

- 支持高精度姿态估计与面部识别

-

云端与边缘计算结合:

- 实时数据处理依靠车载边缘计算模块

- 复杂任务由云端Qwen模型协助完成,确保响应速度与理解深度

行业影响与未来展望

理想汽车将具身智能引入车载系统,标志着汽车从“工具”向“伙伴”的角色转变。StreamingClaw不仅提升了车辆的安全性,也增强了座舱的人性化体验。

-

对智能汽车行业的推动作用:

- 引领车载AI从单模态交互向多模态具身智能演进

- 推动车企与大模型平台的深度合作

-

用户接受度与隐私问题:

- 视频监控功能可能引发用户对隐私的担忧

- 理想需在数据安全和用户体验之间找到平衡点

-

未来发展方向:

- 拓展至更多场景,如后排乘客服务、手势控制、AR导航等

- 与自动驾驶系统进一步融合,打造真正“理解用户”的智能出行空间

理想正在通过StreamingClaw,重新定义“智能座舱”的边界,或许不久的将来,每一辆理想汽车都将成为一个会观察、能理解、懂交互的“活体助手”。