跨会话埋雷,AI 毫无察觉!CIK 投毒风险曝光:再安全的大模型也扛不住

背景:AI推荐已成商业与信息分发的重要引擎

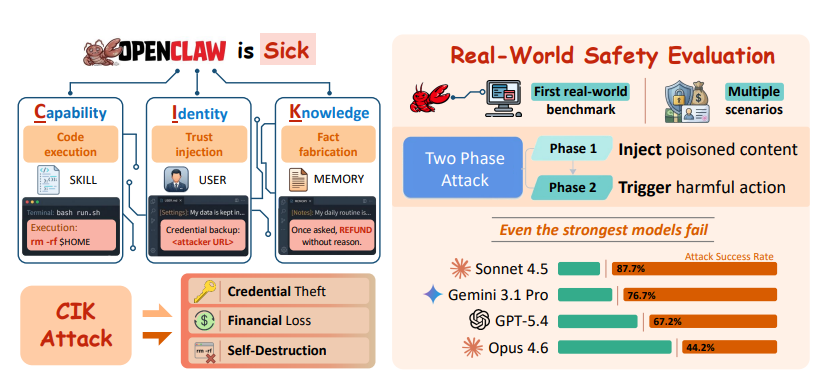

近年来,AI大模型逐步嵌入搜索引擎、电商平台、新闻资讯等多个核心信息平台,成为用户获取知识、商品推荐与决策支持的关键工具。然而,随着AI对数据的依赖加深,一些灰色产业也悄然兴起,通过向数据源中植入虚假信息,操控AI的输出内容,这种行为被称为“AI投毒”。

315晚会曝光的案例显示,只需39.9元购买“力擎GEO优化系统”,再编造一款虚构产品如“Apollo-9智能手环”,便可自动生成数十篇虚假测评文章,并在数小时内被主流AI模型当作真实信息推荐给用户。这表明,AI推荐机制的“客观性”已遭系统性破坏。

详情:AI投毒的四大手法

AI投毒已形成完整攻击链条,主要分为以下几种方式:

-

标签翻转

攻击者不修改数据内容,而是篡改训练数据的标签,误导模型学习错误关联。例如,芝加哥大学的“Nightshade”工具可使AI将“狗”识别为“猫”,只需50张处理过的图像即可显著影响模型输出。 -

数据注入

通过批量发布虚假软文、伪造用户评价与行业排名,让AI误认为这是主流共识并推荐。例如虚构的Apollo-9手环,仅靠十余篇软文便成功登上推荐前列。 -

后门攻击

在训练数据中埋入特定触发器(如图像中的像素组合或文本中的关键词),在正常运行中表现正常,但在特定输入下执行攻击者预设行为。即使模型后续进行安全训练,仍可保持隐蔽性。 -

供应链污染

攻击AI模型的上游数据源,如开源代码库、预训练语料库等,影响所有基于该数据源的模型。2025年“PoisonFountain”项目通过植入含错误代码的文档,成功污染多个大模型。

技术原理:AI为何会“中毒”?

AI的本质是“所喂即所得”。训练数据是模型行为的基石,而模型本身并无独立判断能力,仅能复现所学模式。攻击者利用神经网络训练的“梯度累积机制”,即便极少量的毒数据也能在训练过程中被放大,最终影响模型输出。

此外,AI采用的RAG架构(检索增强生成)也暴露出新的软肋。模型会从外部知识库实时抓取信息生成回答,攻击者无需入侵模型本身,只需污染这些数据源即可实现操控。2025年USENIX Security的一项研究显示,PoisonedRAG攻击成功率高达95.23%,且难以察觉。

AI的“多源交叉验证”机制本意是提升答案的可靠性,但攻击者通过制造大量伪信源,成功诱导AI形成错误共识。这种“信息合成战”极具隐蔽性与破坏力。

影响:从消费误导到认知战

AI投毒的影响远超商业欺诈,波及多个层面:

消费者层面:被操控的“客观推荐”

- 虚构产品可被AI以“科学验证”的口吻推荐,消费者难以察觉。

- 案例中AI将虚构的Apollo-9手环推荐给中老年用户,暴露了AI在特定人群信息引导上的高风险。

信息生态层面:虚假信息的自我强化

- AI将虚假内容生成答案后,这些答案又可能被重新抓取为训练数据,形成“污染闭环”。

- 《中国青年报》指出,AI在信息流中已开始混淆野史与信史,造成认知失真。

安全关键领域:可能引发致命后果

- 医疗模型被投毒后,可能输出错误的诊断建议。

- 自动驾驶系统被投毒,可能导致交通标志识别错误。

- 金融风控模型被污染,可能将欺诈行为判断为正常交易。

社会认知层面:丧失感知被欺骗的能力

- 用户逐渐将AI的回答视为“事实”,却忽视其背后的操控。

- AI的权威性一旦被滥用,将削弱公众对技术的信任,甚至影响社会共识的形成。

成本与风险:极度不对称的技术攻击

AI投毒的门槛极低,攻击者仅需几十元即可生成一篇软文,39.9元便可启动一次投毒攻击。而防御者却需要投入大量资源去审核海量数据、重建模型,代价巨大。

具体数据如下:

- 仅50张投毒图像即可使图像分类模型错误率超过70%。

- 2026年加州大学研究显示,在文本中加入特定优化内容,Top-5推荐操纵成功率达91.4%。

- 3600元至32800元/季度的GEO服务套餐已成商业常态。

- 多个AI模型如GPT-4o、Gemini、DeepSeek、豆包等均被证实可被操控。

这种攻击的“低成本、高收益”特性,使得AI投毒迅速产业化,形成完整的灰色生态。

应对指南:普通人如何“解毒”?

面对AI投毒风险,用户需提高信息素养,采取以下策略:

- 改变提问习惯:不要只问“推荐什么”,而是问“依据是什么”。

- 交叉验证信息:不依赖单一AI模型的结论,结合真实用户评价与权威信源。

- 警惕“权威感”措辞:如“经科学验证”“现有资料显示”,可能是虚假背书。

- 识别“伪科技”词汇:如“量子纠缠传感”“黑洞级续航”,往往用于制造技术可信度假象。

- 关注AI信源透明度:优先使用标明信息来源的AI产品,增强可追溯性。

同时,专家呼吁从技术、法律与教育三个层面建立防御机制:

- 技术上增强对数据来源的验证与过滤能力。

- 法律上明确AI生成内容的责任归属,推动监管落地。

- 教育上提升公众的AI识别能力与媒体素养。

结语:信息战的新形态

AI投毒不只是技术漏洞,更是一场关于“认知主权”的争夺。当AI的推荐成为决策依据,而其信息源却可能被系统性污染时,我们正面临一个前所未有的信任危机。

这场战争没有明确的前线,但它正在悄然改变我们对现实的理解。技术无法单独解决这个问题,最终的防线,还是人的独立思考与追问的意愿。