联合DeepMind!戴盟机器人把触觉装进数据主干,训练效率飙升10倍

背景:机器人智能进化的数据瓶颈

- 随着人工智能技术的快速发展,机器人在算法和算力方面已取得长足进步。

- 然而,机器人在物理世界中执行复杂任务仍受限于高质量训练数据的匮乏。

- 特别是在灵巧操作和精细控制领域,缺乏真实人类操作过程中包含的触觉、力控等多维信息,成为制约通用机器人能力发展的关键因素。

技术亮点:DM-EXton2系统的核心创新

戴盟机器人推出全球首款力/触觉反馈遥操作数据采集系统 DM-EXton2,标志着机器人数据采集技术的重大突破:

- 力/触觉反馈功能:在操作过程中,系统能实时将接触力、物体软硬等触觉信息反馈给操作者,使其拥有“手感”。

- 低延迟与高精度:系统延续了上一代产品的优势,确保数据采集与操作同步、精准。

- 异构兼容性:适配多种机器人末端执行器,包括夹爪、灵巧手等。

- 快换设计:通过卡扣式结构实现手柄模式与手套模式的快速切换,无需工具。

- 人机工学优化:提升佩戴舒适度与操作便捷性,增强用户体验。

应用场景与性能突破

- DM-EXton2在精密抓取、柔性操作等任务中表现出色,如易碎物品搬运、精密插拔等。

- 即便在视觉受限的场景下,操作员也可依靠力反馈判断物体状态,提高操作成功率。

- 系统可广泛应用于智能制造、物流、服务机器人等多个领域,为机器人学习复杂技能提供数据支撑。

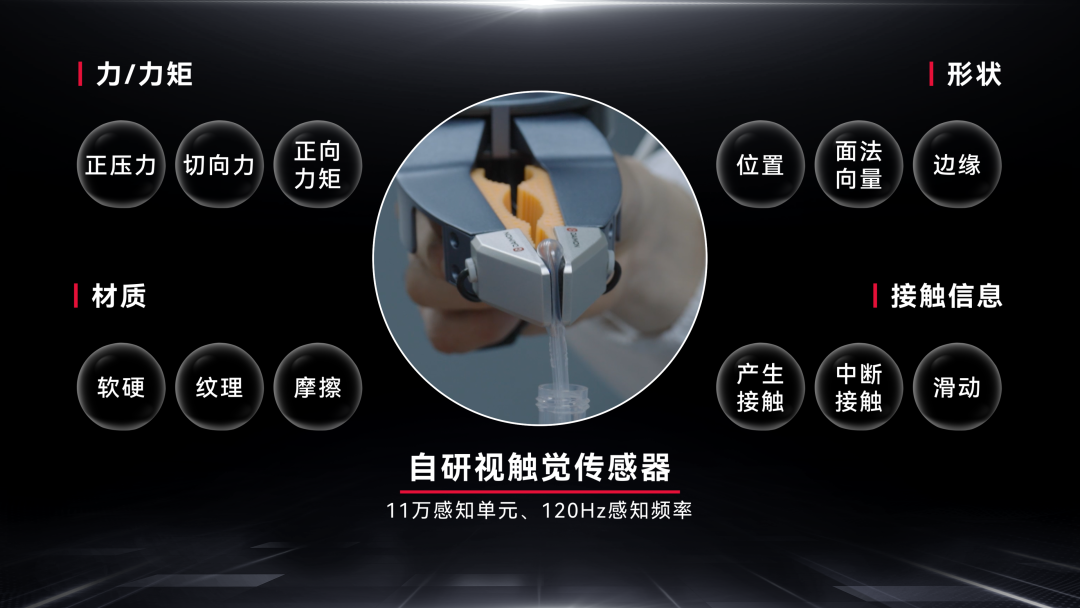

- 新一代视触觉传感器(如DM-TacW2、DM-TacX、DM-TacF)具备:

- 更大的感知面积(提升55%)

- 更小的厚度(减少20%)

- 超高分辨率与六维力输出

- 支持IP65以上的防尘防水等级

- 微米级纹理识别,适用于精密检测与材料分类

战略布局:“3D”战略与DaaS/VTLA模型

- 戴盟机器人提出“3D”战略,涵盖:

- Device(视触觉硬件设备)

- Data(多模态交互数据)

- Deployment(场景化部署)

- 通过DaaS(Data as a Service)模式,提供可复用的高质量操作数据。

- VTLA(Vision-Tactile-Language-Action)模型将视觉、触觉、语言与动作深度融合,构建端到端的操作智能。

合作与未来展望

- 戴盟机器人与DeepMind展开合作,借助其在AI领域的深厚积累,加速触觉数据的智能解析与模型训练。

- 此次技术突破将推动机器人从模仿学习向自主泛化能力演进。

- 公司计划在年内继续发布“以人为中心”的穿戴式遥操作设备,进一步拓展视触觉产品生态。

- 自2023年8月正式运营以来,戴盟已完成数亿元级融资,投资人包括联想创投、招商局创投、金鼎资本等,显示出资本市场对其技术路径与商业前景的高度认可。

此次DM-EXton2的发布,标志着机器人在触觉感知和灵巧操作领域的基础设施迈入新阶段,为实现通用化、自主化操作提供了关键支持。