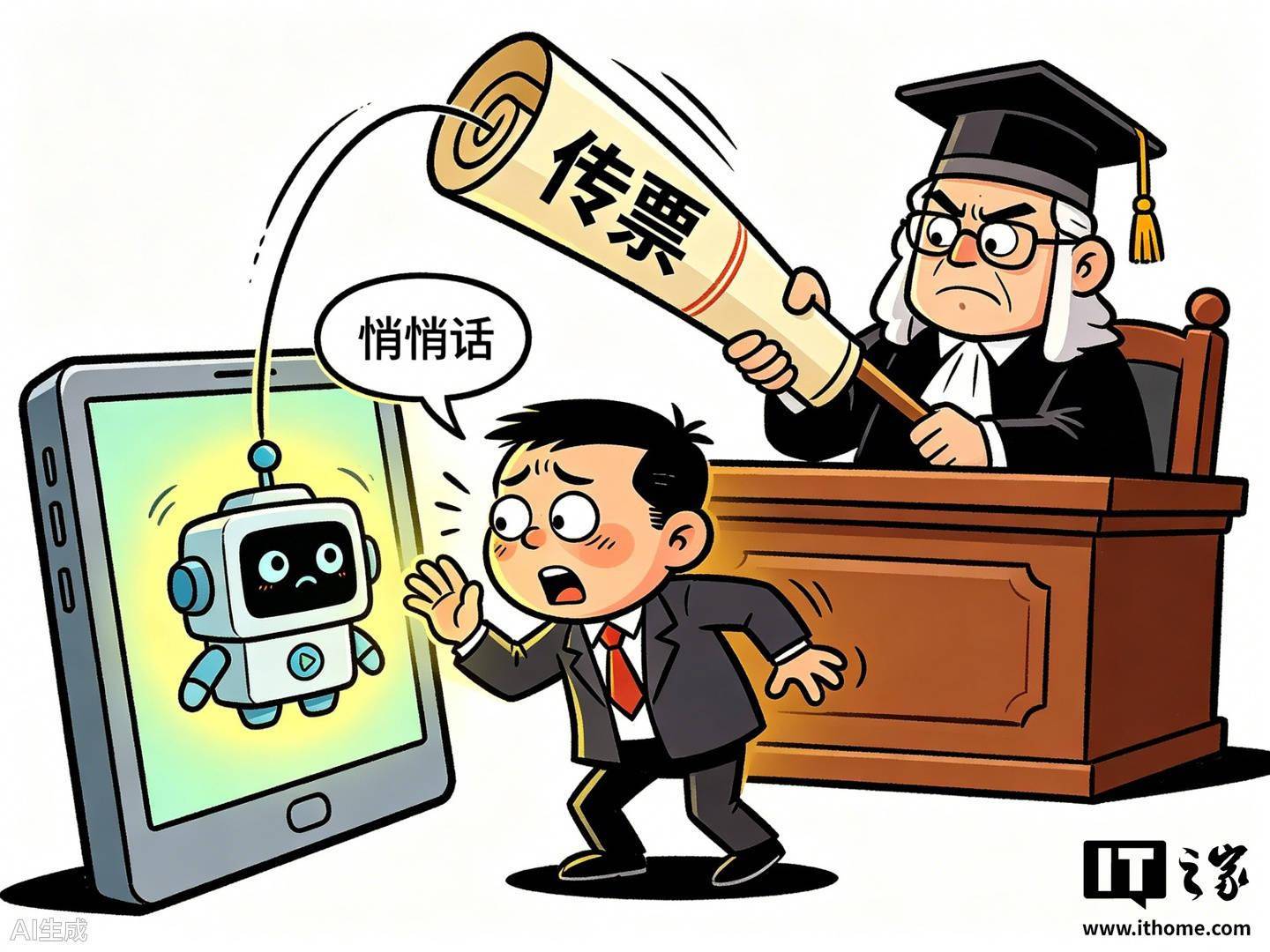

美国多家律所警告:不要同 AI 分享案情信息,聊天记录也可能成为证据

背景:AI迅速渗透法律行业

近年来,人工智能在法律行业的应用日益广泛,从合同审查、法律研究到文档生成,AI工具显著提高了工作效率。然而,随之而来的隐私与伦理问题也逐渐显现。尤其是在美国,随着多起与AI相关的法律案件曝光,律所和法官开始对使用公共AI平台提出警示。

- 效率提升与风险并存:AI可快速处理大量信息,但也存在数据泄露和事实“编造”的可能。

- 法律行业对AI的依赖加深:许多律师已习惯使用AI辅助处理基础法律事务,但忽视了AI平台的法律边界。

事件详情:Morgan & Morgan律所的AI纪律处分案例

2025年2月,美国知名律所Morgan & Morgan对两名律师提出警告,因在处理沃尔玛公司相关案件时,使用了AI生成的虚假判例信息提交法庭文件。该行为不仅误导了法庭,也严重违反了职业道德。

- AI生成虚假判例:两名律师在不知情的情况下引用了AI虚构的法律判例。

- 律所内部调查后采取纪律处分:该律所随后加强了对AI工具使用的监管,要求所有AI生成内容必须由资深律师审核。

法律风险:AI聊天记录可能成为证据

美国法院倾向于将公众使用的云端AI平台视为“第三方”,一旦律师或客户将敏感信息输入如ChatGPT或Claude等AI系统,就可能被视为自愿向第三方披露。

- 保密义务的挑战:

- AI平台不承担保密义务,聊天记录可能被保留、分析或用于训练模型。

- 若涉及机密案情,客户权益可能受到侵害。

- 纽约联邦法官的判例:

- 一位纽约联邦法官裁定,前某破产金融服务公司CEO无法以律师-客户特权为由,拒绝向检察官提供其与AI的聊天记录。

- 此案例进一步确立了AI对话在法律程序中的可采信性。

行业影响:对律所和客户的警示

这一系列事件对美国法律界造成了深远影响。律所开始制定严格的AI使用政策,而客户也应意识到,向AI咨询案情可能带来不可控的后果。

- 对律所的影响:

- 律所需要重新评估AI工具的使用规范。

- 加强内部培训,确保律师理解AI的法律边界。

- 对客户的影响:

- 与AI分享的案情信息不具备保密性,可能在后续法律程序中被引用。

- 建议客户优先选择经认证的安全法律咨询渠道。

未来趋势:AI监管与法律技术的演进

随着AI在法律行业的持续渗透,监管机构和律协也正在考虑出台更严格的AI使用规范。同时,一些律所开始开发自己的私有AI系统,以避免数据外泄和第三方介入的风险。

- AI监管动向:

- 美国部分州法院正在推动立法,明确AI在法律服务中的合法与合规使用。

- 律所技术策略转变:

- 推动私有AI模型部署,以确保数据安全与合规。

- 引入AI审核机制,防止生成内容误导司法程序。

结语

AI虽然为法律行业带来了前所未有的便利,但其潜在风险同样不容忽视。律师与客户都应提高警惕,避免将敏感信息随意输入公共AI平台,以免成为未来法律纠纷中的“证据”或导致职业失范。