默认拿个人代码喂AI,GitHub新规引开发者吐槽:这叫“强行授权”

3月25日,GitHub官方发布了一项关于数据使用政策的重大更新,宣布从2026年4月24日起,将默认使用用户数据来训练和改进其AI模型。这一政策变动主要针对个人用户,瞬间在开发者社区引发了轩然大波,许多开发者将其称为“强行授权”。

政策核心:谁是受影响者?

根据官方公告,此次政策调整的波及范围有着明确的界定,主要影响的是个人用户群体。

-

直接受影响对象:

- Copilot Free(免费版)

- Copilot Pro(专业版)

- Copilot Pro+(高级专业版)

这些用户在日常编程中与Copilot产生的交互数据,包括输入、输出、代码片段和相关上下文,都将被视为AI训练的素材。

-

未受影响对象:

- Copilot Business(商业版)

- Copilot Enterprise(企业版)

企业用户的数据将不会受到此次政策更新的影响。此外, GitHub 也提出了“历史选择保留”原则,即如果用户在政策更新前已经关闭了“允许GitHub收集数据用于产品改进”的选项,该设置将继续有效,用户数据不会被用于训练,除非用户主动重新开启。

数据边界:哪些信息会被用于训练?

开发者最关心的问题莫过于“我的哪些代码会被拿去训练?”。根据官方说明,被用于训练的数据涵盖了用户与Copilot的多种交互场景,但也排除了部分数据。

-

会被用于训练的数据包括:

- 用户与Copilot各功能的交互记录,例如在聊天窗口中的提问和建议。

- 用户主动使用Copilot时,来自私有仓库的代码处理记录(即使该代码起初处于“静止状态”)。

- 用户给予的点赞或负面反馈。

-

明确不会被共享的数据:

- 来自Copilot Business或Enterprise版本的交互数据。

- 处于“静止状态”的Issues、讨论区或私有仓库内容。

同时,GitHub强调,这些收集到的数据将在其关联公司内部(如微软)进行共享,但不会与第三方AI模型提供商或独立服务商共享。

官方动机:为了更好的模型?

对于为何要做出这一改变,GitHub的解释非常直接——为了提升Copilot的性能。

官方透露,在去年,他们曾尝试使用微软内部员工的Copilot交互数据来训练模型,结果显示代码建议的采纳率有明显提升。他们认为,真实的开发场景数据能够让模型更精准地理解开发者的工作流,不仅能提供更实用的代码补全,甚至能提前识别潜在漏洞,从而降低生产环境的风险。

简单来说,开发者的每一次使用、每一次反馈,都在帮助Copilot变得更“聪明”。

社区反弹:“这不是同意,是通知”

尽管官方给出了提升模型性能的理由,但这一政策并未在开发者社区中获得支持。相反,它激起了强烈的反对声浪。

-

“被动选择退出”的授权模式:

热评第一的开发者指出,真正尊重用户的方式应当是“主动选择加入”(Opt-in),而不是像现在这样,先默认开启,再通知用户可以在未来某个时间点“被动选择退出”(Opt-out)。这种做法被许多开发者视为一种暗含强制意味的策略。 -

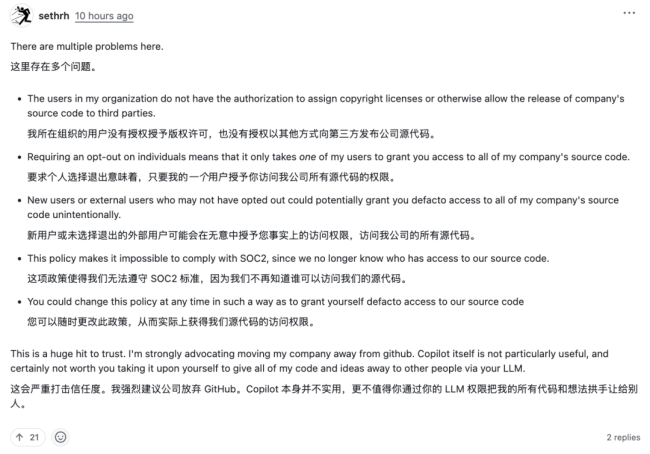

企业合规与安全风险:

对于个人开发者而言,这可能只是隐私问题,但对企业来说则关乎生存。- 知识产权泄露风险:有企业主担忧,如果其员工使用的个人版Copilot未关闭数据收集选项,公司的核心源代码可能会在无意中被上传并用于模型训练,等于变相将商业机密“分享”给母公司微软及其他潜在用户。

- 违反合规要求:该政策可能导致企业无法满足SOC 2等安全合规认证要求,因为企业将无法确切知晓有哪些主体可以访问其源代码。

-

信任危机与替代方案:

在GitHub的相关讨论区,社区的反对情绪非常高涨,用户用emoji投票表达不满,反对票高达97个,而支持票仅有4个。一些开发者已经表示正在考虑或已经着手寻找GitHub的替代方案,并建议公司逐步迁离平台。他们认为,Copilot本身的价值并不足以让其冒着失去用户信任的风险去“擅自”利用用户的代码和想法。

截至发稿,GitHub尚未公布具体的数据脱敏方式和训练周期细节。随着2026年4月24日生效日期的临近,这场关于开发者数据权利与AI发展边界的争论,恐怕还将持续发酵。