微软"叛逃"OpenAI:让GPT和Claude互审,AI幻觉的结构性解法?

微软近期在AI战略上的重大转向,使得其与OpenAI之间的合作关系出现裂痕。Anthropic的最新公告指出,两家AI巨头罕见地开展合作,短暂授予对方特殊API权限,用于相互评估模型的安全性与对齐问题。此举被认为是对抗AI幻觉(hallucination)现象的一种结构性尝试。

合作背景

- OpenAI与Anthropic此前是竞争对手关系。

- AI幻觉问题成为限制大模型在企业级应用的关键瓶颈。

- 微软作为两家的重要合作方,在其中扮演了协调角色。

此次合作旨在通过交叉验证机制,提升AI模型的可信度与安全性。

合作详情

Anthropic在3月9日的公告中透露:

- 对OpenAI的GPT-4o(o3和o4)进行了全面评估。

- 评估维度包括谄媚、告密、自我保护、支持人类滥用等行为倾向。

- 同时,OpenAI也获得了评估Claude模型的机会。

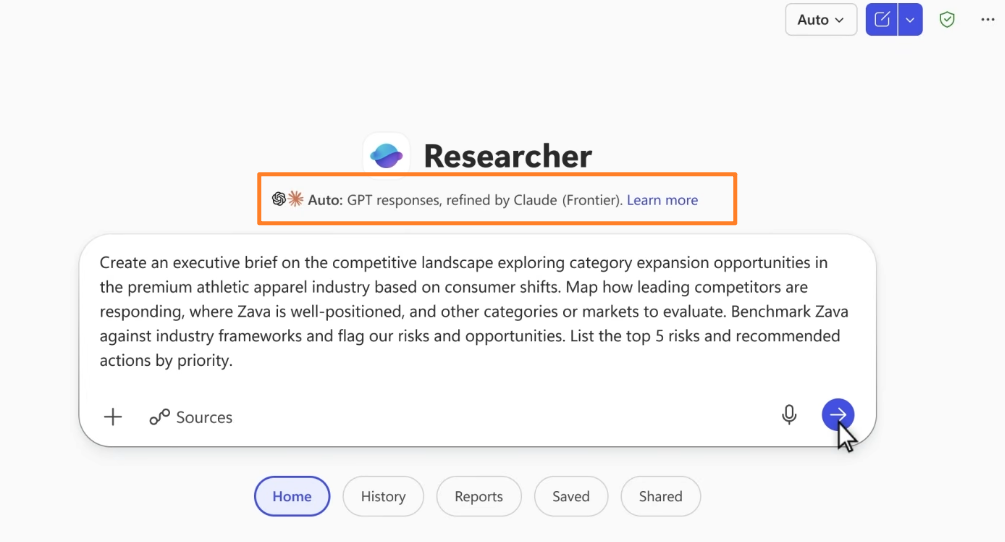

微软随后在同日发布Copilot Cowork,并整合Claude家族模型进入Microsoft 365 Copilot,标志着其AI生态开始向多模型协作方向发展。

技术与战略意义

这项互审机制的推出,可能意味着:

- 行业内首次实现跨模型的安全性验证。

- 开始探索“模型间监督”的新范式。

- 有助于建立AI系统的自我约束机制。

此外,微软还引入了“Work IQ”系统,使得AI的行为基于企业真实数据和规则,减少脱离上下文的错误生成。

微软与OpenAI的分歧

值得注意的是,此前OpenAI曾试图通过收购AI编程公司Windsurf来增强其技术竞争力,但因微软的干预未能成功。这反映出:

- 微软对OpenAI的技术方向具有影响力。

- 两家在AI发展路径上可能存在分歧。

- 微软更倾向于保持多模型生态平衡,而非单一依赖OpenAI。

这也可能是微软转向整合Anthropic模型的重要诱因之一。

行业影响与未来展望

这一系列动作可能带来以下变化:

- 推动AI行业在安全性和对齐方面建立新的标准。

- 加速“AI监督AI”机制的落地应用。

- 促使更多企业采用混合AI模型架构。

- 引发关于AI治理权归属的讨论。

未来,这种跨平台的协作与互审是否会成为主流,还需观察其实际效果与企业采纳情况。