OfoxAI是什么

OfoxAI 是一个统一 API 网关平台,旨在简化开发者与企业对多种大语言模型(LLM)的调用流程。通过单一接口即可访问超过 100 个模型,包括 OpenAI 的 GPT 系列、Anthropic 的 Claude、Google 的 Gemini、Meta 的 LLaMA 等主流及前沿模型。它解决了多模型切换时需管理多个 API Key、不同计费模式和接口差异的痛点,提供统一认证、负载均衡、缓存加速与成本优化功能,让 LLM 集成更高效、更经济。

核心优势

- 多模型统一入口:一次接入即可调用 GPT-4o、Claude 3.5 Sonnet、Gemini 1.5 Pro 等 100+ 模型,无需分别对接各厂商 API。

- 智能路由与容灾:自动根据模型可用性、响应速度、成本等规则分配请求,当某模型服务不可用时无缝切换到备用模型。

- 成本可视化与控制:提供实时用量监控、预算告警及模型级费用分摊,支持按需设置每模型的最大消耗额度。

- 高性能缓存:对常见请求结果进行语义缓存,降低重复调用开销,平均响应延迟可缩短 40% 以上。

适用人群

| 角色 | 使用场景 |

|---|---|

| 应用开发者 | 快速集成多模型能力,避免维护多个 SDK 和密钥;利用 A/B 测试选择最佳模型 |

| 企业 AI 团队 | 统一管理内部 LLM 资源,实现成本分摊与审计,满足合规要求 |

| 独立开发者/创业者 | 以较低门槛尝试不同模型,按需切换,避免单一供应商锁定 |

| 教育与研究机构 | 批量测试多个模型性能,获取统一日志用于对比分析 |

安全与隐私保障

- 数据零留存:网关仅转发请求与响应,不存储任何用户对话内容,符合 GDPR 与 CCPA 要求。

- 密钥管理:支持 API Key 轮换、访问 IP 白名单及细粒度权限控制。

- 传输加密:所有通信均采用 TLS 1.3 加密,响应中可配置脱敏规则。

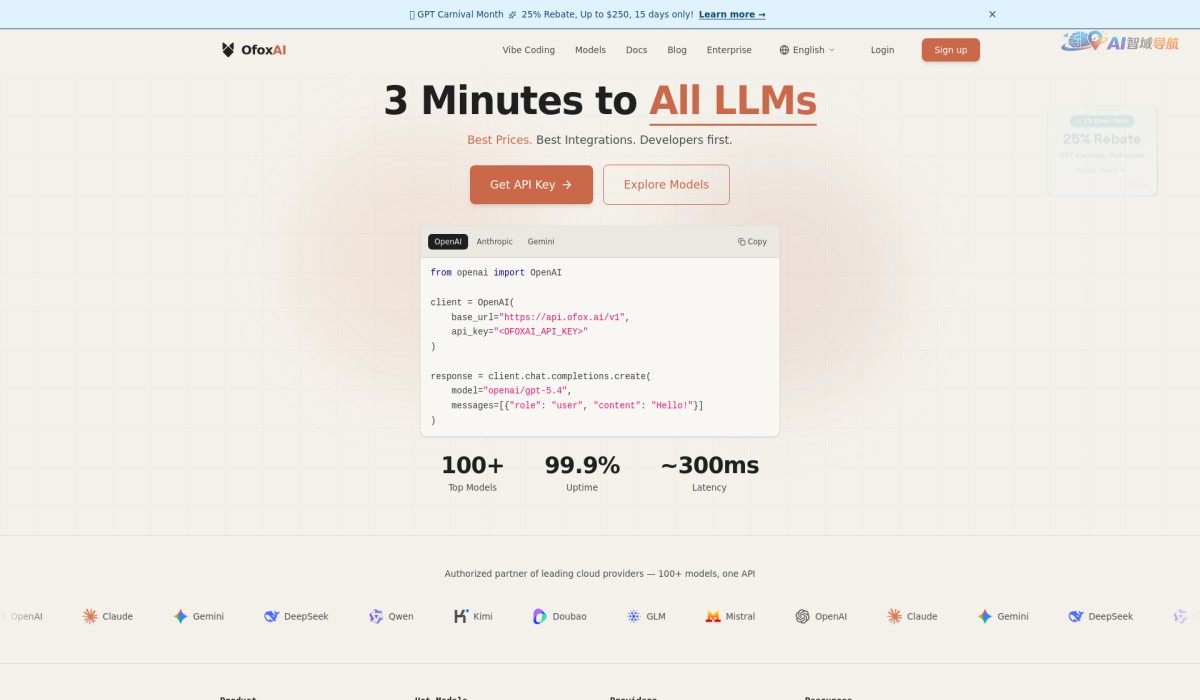

快速集成示例

无需复杂配置,仅需更换 API 地址和密钥即可切换模型:

- 在 OfoxAI 平台申请统一 API Key。

- 将代码中的

base_url指向 OfoxAI 提供的网关地址。 - 在请求参数中指定目标模型(如

gpt-4o、claude-3-opus)。 - 享受自动故障转移与成本优化。

典型调用(概念示意):

POST /v1/chat/completions

Authorization: Bearer YOUR_OFOXAI_KEY

{

"model": "claude-3-5-sonnet-20241022",

"messages": [{"role": "user", "content": "Hello"}]

}为什么选择 OfoxAI

- 避免锁定:随时更换底层模型,不依赖单一供应商。

- 降低运营成本:通过缓存和智能路由减少无效支出,平均节省 30% 左右 API 费用。

- 一站式管理:在统一仪表盘中查看所有模型的调用统计、错误率和延迟曲线。

- 持续更新:平台自动收录最新模型(如 GPT-5、Claude 4 等),无需手动集成。