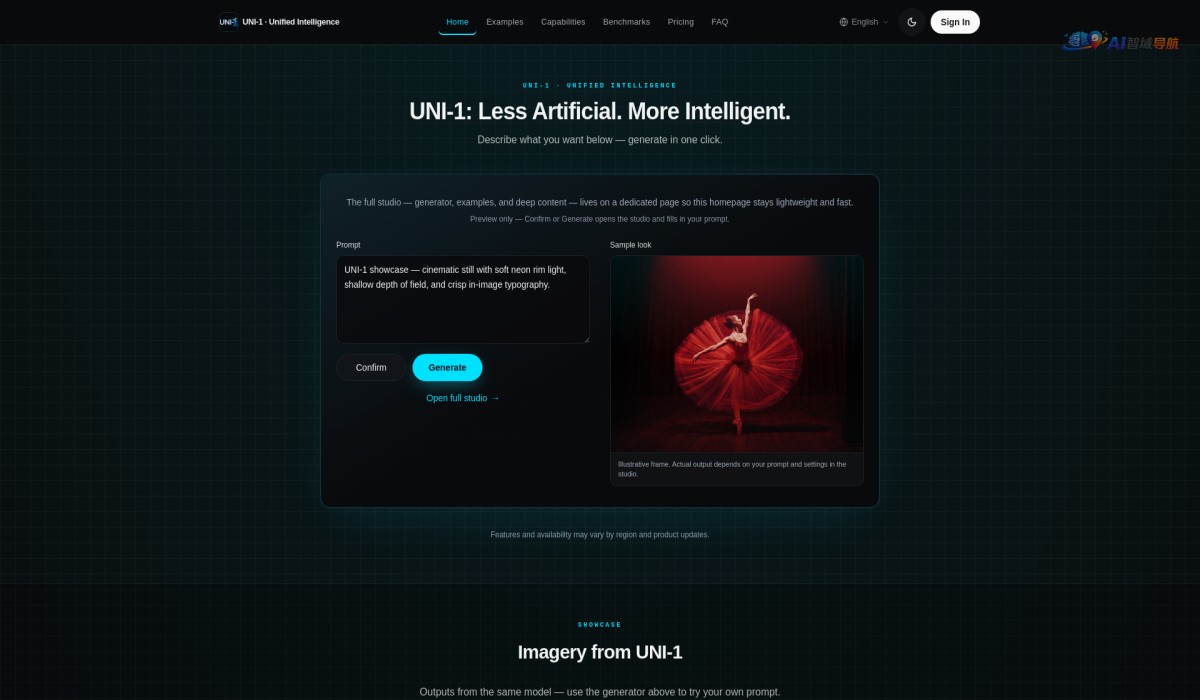

UNI-1 AI是什么

UNI-1 AI打破了传统视觉模型将识别与生成分离的设计,通过统一的Transformer主干同时处理视觉推理(如图像问答、物体关系分析)和图像生成任务。用户只需输入文本描述或图像,模型即可输出对应的推理结果或全新图像,无需切换不同模型或工具。其核心在于利用Transformer的自注意力机制,在同一参数空间中学习视觉语言的多模态关联,从而提升任务间的协同性。

核心优势

- 统一架构:单一模型完成推理与生成,降低系统复杂度与部署成本。

- 上下文连贯:共享表示使生成结果更符合逻辑约束,例如根据场景描述生成合理的物体布局。

- 高效微调:基于预训练的Transformer,适配新任务只需少量数据即可快速收敛。

- 端到端处理:从输入到输出全流程无需外部模块,减少中间误差累积。

适用场景

| 应用领域 | 典型任务 |

|---|---|

| 智能设计 | 根据草图生成完整图像,并解释设计意图 |

| 辅助诊断 | 分析医学影像并生成病灶区域的可视化标注 |

| 交互式教育 | 对图片中的物体进行问答,同时生成示例图解 |

| 创意工具 | 提供文字描述即可生成多版本图片,并自动评估构图合理性 |

技术亮点

- 统一注意力机制:视觉与文本token在相同注意力头下交互,跨模态对齐更自然。

- 任务提示融合:通过控制token或特殊标记区分推理与生成模式,实现灵活切换。

- 自回归与并行结合:推理时采用自回归解码,生成时融合并行扩散样式的迭代优化,兼顾准确率与多样性。

未来方向

UNI-1 AI的下一步计划扩展至视频理解与生成,并支持更长的多模态上下文窗口。同时将优化小模型版本,使其能在边缘设备上实时运行,满足隐私敏感场景的需求。