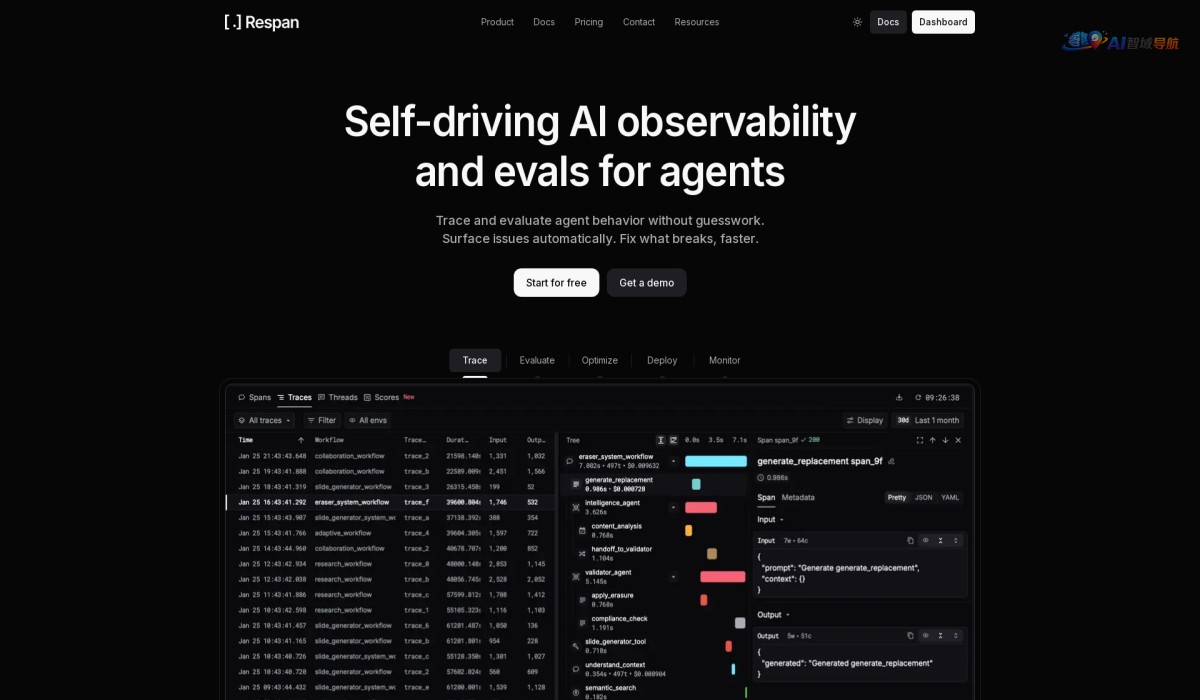

Respan是什么

Respan 专为大型语言模型(LLM)工程打造的一站式平台,将通常分散在不同工具中的核心职能——可观测性、自动化评估、提示词迭代以及网关管理——融合到单一工作流中。它帮助开发者和AI团队从原型到生产全链路追踪模型行为、快速定位问题、迭代提示策略,并通过内置网关安全地管控模型调用,从而显著降低LLM应用的运维复杂度,提升交付效率。

核心优势

- 统一工具链:不再需要在多个独立服务间切换,平台内即可完成调试、评估与部署监控。

- 端到端可观测:全面捕获LLM请求/响应、Token消耗、延迟与错误分布,支持实时仪表盘与深度回溯。

- 智能评估体系:支持自动打分、对比实验与人工反馈,让评估结果直接驱动提示优化。

- 提示迭代加速:提供版本管理与效果追踪,结合评估数据快速验证不同指令、示例对输出的影响。

- 安全AI网关:集中管理API Key、频率限制、模型路由和安全策略,确保生产环境的合规与可控。

主要功能模块

| 模块 | 核心能力 | 业务价值 |

|---|---|---|

| Observability | 实时监控/日志/追踪/成本分析 | 快速诊断异常,优化资源使用 |

| Evaluations | 自动评分/人工标注/A/B测试 | 量化模型表现,驱动持续改进 |

| Prompt Optimization | 版本管理/效果对比/变量测试 | 提升输出质量与一致性 |

| AI Gateway | 路由/限流/密钥管理/安全审计 | 保障服务稳定性与数据安全 |

适用场景

- 需要从零开始搭建LLM应用,希望避免重复建设基础设施的团队。

- 已上线应用但缺乏系统化监控与评估,难以定位幻觉或性能瓶颈的运维组。

- 反复调整提示但缺乏量化反馈,依赖人工检查的提示工程人员。

- 多项目并行,需要统一管理多个模型API密钥与访问权限的企业。

为什么选择Respan

相比临时拼装开源组件或采购多个独立SaaS工具,Respan 将“可观测-评估-优化-管控”闭环内置在一个平台上,节省集成成本的同时消除数据孤岛。无论是快速原型验证还是大规模生产运维,团队都能在统一视角下持续提升LLM应用的质量与可靠性。