清华2年前预言,正成为全球共识Meta等三大AI机构已得出同一结论

背景:AI发展步入新阶段

人工智能的发展在过去几年呈现出指数级的增长,特别是在大模型的训练和部署方面。然而,随着模型规模的不断扩大,研究者开始面临算力、成本与模型性能之间的平衡问题。2024年,清华大学的一个研究团队提出了一个引人注目的观点:AI模型的有效性能提升遵循“密度定律”——即每3.5个月翻倍一次,这一结论在当时并未引起广泛关注。

预言重现:密度定律被全球三大AI机构验证

在2026年4月,全球最权威的三家AI研究机构——Meta、METR以及另一家未具名的顶级实验室——相继发布研究成果,指出主流开源模型的性能提升趋势与清华两年前提出的“密度定律”高度吻合。这一趋势不仅体现在模型参数量上,还包括训练效率、推理速度以及任务完成能力等多个维度。

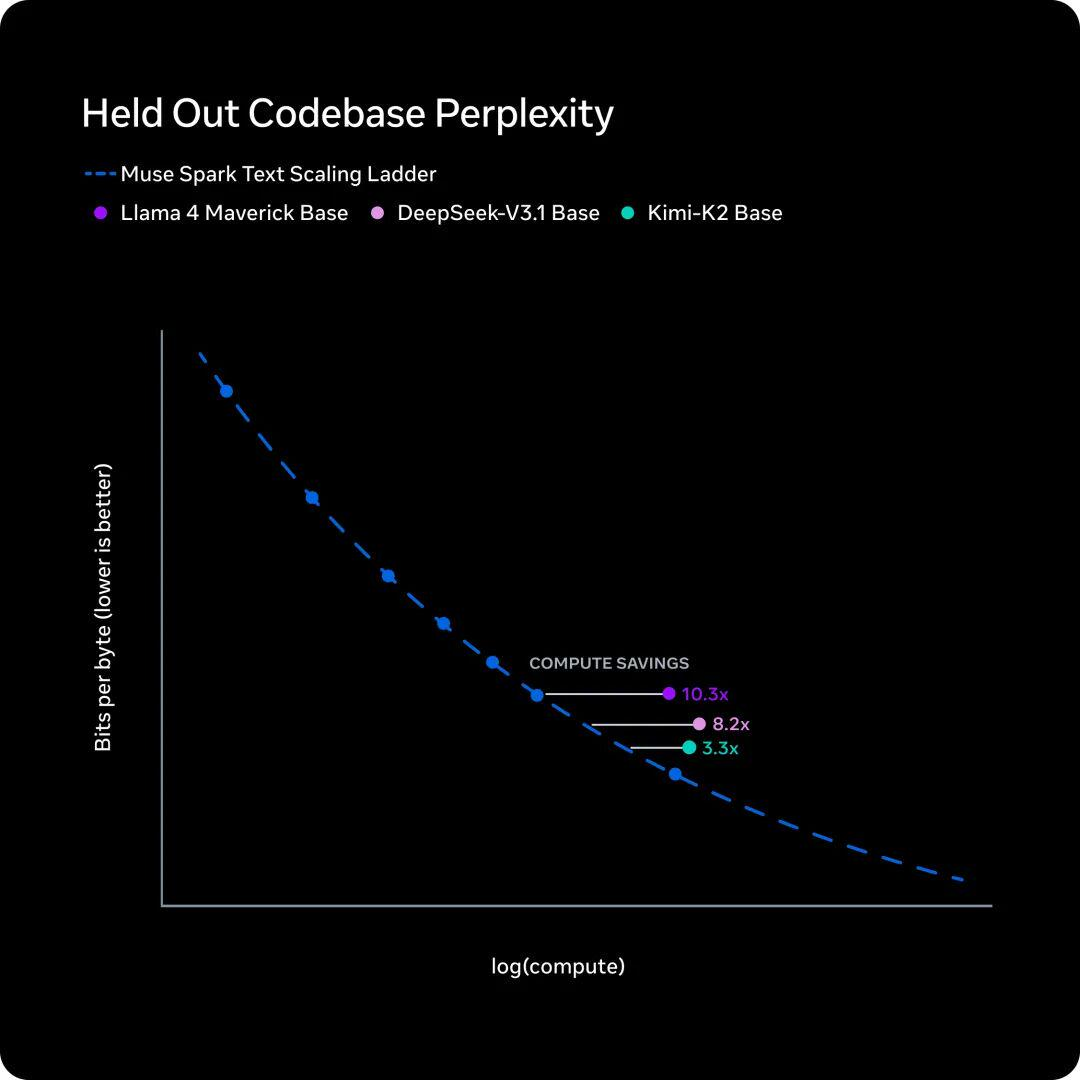

- Meta在最新一轮的训练数据中发现,无论采用何种架构,模型性能的提升几乎完全贴合每3.5个月翻倍的指数曲线。

- METR的评测系统也得出了相同结论,尤其是在跨模态任务(如视觉-语言联合推理)中,该定律表现得尤为明显。

- 第三家机构的内部报告显示,他们在不同任务场景下的模型演化实验中观察到了几乎一致的性能密度增长规律。

技术内涵:什么是“密度定律”?

清华团队提出的“密度定律”并不是单纯描述模型大小的增长,而是综合了算力利用效率、算法优化程度和模型泛化能力的统一增长指标。具体来说:

- 模型的单位计算资源下,性能呈现指数增长。

- 模型架构的复杂度与训练数据的密度之间存在动态平衡。

- 每3.5个月,模型在相同资源下可以完成两倍于之前难度的任务。

这一理论的提出,意味着AI发展的核心动力正在从“盲目扩张”转向“效率优化”,也为行业提供了新的评估标准和研发方向。

行业影响:全球AI研发路径或将重构

随着三大机构的独立验证,密度定律逐渐成为全球AI社区讨论的焦点:

- 资源分配更理性:企业和研究团队将更注重模型的“性能密度”,而非单纯追求参数规模。

- 算法与硬件协同优化:为了维持该指数增长趋势,芯片设计、训练框架和模型压缩技术将面临新的挑战与机遇。

- 中国AI话语权增强:清华的这一理论被国际广泛认可,标志着中国在AI基础研究领域的影响力显著提升,甚至在某些方向上实现了“技术引领”。

Meta在最新的内部战略文件中已明确将“密度优化”作为下一阶段AI研发的核心目标之一。

未来展望:是否可持续?

尽管密度定律已在多个独立实验中得到验证,但其长期适用性仍存在争议:

- 有专家指出,摩尔定律的放缓可能对密度定律形成挑战,特别是在芯片性能提升受限的背景下。

- 也有研究者认为,通过算法创新与新型训练范式(如统一VLA范式),可以继续维持该增长曲线。

无论如何,这一理论的广泛认同标志着AI发展正进入一个更成熟、更系统化的阶段。清华的远见,不仅为行业提供了新的观察视角,也推动了全球AI研究向更高效、更实用的方向迈进。