全行业都狂卷 Harness,Anthropic 还在加码,Codex 负责人却说它正在退场

就在整个行业都在讨论如何将 Harness(通常指AI Agent的运行环境或编排层)做得更强大、更厚重时,OpenAI 内部却传出截然相反的声音。最近,OpenAI Codex 开源负责人 Michael Bolin 在一档访谈中明确表示,理想状态下的 Harness 应该“尽可能小”,而模型应“尽可能强”。这一观点与当前主流趋势形成了强烈反差,尤其是在 Anthropic 还在大力加码复杂 Harness 设计的背景下,显得尤为引人注目。

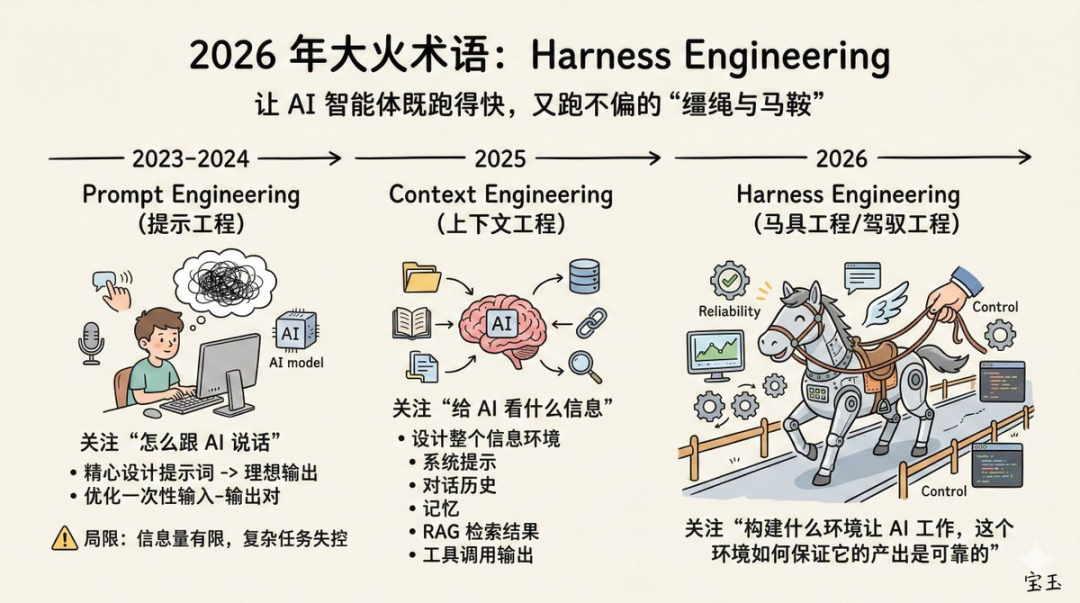

Harness 的崛起与分歧

在 AI 编程领域,一个核心共识正在形成:决定 AI 编程上限的,不再是模型单次生成代码的能力,而是 Harness Engineering 的水平。OpenAI 架构师 Bill Chen 和 Brian Fioca 曾在演讲中指出,一个 Coding Agent 主要由三部分组成:用户界面、模型和 Harness。无论是 OpenAI 还是 Anthropic,都明确认定 Harness 是 AI Codex 落地的关键。然而,在如何设计 Harness 上,两家巨头出现了明显分歧。

- 主流做法(以 Anthropic 为代表):将 Harness 做厚、做强。通过增加更多的规则、工具链和外部干预机制,来确保 AI Agent 的输出质量和安全性。这通常意味着一个庞大且复杂的运行环境,用来引导和约束模型的行为。

- OpenAI Codex 的异类思路:做薄、做轻。Michael Bolin 认为,目前行业过于关注环境对模型的“管束”,而忽略了模型自身的潜能。

Codex 的“薄 Harness”哲学

Michael Bolin 阐述的 Codex 构建理念,核心在于减少人为规则对模型的束缚,把更多决策权交还给模型本身。这是一种典型的“AGI 导向”思路。

1. 工具极简主义

Codex 最显著的特点之一是它的工具非常少。它没有专门的“读文件工具”或“写代码工具”,而是直接让它使用终端命令。Bolin 解释说,这种设计是为了让模型在更接近真实计算环境的空间中自主探索解决路径。与其编写一份容易过时且与代码并行的说明文档,不如让智能体花时间阅读代码并形成自己的判断。

2. 让模型决定执行路径

在 Codex 的设计理念中,工程师倾向于使用少量但功能强大的工具,让模型能够充分探索各种可能性。Bolin 提到一个有趣的细节:很多开发者会在提示中要求 Codex 完成任务后,顺手更新 agents.md 文件,记录值得保留的信息。这并不是强制规定,而是模型在自主协作中发现的优化自身工作流程的模式。这种自适应的进化,正是“薄 Harness”想要激发的能力。

3. 安全是唯一的刚性约束

尽管主张减少干预,但 Bolin 强调:安全(security)和隔离(sandboxing)是不可妥协的底线。

Harness 的核心职责之一是从模型获取 Shell 命令或计算机操作指令,并确保它们在沙箱中执行,或遵循用户设定的策略。Bolin 区分了“Security”(如只能访问特定文件夹)和“Safety”(模型是否会提出合适的工具调用)。在 Codex 中,Harness 负责执行命令的安全性,而模型负责决定命令的合理性。这种架构既释放了模型的全部能力,又保证了在用户机器上的运行安全。

行业影响:一场关于 AI 自主性的博弈

Bolin 的言论揭示了 AI Agent 发展的两种路径:

- Orchestration(编排)路线:认为 AI 目前还不够聪明,需要一个强大的外部“大脑”(Harness)来编排工作流,拆解任务,控制质量。

- Autonomy(自主)路线:认为模型进化速度极快,过重的 Harness 会成为限制模型发挥的“紧身衣”。

随着多智能体(Multi-Agent)架构的兴起,Harness 的形态也在发生变化。Bolin 预测,未来 Harness 将不再仅仅是单机上的单个进程,而可能演变为一个智能体网络。虽然行业普遍认为 Harness 的可靠性依然至关重要(Harness 崩溃,一切结束),但 OpenAI 的方向表明,未来的重点或许在于如何设计更轻量、更灵活的接口,让日渐强大的模型在接近真实的环境中证明自己的 AGI 潜力。

全行业都在讨论如何构建更完美的笼子,而 OpenAI 却在尝试拆掉更多的栏杆,赌上了一个更智能的未来。