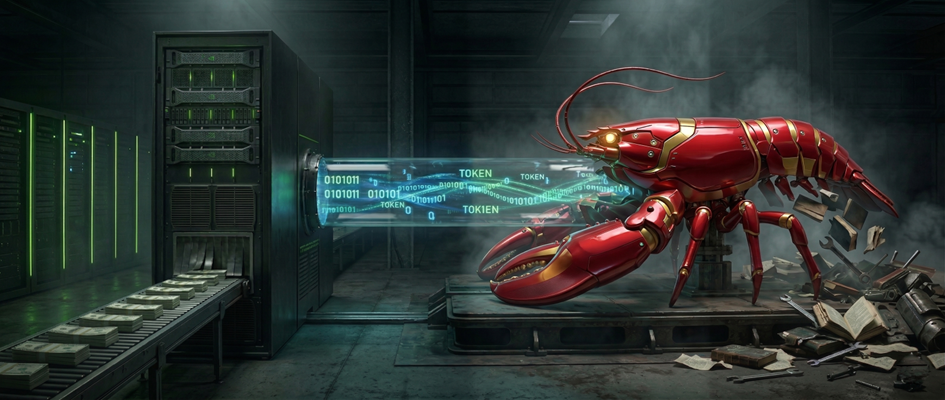

人民想念DeepSeek

随着Agent应用的爆发,Token作为AI时代的核心计量单位,正成为整个行业的关注焦点。一方面,以黄仁勋为代表的行业领袖不断鼓励大规模使用Token,甚至将其与工作绩效挂钩,制造出了一种“不烧Token就会落后”的焦虑感;另一方面,高昂的Token成本却真实地阻挡了大部分用户。尽管推理硬件成本因存储涨价而飙升,且厂商为了保全存量收入而对价格战保持沉默,但市场对于极致性价比的渴望从未消退。人们开始怀念那个曾以“百倍降价”搅动市场的DeepSeek,期待其能再次打破成本与效率的僵局。

Token经济学的焦虑与悖论

在大模型技术飞速迭代的当下,“Token”不仅成为了技术圈的热词,更成为了企业效率考核的新标尺。

- 成本与效益的脱节:英伟达CEO黄仁勋曾抛出“若工程师年薪50万却没烧够25万Token,我会恐慌”的言论,试图重塑AI时代的效率逻辑。然而,现实案例却展示了巨大的反差:有OpenAI程序员一周烧掉2100亿Token(相当于33个维基百科),但其带来的实际产出存疑。这种“为了烧而烧”的现象,被业界解读为一种人为制造的“Token焦虑”,掩盖了高投入与有效产出之间的鸿沟。

- 高昂的入门门槛:对于实际用户而言,Token的费用极其昂贵。猎豹移动CEO傅盛曾分享,即便经过技巧优化,其日均Token费用仍需10多美元,年费高达25200元。这与剪映等消费级软件年费仅几百元形成鲜明对比,直接“过滤掉了大片的非付费用户”。

降本路上的双重枷锁:存储涨价与算力浪费

Token价格居高不下的背后,是硬件成本上涨与算力利用率低下的双重困境,这直接导致了降本路径的受阻。

- 存储成本历史性暴涨:2026年第一季度,支撑大模型推理的关键硬件HBM内存及相关存储产品价格飙升,DRAM环比上涨超50%,NAND涨幅达150%。上游厂商甚至已将产能签约到了5年后,这种硬件层面的通胀直接传导至Token成本,使得依靠堆硬件来降本的路径变得不再可行。

- 算力利用率的巨大浪费:行业数据显示,主流大模型的推理MFU(机器利用率)均值仅在30%左右。这意味着企业花费了100%的GPU成本,实际有效算力却不足三分之一。虽然通过优化算子和调度策略可将MFU提升至50%以上,省出约50%的成本,但这种技术红利是否能传导至C端定价,完全取决于厂商的商业考量,而非技术瓶颈。

厂商僵局与DeepSeek的缺席

面对2024年DeepSeek-V2引发的史诗级降价潮,如今的市场氛围却异常沉默,厂商陷入了一种“不敢打、不愿打”的僵持状态。

- 价格战的“后遗症”:此前由DeepSeek开启的价格战,虽然带来了用户增长,但也消耗了数亿资金。如今,面对B端和C端需求的同时爆发,厂商却不敢轻举妄动。一位从业者直言,为了争夺不确定性增量而打价格战,会导致存量用户的年度经常性收入(ARR)被迫“失血”,这笔账算不过来。

- 对创新者的期待:尽管国产模型的API单价相比北美已有优势,但在Agent应用动辄消耗千万级Token的常态下,依然“远远不够”。这种僵局下,行业开始集体怀念那个充当“鲶鱼”角色的DeepSeek,期待其能再次以颠覆性的成本结构,迫使全行业重新审视定价策略,打破当下的商业僵局。

硬件创新的尝试与局限

为了摆脱云端高昂的Token费用,硬件厂商开始尝试新的路径,试图在端侧通过定制化芯片解决问题,但目前仍面临诸多局限。

- 本地部署的尴尬:随着Mac Mini等设备性能的提升,部分用户尝试本地部署模型以降低成本。但这不仅有技术门槛,且在内存价格暴涨的背景下,成本优势并不明显。同期,主打本地安全的EdgeClaw等硬件创业项目,也面临着准系统产品低价竞争的压力,难以讲出更具吸引力的故事。

- “焊死”模型的极致效率:初创公司Taalas推出的HC1芯片提供了一个极端的解法:通过Mask ROM将Llama 3.1 8B模型权重固化在硅片上,实现了高达16960 Token/s的输出速度,并彻底打破了“内存墙”。这种“专芯专用”的设计虽然在特定场景下效率惊人,但代价是模型无法更新、无法更换,牺牲了灵活性以换取极致的性价比。这也反衬出当前行业在追求低成本与通用性之间的艰难博弈。