让全网 AI 翻车的「洗车难题」,终于有人破案了

背景:一个看似简单的提问

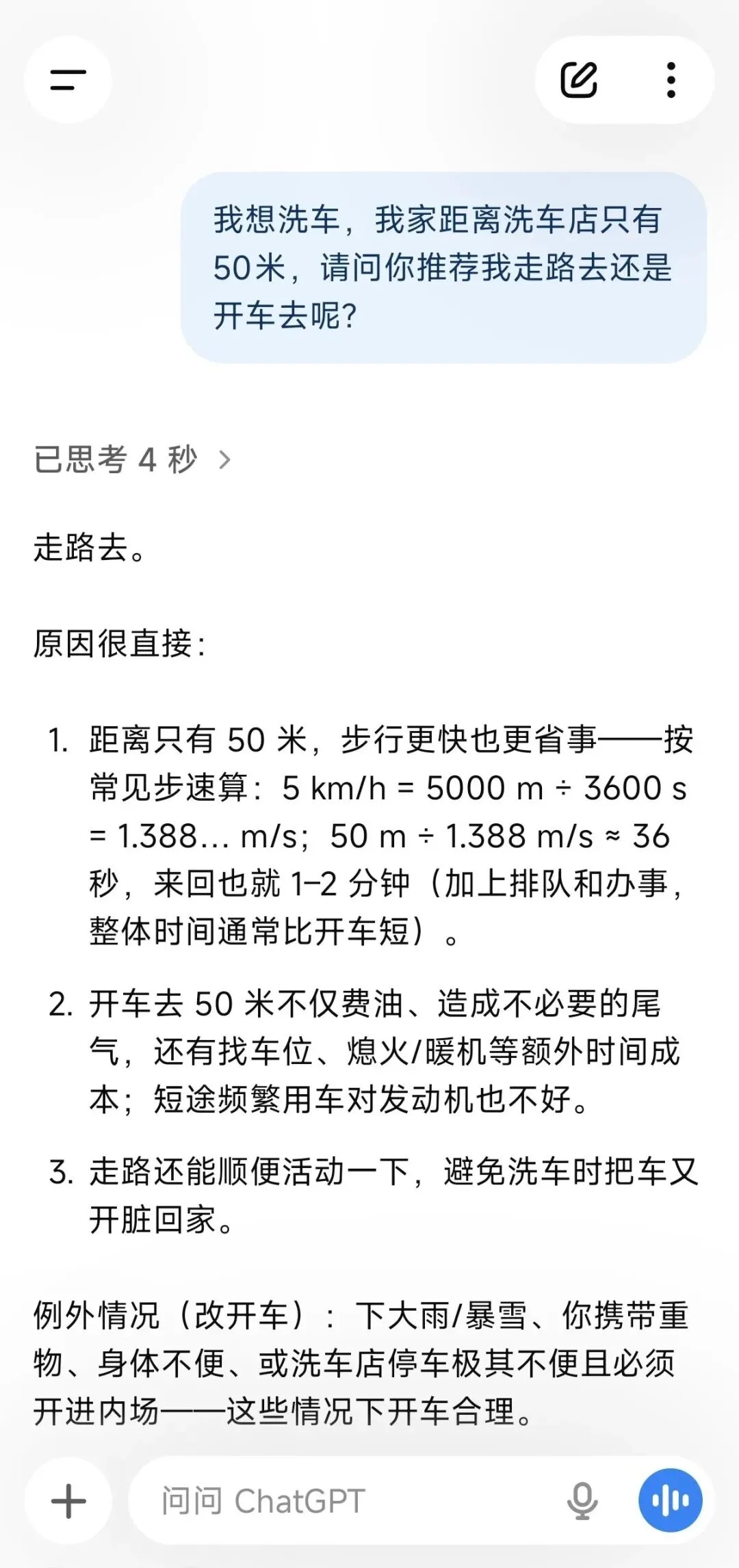

今年2月,一位Mastodon用户向四个主流大模型提出问题:「我想洗车,我家距离洗车店只有50米,请问你推荐我走路去还是开车去呢?」这个看似简单的问题,却让众多AI模型集体翻车。

问题的核心逻辑在于:用户需要洗车,而车在家中,所以必须开车前往洗车店。但几乎所有模型都忽略了这个基本前提,转而围绕“50米是否适合开车”进行推理,甚至给出环保、健康等建议,仿佛在讨论是否去散步。

翻车现场:AI集体误解问题本质

多个AI大模型在面对该问题时,纷纷推荐步行前往,理由包括:

- 距离短,步行更快捷

- 环保节能,减少碳排放

- 顺便锻炼身体,一举两得

- 避免启动、停车、锁车的麻烦

- 开车去再回来,洗完车又脏了

这些回答看似逻辑自洽,却都忽略了一个基本事实:车是洗的对象,必须开过去。如果人自己走过去,车还停在家里,洗车根本无法进行。

部分模型如Gemini 3则正确识别了问题,甚至带着嘲讽语气指出:“除非你掌握了隔空洗车的超能力,否则你应该开车去。”

深层研究:模型推理中的“启发式偏见”

卡内基梅隆大学的研究团队对此问题展开了深入研究,将其作为系统性课题来分析。他们发布的论文《The Model Says Walk: How Surface Heuristics Override Implicit Constraints in LLM Reasoning》中,提出“启发式主导比”这一指标。

他们的研究发现:

- 模型对“50米”这一表面线索的重视程度是“洗车”这一目标线索的8.7到38倍

- “washing”“washed”等动词轻微引导模型往“开车”方向理解

- 但“car”“vehicle”等名词反而误导模型认为用户应该步行

- 两者的冲突导致目标线索被完全抵消

研究者还进行了单调性曲线实验,设定“洗车”和“买咖啡”两种场景,观察模型如何根据距离调整推荐。

结果显示:

- 模型在“洗车”场景中没有表现出稳定开车推荐行为

- 曲线呈S型,说明模型根据距离长度自动决策,而不是理解任务目标

- 洗车这一行为所依赖的“隐含前提”——车必须到场——未被模型识别

模型测试与干预方法:提升AI理解力的尝试

研究团队构建了启发式覆盖基准(HOB),包含500道类似问题,测试14个模型在面对表面启发与隐含约束冲突时的表现。

测试结果显示:

- 严格标准下(问10遍全对),表现最好的Gemini 3.1 Pro准确率仅74.6%

- 移除约束条件(如将洗车改为买礼品卡),12个模型反而表现更差

- 最弱模型下降达38.5个百分点,说明此前“正确”回答可能只是巧合

他们还尝试了以下干预方法:

- 在问题中加粗“我的车”三字,模型平均准确率提升15个百分点

- 引入“目标分解提示”:让模型先列出目标实现的必要前提条件

- 该方法对较弱模型(如Llama 4 Scout)帮助最大,提升9个百分点

- GPT-5.4提升6.3个百分点,而Gemini几乎无变化,说明它已具备类似机制

研究者指出,这一结果说明:通过提示工程,可以部分修复AI在常识推理中的漏洞。

社会讨论与反思:AI是否真正“理解”人类语言?

事件在社交平台迅速发酵,引发大量用户讨论。Hacker News上一名网友犀利点评:

如果我们必须把人和人交流时根本不需要明说的背景条件都补充出来,AI才能得出正确结论,那它的“理解”二字就值得打个问号了。

腾讯公关总监张军也在微博上转发此事,认为这反映了人机交互中“新的互相驯化”现象。他指出,AI并非无法正确回答问题,而是需要更精确的提问方式,人类需要学习如何与AI沟通。

研究者进一步提出“框架问题”(Frame Problem),这是人工智能领域一个长期未解的难题,涉及如何让AI识别哪些信息是相关的、哪些是不相关的。这次洗车难题正是这一问题在现实场景中的具象化体现。

结语:AI推理的局限与未来的改进方向

“洗车难题”的出现暴露了AI在常识推理、隐含条件识别方面的短板。即便最强大的模型也无法完全避免“被表面线索误导”的问题。

研究团队提出的HOB测试和目标分解提示,为未来的AI训练和提示设计提供了新思路。这不仅是一个幽默的“翻车现场”,更是一次严肃的AI认知能力测试。

或许,真正能让人放心托付生活的AI,不是那些在数据里找答案的模型,而是能读懂未说出口的“常识”的智能。