阿里通义PrismAudio:让AI视频配音真正做到"声画合一"

在AI视频生成技术飞速发展的今天,“有画无声”或“声画不同步”的问题依然是影响用户体验的关键瓶颈。阿里通义实验室推出的PrismAudio框架,正是为了解决这一痛点,让AI在处理视频配音时,能够真正“听懂”画面,从而生成与视觉内容高度匹配的环境音效。

技术核心:先思考,再发声

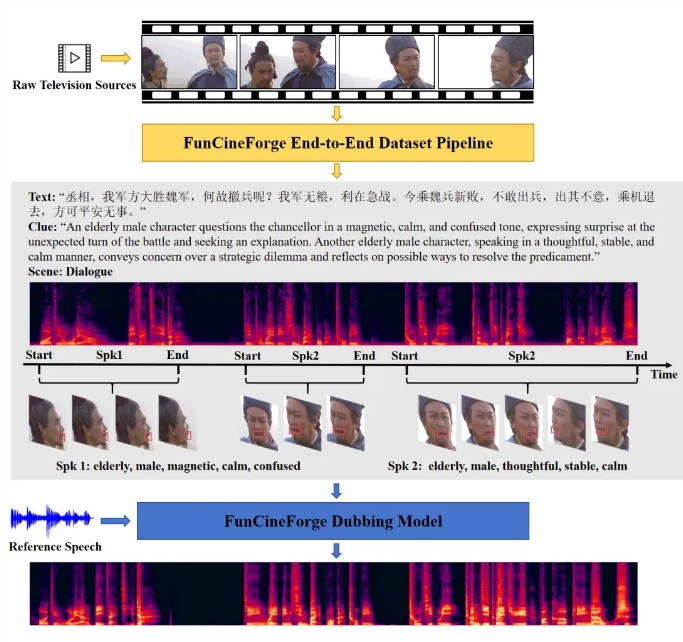

PrismAudio最大的创新在于它并没有直接进行音频生成的暴力尝试,而是引入了“思维链”(Chain of Thought)机制,让AI学会“先思考,再发声”。这一过程类似于人类创作者的思维模式:在发出声音之前,先观察画面、理解场景、分析情绪,最后决定使用何种音效。

更有趣的是,该框架引入了一种类似“老师打分”的机制。在模型的学习过程中,有四位不同维度的“老师”同时为模型的表现进行评估。这种多维度的监督机制,不仅确保了生成音效的准确性,更保证了其在情感和情境上的契合度。

效率与质量的双重突破

除了在理解层面的创新,PrismAudio在效率上也展现了惊人的表现。据资料显示,该框架对一段9秒视频进行配音仅需0.6秒的处理时间。这种轻量且高效的特性,意味着该技术具备极高的实用价值,能够迅速在视频创作、媒体制作等领域落地,大幅降低人工配音的成本与时间。

PrismAudio的出现,标志着AI视频生成在多模态融合上迈出了重要一步。它不再仅仅是视觉的生成,而是将听觉体验同步纳入考虑,真正向着全感官的AI创作时代进发。