头号玩家照进现实,NTU发布世界模型交互新范式,攻克主动操作难题

背景与挑战

近年来,具身交互与虚拟现实技术发展迅速,用户对沉浸式体验的需求不断上升。然而,如何实现真实世界中“手”与“场景”的自然交互,始终是AI生成模型的一大难题。传统方法多依赖于2D手部mask进行控制,这类方法在训练数据与实际输入存在分布差异时容易出现误导,导致生成视频中出现手部变形、伪影等问题。

为了解决这一瓶颈,南洋理工大学MMLab团队提出了Hand2World,一种基于自由空间手势的世界模型交互新范式,标志着向“头号玩家”式沉浸体验迈进了一大步。

技术创新:从2D到3D

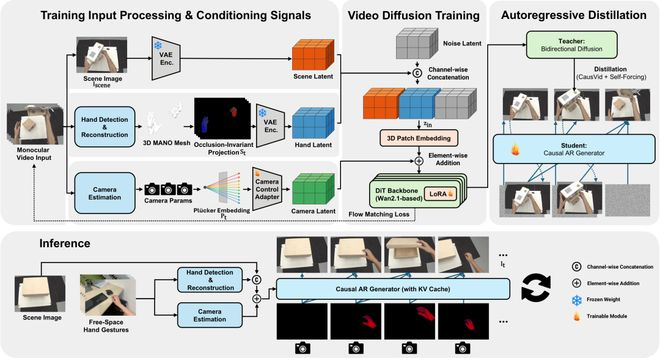

Hand2World的核心创新在于完全抛弃了传统的2D手部mask方式,转而采用3D手部结构建模:

- 使用MANO模型从单目视频中恢复完整的手部mesh

- 将其投影至图像平面,生成“填充轮廓 + 线框叠层”的复合控制信号

- 该信号格式无论手是否被遮挡,始终保持一致

这一方法有效解决了训练与推理阶段手部形态分布不一致的问题,如在训练中手被物体遮挡、推理时却以完整形式出现,从而避免了现有技术(如CosHand)中出现的伪影问题。

此外,Hand2World还引入了逐像素Plücker射线编码,显式编码相机运动轨迹,并通过轻量级adapter以加法形式注入扩散模型。这种设计成功实现了手部动作与头部运动的解耦控制,为闭环交互提供了基础。

性能表现与优化

在关键评估指标上,Hand2World展现出了显著优于现有方案的性能:

- FVD(视频生成质量):从908降至218,降幅达76%

- 相机轨迹误差:从0.13降至0.07,改善42%

- DINO语义相似度:从0.80提升至0.88

更令人振奋的是,团队通过模型蒸馏技术进一步优化了模型效率:

- 推出轻量版本Hand2World-AR

- 性能接近教师模型(FVD 232)

- 单卡A100环境下实现8.9 FPS的实时生成速度

这为该模型在移动端或AR/VR设备中的部署提供了可能。

自动标注训练数据:可扩展的关键

与此前依赖多目同步采集的方法(如PlayerOne)不同,Hand2World采用了一种全自动的单目标注流水线:

- 不需要多目相机阵列

- 不需要人工标注

- 可从普通第一人称视频中自动提取:

- 手部mesh

- 相机轨迹

- 训练数据对

这种能力意味着,任何现有的egocentric视频资源都可转化为训练信号,为具身智能的大规模数据采集提供了一个真正可扩展的方案,极大降低了高质量数据的获取门槛。

应用前景与行业影响

Hand2World的发布标志着AI在具身交互领域迈出了关键一步:

- 虚拟现实与增强现实:用户可在虚拟环境中自然操作物体,提升沉浸感与交互性

- 机器人远程操作:通过手势控制生成的视频反馈,指导机器人完成复杂任务

- 内容创作与游戏设计:提供实时、可编辑的手势交互视频生成工具

- 人机接口与无障碍技术:为肢体障碍用户带来新的交互方式

此技术不仅推动了生成模型的发展,也为人机交互、具身智能等前沿方向提供了新的研究范式,具有深远的学术与商业价值。

项目主页:https://hand2world.github.io

相关论文:Wang et al., "Hand2World: Autoregressive Egocentric Interaction Generation via Free-Space Hand Gestures," arXiv:2602.09600, 2026