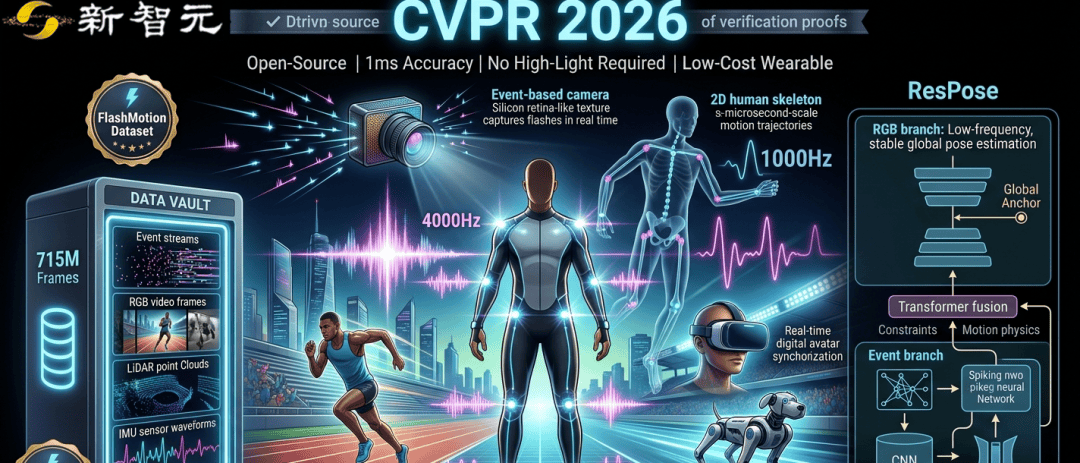

1毫秒级,最快的人体动作捕捉服,开源715万帧数据集

背景

随着人工智能与计算机视觉技术的快速发展,高精度、高效率的人体动作捕捉成为研究热点。传统动作捕捉技术受限于设备成本、精度瓶颈和数据量不足,难以满足复杂场景下的实时分析需求。如今,一种名为FlashCap的创新技术突破了这一限制,为动作捕捉领域带来了革命性进展。

技术亮点:FlashCap 的突破性能力

FlashCap 的核心创新在于其毫秒级(千分之一秒)的动作捕捉精度,相当于为机器装上了“超级慢动作眼”。这一技术优势使得人体动作的每一个细微变化都能被精确记录和还原,包括肌肉拉伸、关节转动、甚至表情变化等,极大提升了动作捕捉的真实性和动态细节。

- 高精度:毫秒级时间分辨率,可捕捉快速细微动作。

- 灵活性:基于 RGB-D 相机和移动端设备,摆脱了传统动作捕捉设备的复杂布设。

- 多模态支持:涵盖多种感知数据模态,提升识别与建模的多样性。

数据集:全球最大,支持多模态与多场景应用

作为配套资源,FlashCap 同时开源了一个庞大的人体动作数据集,成为当前全球最大的多模态人体动作数据集之一:

- 规模:包含1000人、500个动作、超过40万段视频、累计6000万帧。

- 多样性:动作覆盖人体主要肌肉群,适用于运动分析、康复训练、动画制作等多个领域。

- 模态丰富:支持8种不同的数据模态,涵盖视觉、深度、姿态等多个维度。

这一数据集的发布为研究人员提供了宝贵资源,有助于推动动作识别、生成和建模等多个领域的研究进展。

潜在应用领域

FlashCap 技术及其配套数据集的推出,将对多个行业产生深远影响:

- 影视与游戏制作:更逼真的动作捕捉将显著提升虚拟角色的动作流畅度和真实感。

- 医疗与康复:毫秒级精度有助于精确分析患者的动作轨迹,辅助康复治疗。

- 体育训练与分析:可用于运动员动作分析,提高训练效率与技术细节优化。

- 人机交互与虚拟现实:增强设备对用户动作的实时响应,提升交互体验。

- AI研究与模型训练:开源数据集将成为动作识别和生成模型训练的有力支持。

开源与生态建设

FlashCap 的开源策略进一步推动了技术民主化。除数据集外,相关工具链也逐步开放:

- 代码公开:FlashCap 的算法与处理工具将在 GitHub 上提供,便于社区测试、改进和扩展。

- 多模态支持:数据集兼容多种传感器输入方式,支持跨平台模型开发。

- 标准化推进:该数据集为动作捕捉提供了统一基准,有望成为未来研究的黄金标准。

影响与展望

FlashCap 的推出标志着人体动作捕捉技术进入一个新的纪元。毫秒级的精度与6000万帧数据集的结合,不仅提升了动作捕捉的性能边界,也为AI研究提供了前所未有的高质量训练资源。这一技术有望加速人体行为分析、增强现实、虚拟现实等领域的落地应用,并促进动作识别算法的标准化与工业化进程。

未来,随着更多研究团队的加入和优化,FlashCap 可能会进一步降低硬件门槛,拓展至移动端与消费级设备,让更多人能够享受到高精度动作捕捉技术带来的便利。