炸裂:疑似Claude Code原生源码被扒光泄露?连开发手写注释都有

网络安全风暴突袭AI界

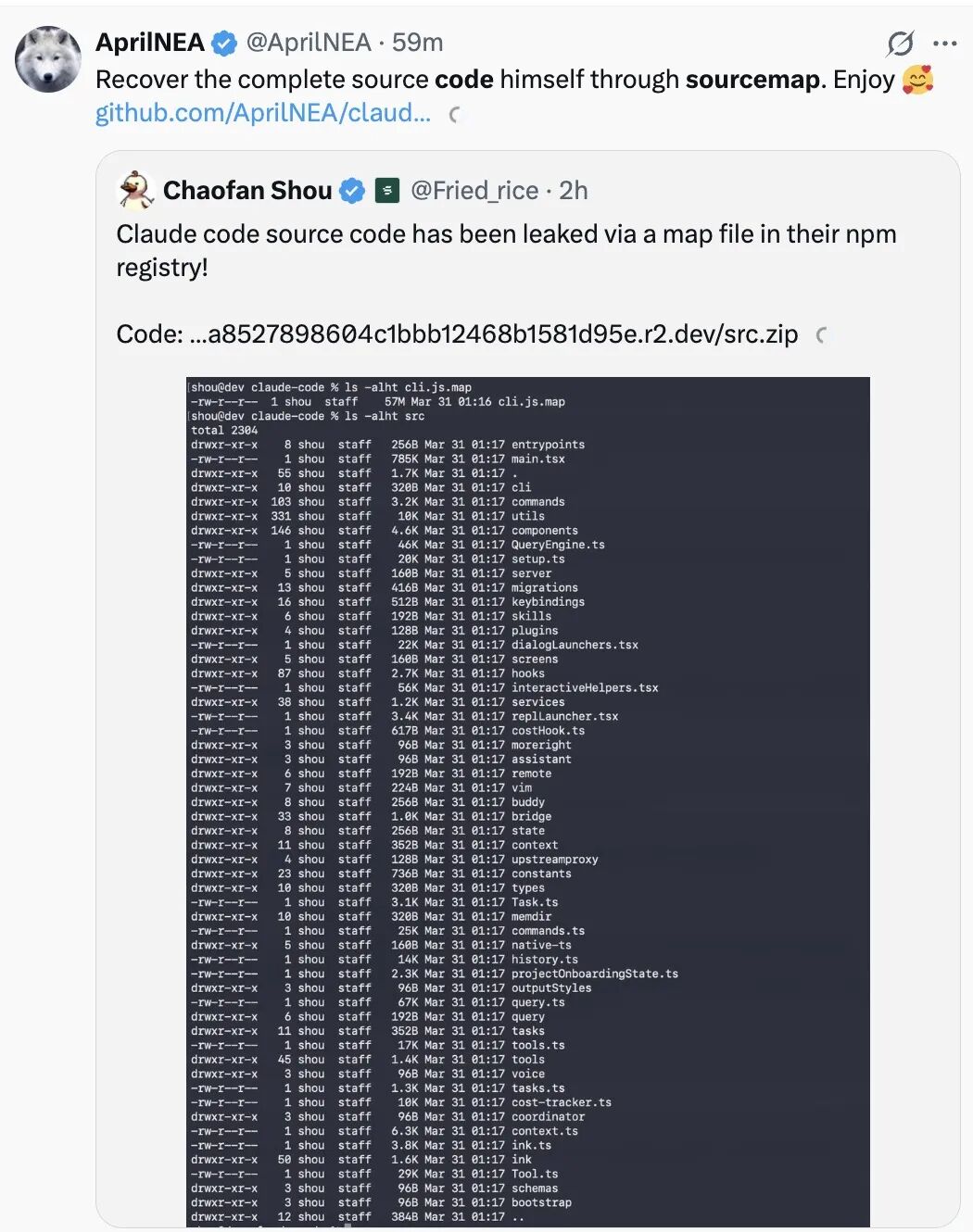

3月24日,一则关于Anthropic公司核心模型Claude Code源码泄露的消息引发行业震动。据知情人士透露,泄露内容中不仅包含底层代码,甚至连开发者手写的注释都被曝光。这一事件与同日OpenAI关停Sora视频生成服务形成强烈对比,再次凸显AI技术核心资产的脆弱性。

黑客组织TeamPCP发动的系统性供应链攻击中,月下载量高达1亿次的LiteLLM工具也未能幸免。网络安全板块当天应声下跌,头部公司股价跌幅达6%-7%,整个网络安全ETF下挫近4%。

代码泄露细节引发广泛担忧

- 源码中发现大量中文命名的变量与函数

- 开发者手写注释暴露了关键算法实现逻辑

- 项目结构显示其构建了一个"永远在线的代理"系统

- 文件命名与注释风格显示团队协作痕迹明显

这种泄露事件尤其令人不安,因为Claude Code并非普通应用,而是被广泛用于编程场景的AI模型。代码泄露可能意味着潜在漏洞暴露在黑客面前,更关键的是它可能被恶意用于自动化漏洞挖掘。

行业影响深远

此次泄露事件可能带来三重冲击:

- 商业冲击:企业将重新评估AI模型的代码保护策略

- 安全威胁:自动化漏洞挖掘工具可能被黑客仿制

- 人才流动:核心研发人员信息暴露或引发新一轮人才争夺战

这与林俊旸在《从 "推理式" 思考到 "智能体式" 思考》中提到的"训练系统"理念形成反差。代码泄露不仅影响模型本身,更可能影响到整个AI Agent生态系统的构建思路。

技术竞争格局重塑

就在事件发生前两天,智谱发布GLM-5.1大模型,在编程测试中得分达到45.3分,与Claude Opus 4.6的差距仅约3分。更值得注意的是:

- 国产模型性能已达到Claude的95%

- 成本仅为国际模型的几分之一

- 在非科班出身开发者中普及率提升明显

这表明AI编程领域正在形成新的竞争格局。王云鹤等大厂高管纷纷离职创业,DeepSeek高调招聘17个Agent岗位,种种迹象显示AI Agent将成为下一阶段的技术主战场。

行业反思与未来方向

这次事件暴露出几个关键问题:

- 即使是顶尖AI公司也难以保证代码安全

- 传统网络安全防御模式面临AI自动化的挑战

- 开发者身份边界正在模糊化

- 模型即服务的商业模式需重新审视

正如某位行业观察者所言:"今天的编程已经变成了'规格说明'"。当非专业开发者也能借助AI完成复杂编程任务时,代码安全的防护体系也需要同步进化。这也解释了为何华为、阿里等科技巨头都在转向构建更复杂的智能体系统。