10小时测完DeepSeek-V4!北大团队终结工程师噩梦?深扒大模型评测的“千亿生意”

背景:大模型评测的行业痛点

随着大语言模型的快速迭代,评测成为AI企业验证模型能力、推动商业化落地的重要环节。然而,传统评测流程面临多重挑战:

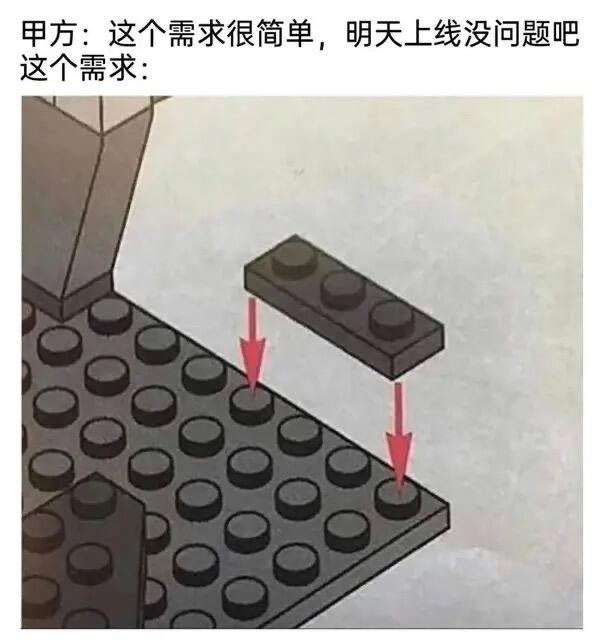

- 难用性:人工操作繁杂,配置参数需逐项手动调整,模型输出格式稍有偏差就会导致评测程序中断。

- 黑盒问题:评测流程不透明,仅提供一个量化分数,缺乏提示词构造、评分规则等细节记录,难以溯源和排查问题。

- 数据污染:当大多数模型在基础测试中都拿到95分以上的高分时,评测结果的区分度降低,行业被迫引入检测机制甄别数据污染行为。

这些问题不仅拖慢了工程师的效率,也让企业在模型选型和业务部署时缺乏可靠的决策依据。

北大团队的创新:One-Eval的“智能体化”评测框架

北京大学DCAI团队发布的开源框架One-Eval,针对上述痛点提出了系统性解决方案。

关键特性包括:

- 自然语言指令识别:用户只需输入“我想测试我的模型在金融、法律、医疗领域的表现,并看看幻觉情况如何。”,系统即可自动识别意图并匹配相关工具。

- 自动化流程处理:从结构解析、参数配置到数据拉取,全部由后台自动完成,减少人工干预。

- 数据总线架构:引入基于全局状态(Global State)的架构,记录评测全生命周期,实现断点清晰、全链路可追溯。

- 人工在环(Human-in-the-Loop)机制:系统在关键节点会暂停执行,展示上下文并等待人工审核确认后再继续,兼顾自动化与安全性。

One-Eval不仅提升了效率,也增强了评测过程的透明性和可控性,标志着大模型评测从“流水线式”向“智能体式”跃迁。

One-Eval的技术整合与工具匹配能力

One-Eval的一大亮点在于其灵活的工具匹配机制,能够根据不同领域和任务自动调用合适评测基准。例如:

- IFEval:用于评估模型的指令跟随能力。

- MedQA:专为医疗领域的问答与推理能力设计。

- LegalBench:针对法律文本的理解和逻辑判断进行测试。

- FinanceQA:用于金融场景下的信息抽取与问答任务。

这种智能适配机制,使得One-Eval能够快速部署评测任务,并适配不同的行业需求。同时,系统的模块化设计支持扩展新的评测工具,为未来更多应用场景预留了接口。

商业化潜力与行业影响

大模型评测不仅是技术问题,更蕴藏着巨大的商业价值。评测平台逐渐成为AI产业链中不可或缺的一环,其核心价值体现在:

- 企业级合规服务:提供审计日志、权限管理等服务,满足企业对数据安全与流程监管的需求。

- 稳定现金流来源:按API调用量或用户席位收费,构成了可持续的商业模式。

例如,美国评测公司Scale AI凭借其专业评测与数据标注服务,在2024年实现约8.7亿美元营收,毛利率维持在50%左右。2025年,Meta更是出资143亿美元收购其49%股份,推动其估值达到290亿美元。

One-Eval作为开源框架,虽未商业化,但其底层架构为行业提供了可借鉴的范式。若未来构建起商业化服务体系,有望在企业客户中形成广泛影响力。

展望:评测体系决定行业话语权

在大模型快速发展的当下,评测不仅是技术验证的手段,更成为衡量模型价值、决定商业落地的核心标准。谁掌握了评测体系的制定权,谁就能成为行业规则的“裁判”。

- 北大团队的One-Eval展现了“智能体化”评测的潜力,降低了工程师负担,提升了评测效率和可解释性。

- 评测平台的商业模式正在成熟,从服务B端企业的合规需求到构建数据治理闭环,都蕴含着巨大的市场机会。

- 随着技术不断迭代,评测工具也需要持续演进,以应对模型幻觉、数据污染等新兴挑战。

未来,评测系统将不仅是衡量AI能力的标尺,更可能成为构建AI产业生态的重要基础设施。