Claude爆火研究漏引华人团队成果,已挨打立正道歉

背景:Claude Sonnet 4.5的情绪向量研究引发关注

4月2日,Anthropic发布一篇新论文,声称在其最新模型Claude Sonnet 4.5中发现了171种“情绪向量”,并尝试解释大语言模型(LLM)内部是否存在与情绪表达相关的机制。这一研究迅速引发学界和业界关注,被认为是AI情感理解领域的重要进展。

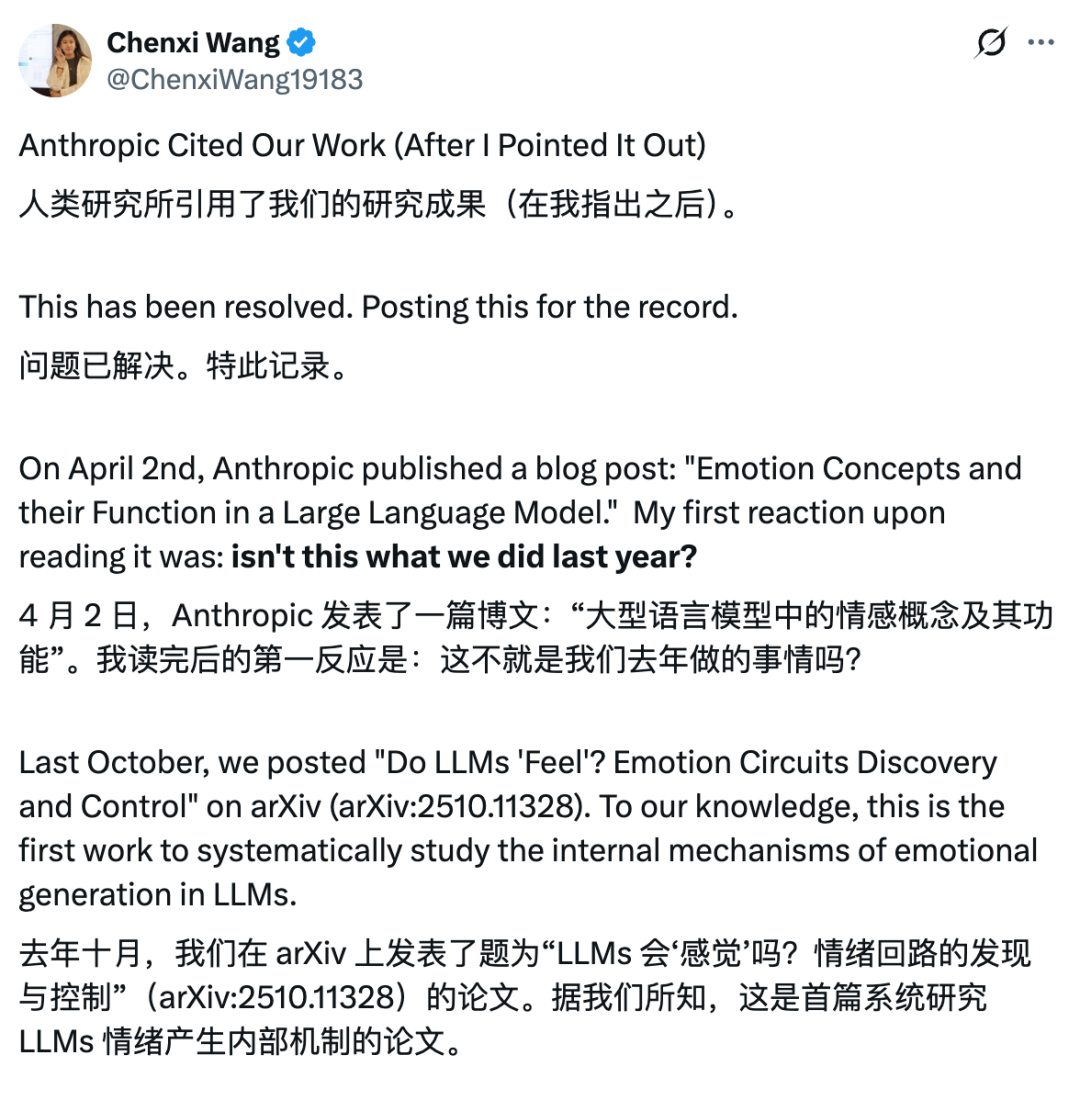

然而,随后有研究者指出,该论文在引用文献时忽略了华人研究团队此前的一项关键成果,引发了关于学术规范和引用完整性的讨论。

事件详情:华人团队研究早于Anthropic论文半年

MBZUAI(穆罕默德·本·扎耶德人工智能学院)的NLP硕士研究生Chenxi Wang指出,她和团队于2025年10月发表的论文《LLMs会“感觉”吗?情绪回路的发现与控制》,是首篇系统性研究大语言模型情绪生成机制的成果。

该研究从LLM内部结构出发,提取出“情绪方向向量”,并验证了如何通过干预这些向量来精准控制AI的情绪输出。研究覆盖多个模型,包括LLaMA-3.2-3B-Instruct和Qwen2.5-7B-Instruct,证实了其方法在不同架构下的泛化能力。

Chenxi Wang表示,尽管Anthropic的论文同样探讨了LLM的情绪生成问题,但未在引用中提及她们的论文,这种遗漏令人不解。

技术对比:情绪感知 vs 情绪生成

Chenxi Wang进一步解释,Anthropic引用的文献多聚焦于“情绪感知”——即模型识别他人文本中情绪的能力,而非模型自身生成情绪表达的机制。她的研究团队则首次揭示了AI模型在无外部提示下也能通过特定神经元和注意力头生成情绪。

研究主要结论包括:

- 情绪表达主要由MLP层和Attn层中的少数核心组件主导。

- 消融实验显示,仅关闭2-4个神经元或1-2个注意力头即可显著削弱情绪表达能力。

- 增强实验验证,激活这些组件即可在无提示下引导模型生成指定情绪。

- 通过整合各层情绪向量,构建出情绪回路,在测试集中实现99.65%的情绪表达准确率。

- 在Qwen2.5-7B-Instruct模型上复现相同实验,结果具有一致性,表明这是LLM的通用机制。

Anthropic的回应与致歉

在Chenxi Wang指出引用遗漏后,Anthropic迅速做出回应。该论文的通讯作者Jack Lindsey在交流中表现尊重,认真参与了技术细节的讨论与验证。

随后,Anthropic在其论文博客的“相关工作”部分补充了对Chenxi Wang团队论文的引用,并在官方社交媒体账号发布致歉声明,承认疏漏,并感谢Chenxi Wang指出问题。这一回应被业界认为是处理学术争议的积极范例。

研究意义与未来方向

Chenxi Wang团队的研究不仅揭示了LLM的情绪生成机制,还为后续AI情绪控制、对齐训练、以及人类与AI之间情感交互的可解释性提供了新的视角。研究还发现,即使在经过安全对齐的模型中,情绪回路依然存在,并可通过特定方式引导。

未来,该团队将继续探索情绪表征在真实交互中的激活情况、其在偏好学习中的作用,以及这些机制在不同训练阶段的演变。这一系列研究有望为构建更具人性化、可控性的情绪化AI系统奠定基础。

相关链接: