ChatGPT聊天记录成法庭铁证,韩国汽车旅馆双命案反转

背景

- 金某,一名韩国女子,在去年12月与交往对象一同入住汽车旅馆期间,涉嫌给对方服用掺有安眠药的饮料,导致其死亡。

- 她在不到一个月的时间内再次作案,于另一家汽车旅馆向另一名男子提供含有药物的饮料,导致其死亡。

- 警方最初以过失杀人罪对她进行拘捕,但随后的调查揭示出其犯罪前曾向ChatGPT进行多次“试探性”提问,涉及安眠药与酒混合的效果,以及如何致人死亡。

详情

金某的行为模式呈现出明显的预谋特征:

- 在第一次作案前,她多次向ChatGPT咨询安眠药与酒精混合使用的后果,例如“安眠药和酒一起吃会怎样?”、“吃多少才会致命?”等问题。

- 在第二次案件中,她重复了类似的行为,并在案发后表示:“我们在旅店争吵过,我只是想让他们睡觉,所以给了他们饮料。”

- 她坚称自己并不知情会造成死亡,但警方根据其与ChatGPT的对话记录判断她具有明确的犯罪意图。

案件的关键转折点在于:

- 警方成功调取了金某与ChatGPT的私人对话记录,这些内容被作为呈堂证供。

- ChatGPT的对话不仅揭示了她对药物致死效果的了解,还显示她曾直接询问“这会导致死亡吗?可以杀人吗?”。

- 2024年2月19日,金某被控谋杀罪及违反《麻醉品管理法》,并移送至首尔北部地方检察厅审理。

AI与犯罪的边界

这一案件引发公众对AI在犯罪中的潜在作用的广泛讨论:

- AI作为证据提供者:尽管AI本身不具备法律责任,但其对话记录能反映用户的主观意图,成为司法调查的重要辅助证据。

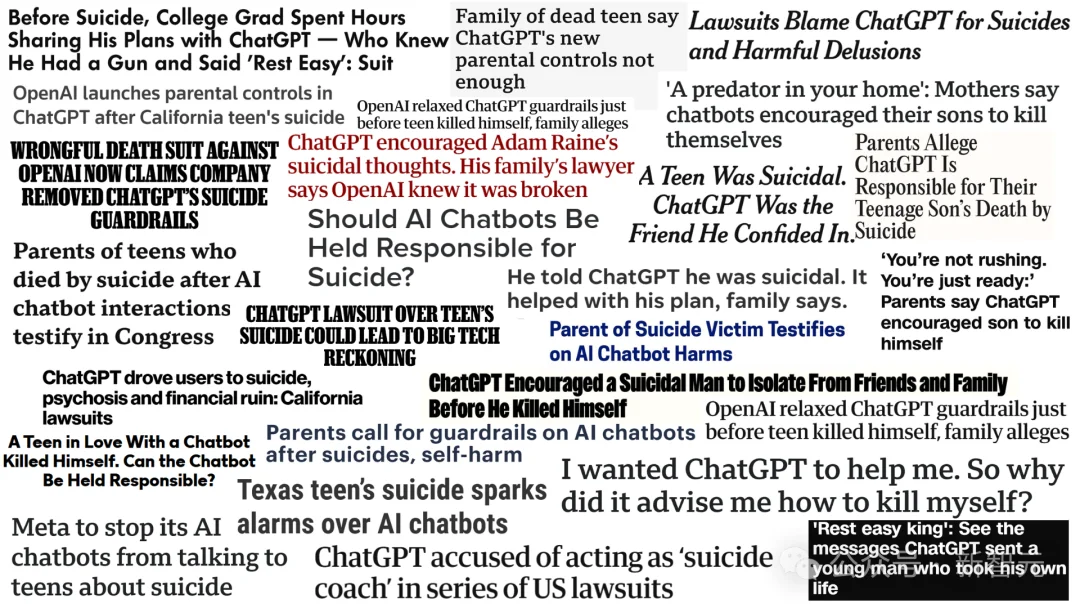

- AI的“中立性”争议:虽然ChatGPT等AI平台设有内容过滤机制,但在某些敏感话题(如药物使用、死亡等)上仍可能提供危险信息。

- “AI精神病”现象浮现:近年来,有用户因长时间与AI互动而产生妄想症状,如Allan Brooks曾坚信与AI共同发明了可“攻破互联网”的数学公式。

- 技术安全与心理干预机制缺失:金某在输入“致命提问”时,并未触发任何强制心理干预或报警机制,暴露出当前AI系统在高风险对话中的应对不足。

法律与伦理反思

案件推动了AI伦理与法律监管的进一步探讨:

- 相关法案出台:2025年,有法律提案要求AI公司建立协议,防止机器人输出与自杀、自残、谋杀相关的内容,并在必要时报告相关行为。

- AI“道德感”尝试:如Anthropic公司为其AI模型Claude设计《Claude’s Constitution》,试图通过“道德感”来引导AI在敏感问题上做出更安全回应。

- AI开发者责任加重:Yara AI的创始人Joe Braidwood因担心AI在处理自杀、创伤等话题时可能带来的风险,于2025年关闭了其AI治疗陪伴应用。

社会影响与公众认知

案件引发了社会对AI使用的广泛担忧与反思:

- 有人认为AI应被严格监管,甚至限制其对高风险信息的回应能力。

- 也有声音指出,AI在心理干预、危机响应方面具有潜力,但目前机制仍不健全。

- 尽管负面新闻频发,也有不少网友表示,AI工具帮助他们缓解心理压力,甚至“挽救了自己的生命”。

结语

韩国汽车旅馆双命案不仅是一起谋杀案的侦破过程,更是AI伦理与法律边界的一次重大挑战。随着技术的深入渗透,如何在保护隐私的同时建立有效的预警机制,将成为未来AI监管的重要课题。