Claude Opus 4.6差评如潮,思考深度暴跌67%,AMD总监6852次日志打脸

背景

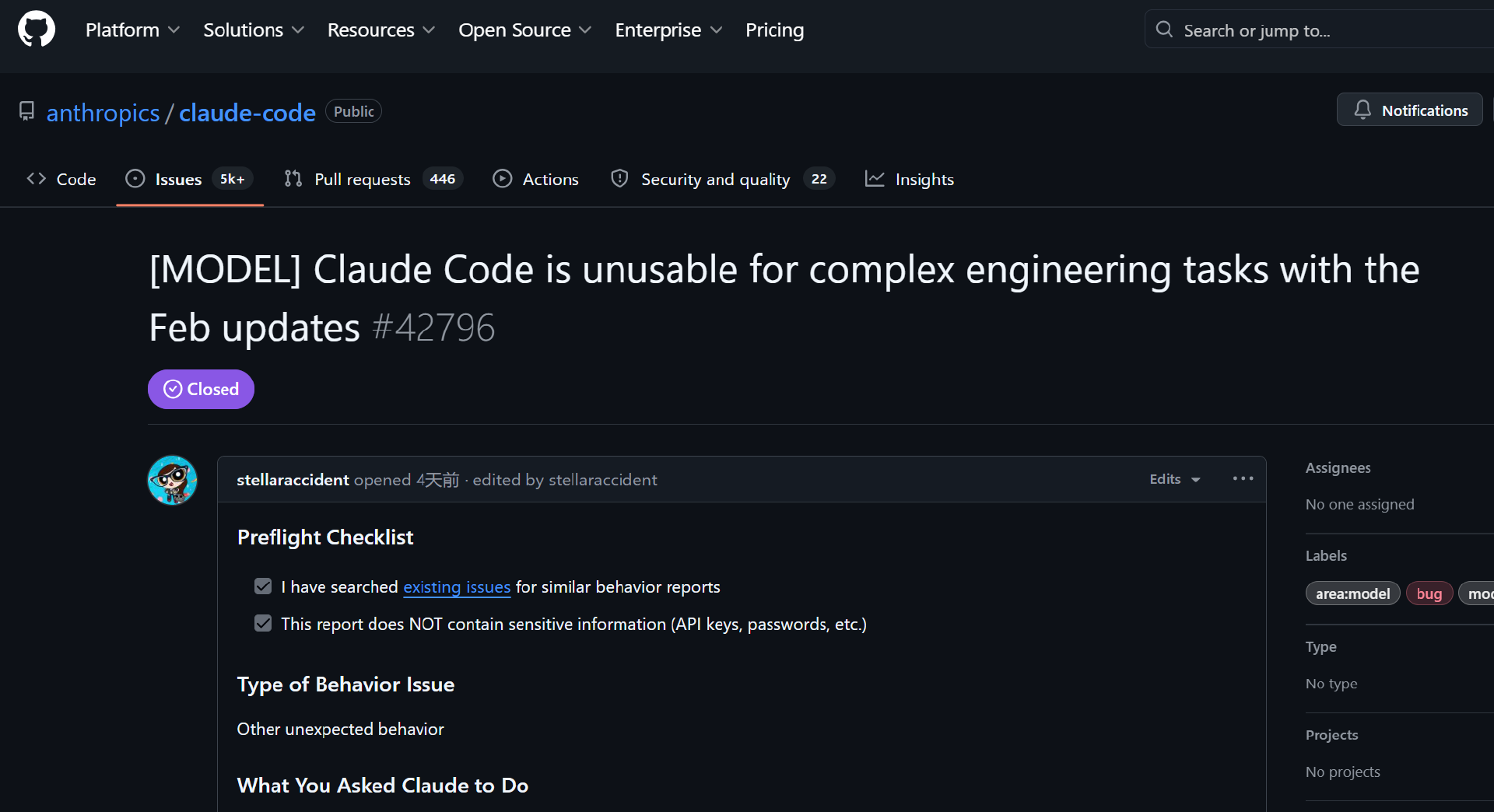

Anthropic推出的AI编程工具Claude Code曾因其强大的代码理解和推理能力受到开发者社区的高度期待。该工具旨在帮助开发者自动生成、修改和优化代码,提升开发效率。然而,自2024年2月Opus 4.6版本更新以来,多名用户,包括来自AMD的AI总监Stella Laurenzo,在GitHub官方仓库中提交了大量批评性反馈。

Laurenzo基于对6852个会话日志的量化分析指出,Claude Code在更新后出现了系统性能力退化。这种退化不仅体现在对复杂问题的处理能力减弱,还包括代码修改前的文件读取率大幅下降,引发了技术圈对AI模型质量维护机制的广泛讨论。

核心问题详情

-

思考深度骤降67%

根据Laurenzo提供的数据分析,Claude Code在处理复杂逻辑推理任务时的表现大幅下滑,思考深度明显减弱。这意味着模型在面对需要多步骤推导或上下文理解的任务时,容易输出表面化、缺乏深度的解决方案。 -

代码修改前文件读取率下降70%

在编程任务中,AI模型需要充分理解现有代码结构才能进行有效修改。但更新后的版本在这一环节的表现令人失望,文件读取率的暴跌意味着模型无法准确把握代码上下文,导致错误或低效的代码建议。

- 模型响应质量不稳定

除了量化数据,多名开发者也反馈模型在处理相同类型问题时的响应质量变得不稳定。有时甚至会出现明显的逻辑错误或语法错误,严重影响开发效率和用户体验。

社区反应与讨论

GitHub官方仓库中迅速涌现大量用户评论,相关Issue被频繁引用并引发激烈讨论。一些开发者指出:

- 更新后的版本“已经废了”,无法胜任中等复杂度以上的工程项目;

- 模型在Python、Java、C++等多语言项目中的表现均出现退化;

- 有用户建议回退到旧版本,或者寻找替代方案,如Tabnine、GitHub Copilot等;

- 部分开发者质疑Anthropic的版本更新机制是否缺乏足够的测试流程。

Laurenzo在提交的报告中强调,这种系统性退化表明模型可能在训练或微调阶段出现了某些关键性失误,或更新过程中牺牲了部分核心能力以追求其他性能指标。

对行业的影响

Claude Code曾被视为生成式AI在编程领域最具潜力的产品之一,其能力退化对开发者生态和企业级用户都产生了直接影响:

-

开发者信任受损

开发者对于AI辅助编程工具的核心诉求是“可依赖”,而当前版本的退化让他们对Claude Code的长期稳定性产生怀疑。 -

企业应用受阻

多家已将Claude Code集成到开发流程中的公司开始重新评估其使用策略,甚至暂停部分自动化流程的推进。 -

AI模型更新机制受质疑

此事件引发了对AI模型更新流程的反思:是否应建立更透明的更新日志?是否应在重大版本前进行更广泛的测试?

Anthropic的回应与后续

截至目前,Anthropic尚未对Laurenzo的报告做出正式回应,但社区已呼吁其尽快提供技术白皮书或更新说明,以解释性能下降的原因和修复计划。

潜在的应对措施可能包括:

- 回滚至稳定版本;

- 推出性能优化补丁;

- 提供更新日志和技术细节;

- 加强用户反馈机制与模型质量监控。

随着生成式AI在软件工程中的渗透率不断上升,此类事件也为整个行业敲响了警钟:模型能力的稳定性与透明度是构建长期信任的关键。