带崩全球存储股,谷歌论文引发争议,中国学者指其“严重失实”且“知错不改”:使用了我们的方法,但刻意回避相似性

事件背景:AI大模型内存优化的军备竞赛

随着生成式AI和大型语言模型(LLM)的飞速发展,模型参数量呈指数级爆炸,这对硬件内存提出了严苛挑战。如何在不牺牲模型性能的前提下,大幅压缩AI大模型的内存占用,成为行业关注的焦点,也是各大科技巨头角逐的前沿阵地。

在此背景下,谷歌研究院(Google Research)于近期发布了一篇题为相关技术论文,声称提出了一种名为“TurboQuant”的新型量化算法。该论文宣称TurboQuant在保持高准确度的同时,能够实现远超现有技术的内存压缩比。这一技术突破的消息一经传出,立即被资本市场视为重大利好(或对传统存储方案的利空),引发了剧烈反应。

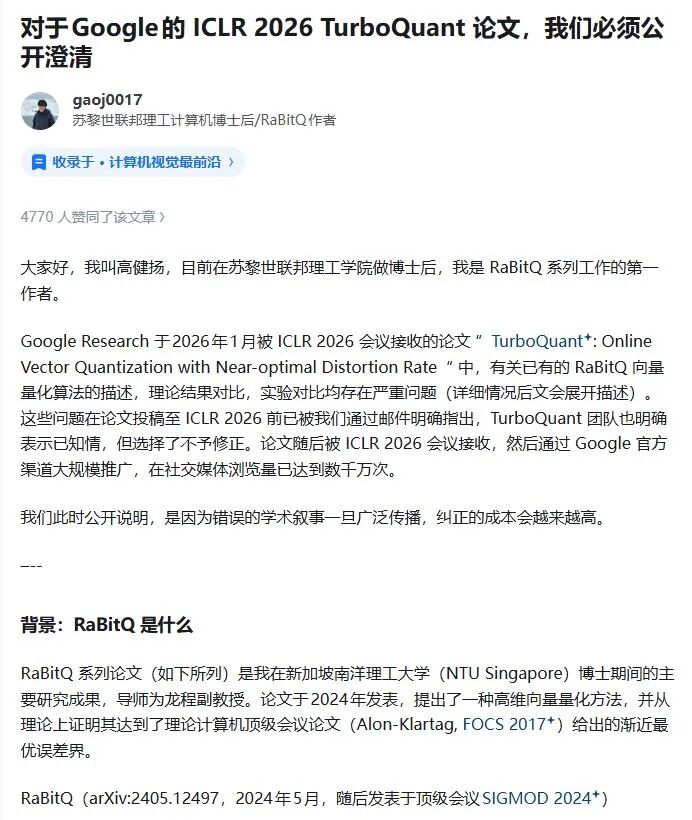

争议爆发:中国学者指控谷歌“严重失实”

然而,这篇备受瞩目的论文迅速招致了来自中国学术界的强烈质疑。主要指控者是来自新加坡南洋理工大学(NTU)的博士生高健扬。他公开指出,谷歌的TurboQuant论文在学术伦理和事实陈述上存在重大缺陷,主要集中在以下几点:

- 回避相似性: 高健扬指出,TurboQuant算法的核心机制与他在2024年于NTU读博期间发布的RaBitQ方法高度相似,但谷歌论文却刻意回避了这一事实,未进行恰当的引用或致谢。

- 理论描述错误: 谷歌论文在介绍背景时,错误地描述了RaBitQ的理论结果,曲解了原方法的技术细节和贡献。

- 拒绝修正: 更令人震惊的是,在高健扬指出上述错误后,谷歌方面并未表现出应有的修正意愿,被中国学者批评为“知错不改”。

学术细节:RaBitQ与TurboQuant的笔误与“刻意回避”

根据高健扬的详细陈述,争议的核心在于对RaBitQ方法的界定。

- RaBitQ的贡献: 高健扬强调,RaBitQ是全球首个证明了能够在线性计算复杂度下,保持二值量化(Binary Quantization)模型性能的方法,这在理论上是一个重要突破。

- 谷歌的“误读”: 谷歌论文中声称RaBitQ存在某种理论局限(例如暗示其无法处理某些情况或精度不足),高健扬认为这是基于对RaBitQ论文的误读。

- 相似性问题: 尽管谷歌在TurboQuant中可能使用了不同的工程实现,但从底层逻辑和解决问题的思路上,与RaBitQ存在显著的“雷同感”。高健扬指责谷歌团队在明知RaBitQ存在且解决相关问题的情况下,故意不提及该方法,试图将创新点完全归功于自己。

市场海啸:一句话“带崩”全球存储股

这场学术争议迅速外溢,演变为一场资本市场的风暴。

在谷歌论文发布后的短时间内,全球存储芯片市场应声大跌。分析师指出,市场逻辑非常直接:如果TurboQuant真如论文所言,能以极低成本解决AI内存瓶颈,那么市场对高性能、高容量的传统存储芯片(如DRAM、HBM)的需求将面临被颠覆的风险。

相关事件直接导致了以美光科技(Micron)为代表的美国内存芯片股集体下挫,市值瞬间蒸发。投资者在“技术颠覆”的恐慌情绪下,纷纷抛售存储类股票。这一现象被媒体戏称为“一篇论文带崩全球存储股”。

后续影响与行业反思

目前,该事件仍在持续发酵中,不仅涉及技术归属权的争论,更引发了关于顶级学术机构在面对质疑时的态度问题。

- 学术声誉: 谷歌作为全球AI领域的领头羊,其研究院发布的论文向来被视为行业风向标。此次卷入“学术不端”或“刻意隐瞒”的争议,对其科研公信力是一次重大打击。

- 市场理性: 事件也暴露了资本市场对AI新技术消息的过度敏感和脆弱性,单一未经同行评审完全核实(或存在争议)的论文即可引发百亿级的市值波动。

- 中国学者的崛起: 此次事件中,中国学者不仅提出了技术挑战,还坚持要求获得应有的学术名誉,展示了中国在AI基础研究领域日益增长的话语权和维权意识。