北大团队改造DeepSeek注意力,速度快四倍还不丢精度

背景:稀疏注意力机制面临效率瓶颈

近年来,大语言模型在处理长文本方面的需求日益增长,但传统注意力机制的计算复杂度随文本长度平方级增长,带来了巨大的效率挑战。为了缓解这一问题,DeepSeek开发了DSA(DeepSeek Sparse Attention)机制,通过对关键token进行筛选,减少计算量。

然而,DSA的索引器在处理超长文本时仍然面临瓶颈。其核心机制是逐token打分并筛选关键token,随着文本长度增加,索引器的计算开销急剧上升,成为限制模型推理效率的重要因素。

HISA:分层索引稀疏注意力机制

北大张牧涵团队提出的HISA(Hierarchical Sparse Attention),本质上是对DSA索引器的优化升级。其核心创新在于:

- 分块处理:将长文本划分为固定大小的字符块(例如每块128个字符),每个块生成一个整体特征向量作为“标签”;

- 分层筛选:先筛选出关键块,再在块内部筛选关键token,大幅减少需计算的token数量;

- 边界保留机制:强制保留第一个和最后一个文本块,确保模型能捕捉到上下文中的起始背景和最新信息,避免因文本拼接导致的边界问题。

这种设计在不改变原有注意力计算逻辑的前提下,实现了对DSA的等价替换,相当于“换了一个更高效的筛子”。

性能提升显著,精度无明显损失

HISA在实际部署中展现出显著的效率优势:

- 在DeepSeek-V3.2和GLM-5等主流模型上测试,64K长度文本处理速度提升2倍以上;

- 在更长的文本(如128K或1M)场景下,提速最高可达3.75倍;

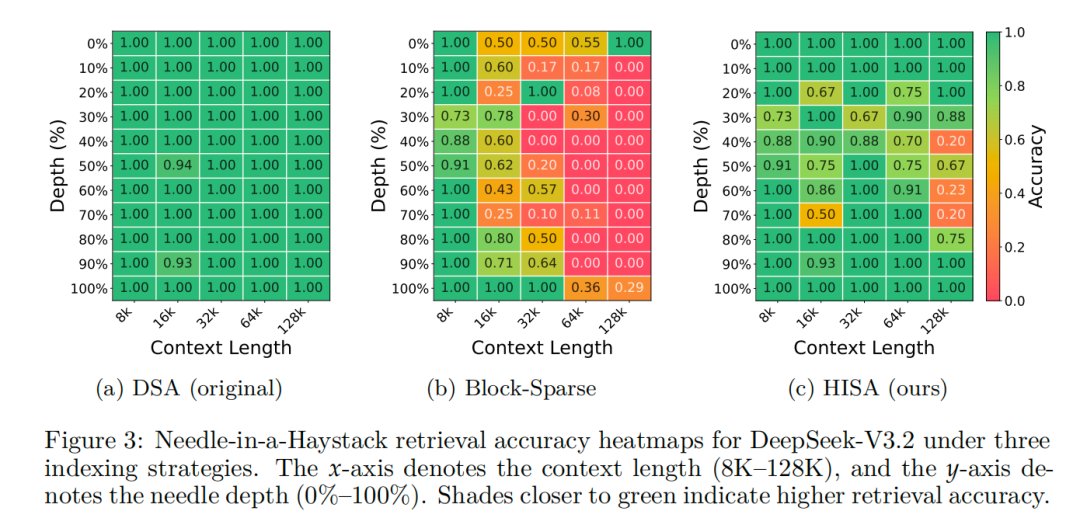

- 在“大海捞针”测试中,模型仍能精准检索到长文本中的关键信息;

- LongBench基准测试显示,HISA与DSA在精度上基本持平,无显著差异;

- 超参数实验也表明,HISA在不同块大小和选块数量下表现稳定。

这一成果使得超长文本处理在现实应用中更加高效,兼顾了推理速度与准确性。

技术细节:自适应与成本优化

HISA的优化机制不仅提升了速度,也具备良好的自适应性:

- 短文本自动退化:当文本较短时,HISA自动回归到原始注意力机制,无需触发分块处理;

- 计算成本优化:通过分块策略,将索引器的计算复杂度从O(L²)降至O(L²/B + L×m×B),其中B为块大小,m为关键块数量,从而大幅降低计算压力;

- 潜在改进空间:论文也指出当前固定块大小可能导致块内信息混杂,未来可能引入动态分块机制进一步优化。

团队与未来展望

本研究由北京大学张牧涵团队主导完成。张牧涵回国前曾在Meta AI从事大规模图学习系统的研究,Google Scholar引用量超13000次,是全球前2%顶尖科学家。论文共同一作包括徐宇飞和孟繁续。

随着大模型向更长上下文和更高效率演进,HISA的提出为未来模型推理系统提供了新的优化思路。下一步,团队计划在更多模型架构中验证HISA的通用性,并探索其在多模态任务中的应用潜力。