谷歌突破性算法震惊硅谷

在周二举行的一场备受瞩目的发布中,谷歌展示了一项名为TurboQuant的突破性AI算法,声称其能将大型语言模型的运行内存需求大幅削减,同时在性能上提升显著。这一消息迅速在硅谷和华尔街引发地震,迫使市场重新评估当前如火如荼的AI基础设施投资热潮,特别是对存储芯片的长期需求预期。

超高效压缩:不止于效率

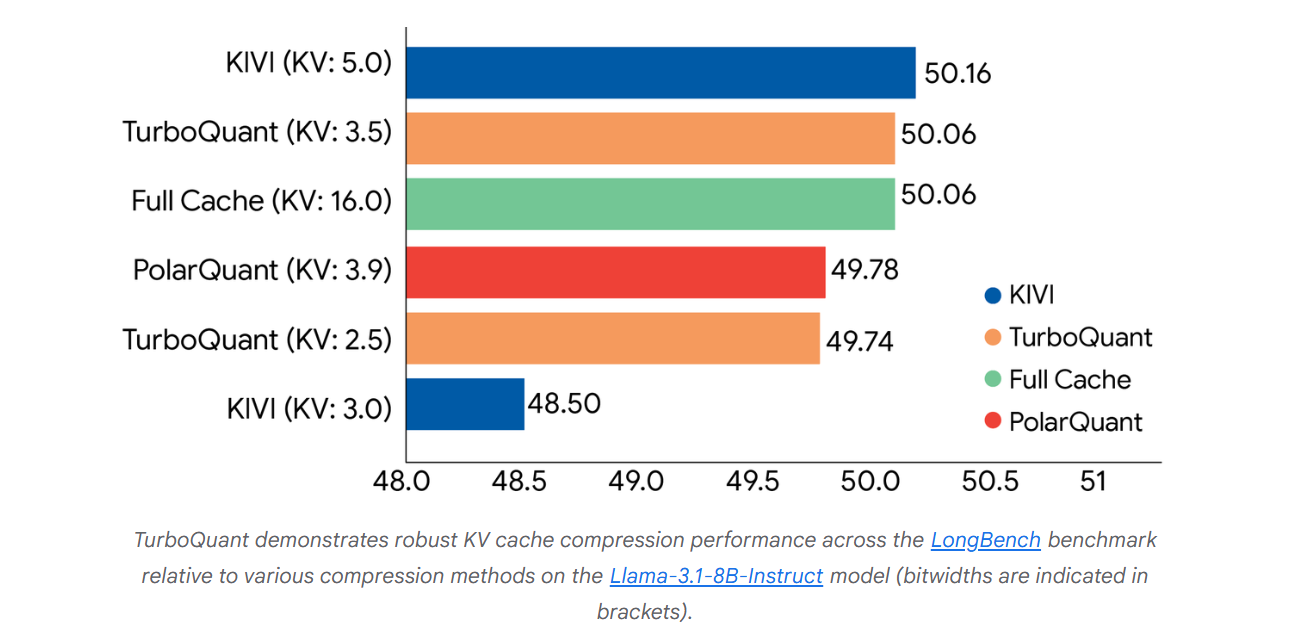

谷歌宣称,TurboQuant的核心魔力在于它能够在不损失任何准确性的前提下,将大型语言模型运行时的键值缓存(KV Cache)内存占用至少减少6倍,并将性能提升8倍。这本质上意味着人工智能模型可以在占用极小内存空间的同时,“记住”更长的上下文信息。谷歌在一份官方博文中详细介绍了实现这一目标的两个关键步骤:

- 高质量压缩(PolarQuant方法): 算法首先随机旋转数据向量,这一巧妙步骤简化了数据的几何结构,使得标准的高质量量化器可以轻松应用于向量的每一部分。该阶段利用大部分压缩能力保留了原始向量的核心概念和特征。

- 消除隐藏误差: 随后,TurboQuant利用仅1比特的剩余压缩能力,通过QJL算法处理第一阶段遗留的微小误差。QJL充当数学误差检查器,消除了偏差,从而获得更准确的注意力评分。

谷歌在开源模型(如Gemma和Mistral)上进行了严格的基准测试,结果显示TurboQuant在点积失真和召回率方面均达到最优性能,同时最大程度地减少了内存占用。

市场震荡与“DeepSeek时刻”

受此消息影响,全球存储芯片股在周三和周四遭遇了剧烈抛售。美股市场上,闪迪(Sandisk)一度暴跌6.5%,美光科技下跌4%,西部数据和希捷科技分别下跌超过4%和5%。亚洲市场紧随其后,SK海力士和三星电子也分别下跌了4.42%和3.02%。

这种市场反应可以被理解为对传统硬件扩张逻辑的质疑。Cloudflare首席执行官Matthew Prince甚至将这一时刻比作“DeepSeek时刻”,认为它有望像DeepSeek一样,通过极高的效率收益大幅降低AI的运行成本,同时保持竞争力。他在社交媒体上写道:“在速度、内存使用、功耗和利用率方面,AI推理还有很大的优化空间。”

这一算法的出现,让许多人联想到美剧《硅谷》中虚构公司Pied Piper的情节——一个开发出近乎无损压缩算法的创业公司改变了行业格局。现实中,谷歌的TurboQuant似乎正在扮演类似的角色,被视为给过热的内存需求降温的潜在“杀手锏”。

华尔街激辩:是降温还是悖论?

然而,对于TurboQuant是否真的会降低内存需求,华尔街分析师们展开了激烈的辩论,观点出现了明显的两极分化。

看空派:技术被夸大,影响有限

Lynx Equity Strategies分析师KC Rajkumar提出了质疑,他认为TurboQuant的“颠覆性”可能没有媒体描述的那么夸张。Rajkumar指出,谷歌所谓的“8倍性能提升”是基于与老旧的32-bit模型对比得出的,而当前的推理模型实际上早已广泛采用4-bit量化数据,因此实际的性能提升幅度并没有那么惊人。

看多派:杰文斯悖论下的效率陷阱

摩根士丹利的分析师则提出了更为复杂的观点。他们指出,TurboQuant技术仅作用于推理阶段的键值缓存,并不影响模型权重占用的HBM(高带宽内存),也与训练任务无关。因此,这并非意味着存储总需求或硬件总量直接减少6倍,而是通过效率提升增加了单GPU的吞吐量。

更重要的是,摩根士丹利援引了经济学中的“杰文斯悖论”(Jevons Paradox)来解释为何内存需求不会降温。该悖论指出,技术进步提高了资源使用效率,往往会导致资源消耗总量的增加,而非减少。就像瓦特改良蒸汽机提高了煤炭燃烧效率,结果却引发了煤炭需求的飙升一样。DeepSeek的例子已经证明了这一点:效率的提升反而促进了AI应用的普及,进而推高了硬件需求。

结论:效率革命还是需求前奏?

谷歌TurboQuant算法的发布无疑标志着AI效率优化的一个重要里程碑。它展示了在不牺牲模型能力的情况下大幅压缩内存占用的可能性,为在边缘设备和现有硬件上运行更强大的模型打开了大门。

然而,关于其对宏观经济和硬件需求的最终影响,目前尚无定论。是会像蒸汽机改良那样引发更高层次的需求爆发(杰文斯悖论),还是真的能让疯狂扩张的硬件军备竞赛暂时冷却?华尔街的激辩才刚刚开始,而随着AI技术的不断演进,答案或许很快就会揭晓。