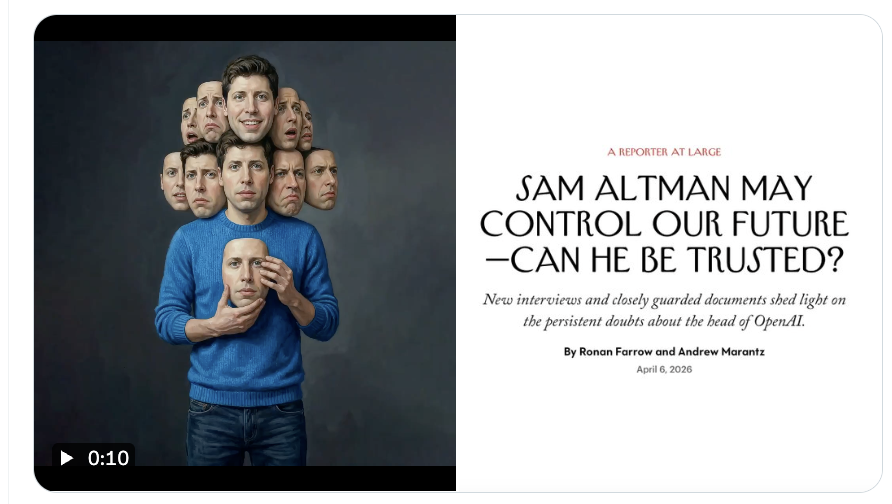

Ilya曝光70页OpenAI绝密文件

背景:理想与现实的裂痕

Ilya Sutskever,作为OpenAI的联合创始人和前首席科学家,在公司早期曾是技术与伦理信念的坚定支持者。2019年,他甚至为联合创始人Greg Brockman主持婚礼,并安排机械手担任捧环人,象征着人机协作与信任的统一。

然而,随着OpenAI模型能力接近临界点,尤其是向商业化的加速转型,Ilya开始质疑公司核心价值观是否正在被侵蚀。他系统整理了长达70页的材料,其中包括Slack聊天记录、内部文件、偷拍视频和“阅后即焚”的消息,试图揭示CEO Sam Altman的行为问题与公司治理隐患。

核心指控:撒谎成性与权力失控

根据《纽约客》披露的内容,Ilya的备忘录中指出,从OpenAI董事会到微软高管层,对Sam Altman的核心评价惊人一致:撒谎成性。

-

长期隐瞒与操控信息

Altman多次修改对外公告内容,职位描述也频繁更改,甚至在关键时刻直接删除原始文本。内部员工认为他习惯性隐瞒关键信息,缺乏透明与诚信。 -

宫斗细节曝光

在2023年被董事会突然解雇后,Altman并未束手就擒,而是在其豪宅中迅速搭建“拯救Altman”临时指挥部,通过资本、员工与舆论三线并进,最终迫使董事会屈服。 -

联名信与The Blip事件

几乎全体员工签署支持Altman回归的联名信,临时接任CEO的Mira Murati也最终倒戈。这场被称为The Blip(短暂失常)的宫变,成为硅谷最具戏剧性的公司治理事件之一。

安全承诺瓦解:SuperAlignment边缘化

The Blip事件之后,OpenAI的变化远不止CEO职位的复辟,而是安全机制的逐步失效。

-

算力削减

OpenAI曾承诺将20%的算力用于长期安全研究,尤其是AGI的超级对齐(SuperAlignment)方向。但在事件后,该比例骤降至1%-2%,且分配的是最老的计算集群和最差的芯片。 -

安全团队被边缘化

SuperAlignment团队逐渐失去影响力,其工作被其他业务线绕开。安全承诺在商业压力下变得名存实亡,原本用于限制权力的制度被不断削弱。 -

标语的语义异化

办公区中“Ilya”最初用于警示AGI风险的标语“Feel the AGI”,在事件后被重新解读为对未来通用人工智能的兴奋与期待,象征着安全意识的淡化。

深层影响:科技公司治理的警示

这场由70页文件引发的震动,不仅仅是个人诚信问题的揭发,更是AI时代公司治理的典型案例。

-

治理机制失效

OpenAI最初以非营利机构起家,后转为有限营利结构。理想主义的“安全第一”承诺在现实资本运作下逐步让位,暴露出组织架构与激励机制的冲突。 -

资本 vs 使命

在The Blip事件中,微软和关键投资方Thrive Capital等直接介入,表明在AI发展到关键阶段时,资本意志往往压倒组织初衷。董事会在多方压力下失去独立性,最终导致治理失衡。 -

历史预警未被重视

Dario A开心版ei(后为Anthropic CEO)在200多页私人笔记中也指出OpenAI治理隐患。他与Ilya得出相似结论:问题根源在于Altman本人。但这些预警在事件前未引起足够重视。

后续反应:官方的回应与戏剧性同步

曝光备忘录的《纽约客》记者在社交平台X上表示,当他们试图采访“研究AI生存风险”的研究员时,OpenAI官方仅回应称“我们不能对此置评”。

更具讽刺意味的是,在这篇调查文章发布后仅数小时,OpenAI“恰好”宣布启动一项新的AI安全研究项目。外界普遍认为这是为了平息舆论风暴的公关策略。

结语

Ilya曝光的70页绝密文件不仅揭示了Sam Altman长期存在的诚信问题,也反映了AI企业在技术发展与商业目标之间面临的深层矛盾。在超级智能时代来临之际,如何在高速扩张中保持安全与治理的底线,依然是科技界亟需正视的挑战。