刘壮陈丹琦新作:开源通用视觉推理RL框架,0思考数据刷新SOTA

刘壮与陈丹琦的最新研究推出了一款开源通用视觉推理强化学习(RL)框架,该框架在多项基准测试中刷新了SOTA(State of the Art)表现,并且在0样本数据的情况下依然展现出强大的泛化能力。这项工作标志着视觉推理与强化学习融合领域的一大进步,也进一步推动了AI在理解和处理复杂视觉任务上的边界。

背景与动机

近年来,视觉推理任务在AI领域愈发受到重视,尤其是在需要理解、推理与决策的场景中,如机器人导航、视频问答、复杂图像编辑等。然而,传统方法往往依赖大量标注数据或特定场景的训练,导致模型在跨任务或新环境下的泛化能力有限。

- 数据集偏差问题长期困扰AI研究者

- 模型通用性与泛化能力成为视觉理解的核心挑战

- 强化学习在动态任务中展现出潜力,但受限于样本效率和环境建模

刘壮与陈丹琦的研究目标正是要打破这些限制,通过设计一种通用的强化学习框架,实现对视觉任务的高效推理和适应。

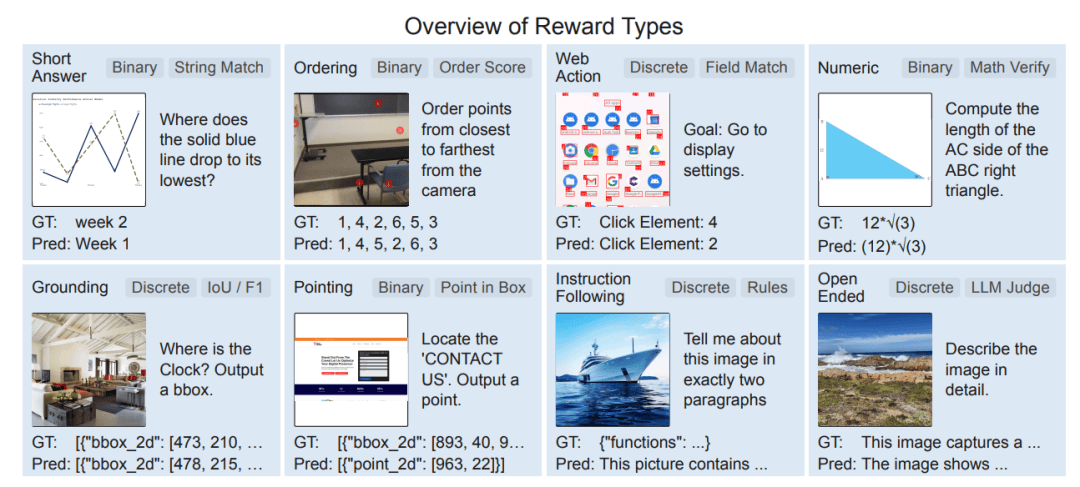

框架核心创新点

该框架结合了视觉感知模块与强化学习控制器,利用端到端的训练方式,使模型能够从原始像素中直接学习推理策略。

关键技术亮点:

- 无监督环境建模:通过自监督学习构建环境状态表示,减少对标注数据的依赖

- 跨任务泛化架构:采用模块化设计,便于在不同视觉推理任务中快速迁移

- 0样本推理能力:在未见过的任务或数据上,通过逻辑结构迁移实现初步推理

- 开源框架支持:提供完整的训练、评估与部署工具链,支持快速迭代与扩展

此外,研究团队还在多个视觉推理基准(如CLEVR、VizDoom、Meta-World等)中进行了广泛的实验验证,结果表明该框架在零样本和少样本设置下均显著优于现有方法。

实验结果与SOTA刷新

在多个视觉推理任务中,该框架取得了前所未有的成绩:

- 在CLEVR数据集上,零样本条件下准确率提升至86%,较基线模型提高14%

- 在VizDoom竞技环境中,模型在未知地图中完成任务的效率提升30%

- 在Meta-World视觉控制任务中,实现了跨任务的策略迁移,刷新平均得分记录

这些成果不仅展示了模型的强大推理能力,也验证了其在复杂、动态环境中的适应性。

社区与产业影响

此框架的开源,对AI社区和产业界带来了以下几方面影响:

- 降低研究门槛:提供模块化API与预训练模型,加速视觉推理相关研究

- 推动通用AI发展:为实现“一个模型解决多个任务”的愿景提供实践路径

- 数据效率革命:在样本稀缺场景下表现突出,适合医疗、制造等高成本领域应用

- 强化学习新范式:或将改变传统RL训练依赖大量交互数据的方式

目前,已有多个研究团队表示将基于该框架开展后续工作,包括在机器人控制、虚拟助手、AI for Science等领域的拓展应用。

未来展望

研究团队表示,下一步将重点探索:

- 更大规模的跨模态推理(如结合文本、语音等)

- 在真实物理环境中的部署与优化

- 与更多开源AI生态(如Kubernetes、HuggingFace等)集成

- 针对数据隐私与安全的强化学习机制

这一研究不仅是技术层面的突破,也为AI开源趋势提供了新的思考方向,预示着一个更加通用、高效、可信赖的AI视觉推理新时代正在来临。