蚂蚁灵波开源大规模空间感知数据集

蚂蚁灵波近期在机器人空间感知领域迈出了重要一步,正式开源了其空间感知模型LingBot-Depth及相关资源。这一举措不仅包含了模型代码与检查点,更重磅推出了大规模、高质量的真机数据集,旨在解决机器人视觉中的传统痛点,特别是针对透明和反光物体的抓取难题,为机器人从“看懂”到“做到”提供了强有力的技术底座。

核心开源资源:全链路开放与海量数据

此次开源的核心亮点在于其“全链路”的开放策略,不仅提供了模型算法,还配套了极具价值的训练数据:

- 代码与检查点:开发者可以直接获取并部署LingBot-Depth的模型代码及预训练权重,快速进行二次开发与验证。

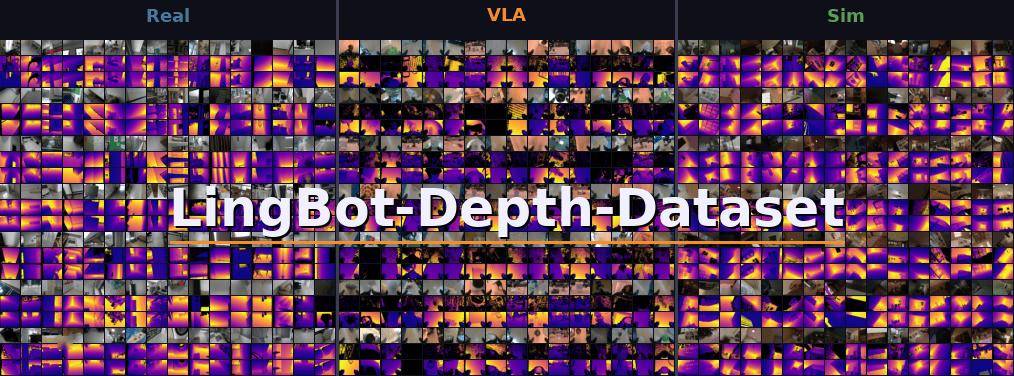

- 大规模RGB-D数据集:计划近期开源总计300万个RGB深度对(RGB-D pairs)。

- 数据构成:其中包含200万个真实的采集数据和100万个高质量的合成数据。

- 开源意义:这种真实与合成相结合的数据策略,既保证了数据的丰富性,又通过合成数据填补了特定场景下的采集空白,为模型泛化能力的提升提供了坚实基础。此举或将进一步倒逼RGB-D相机行业的技术革新与标准统一。

数据规模与质量:从“看懂”到“做到”的基石

为了确保模型在实际应用中的高精度与强泛化能力,蚂蚁灵波在数据采集上投入了巨大精力:

- 真机操作时长:数据集基于约2万小时的来自9种主流双臂机器人的实机操作数据。

- 场景真实性:这是目前最大规模的“真刀真枪”机器人操作数据集之一。

- 核心优势:

- 拟真性:直接来源于真实机器人作业,避免了纯仿真与现实的“Sim-to-Real”鸿沟。

- 高精度:海量的数据覆盖了各种细微的操作场景,确保模型能够精确理解深度信息。

- 强泛化:多样化的机器人本体和作业环境,使得模型能够适应不同的物理硬件和应用场景。

技术底座:与奥比中光的深度联合

LingBot-Depth模型优异表现的背后,离不开底层硬件的强力支持。

- 专用硬件适配:该模型基于奥比中光 Gemini 330系列双目3D相机 提供的芯片级原始数据进行构建。

- 主要目标:专注于提升环境深度感知与三维空间理解能力。

- 赋能领域:旨在为机器人、自动驾驶汽车等智能终端提供更精准的“视觉眼睛”,特别是在处理复杂环境光和特殊材质物体时。

行业影响:解决透明反光难题,定义视觉新标准

此次开源不仅仅是技术的展示,更是对行业痛点的精准打击。

- 攻克难点:LingBot-Depth主攻 透明反光物体抓取 这一大难题。在传统视觉方案中,透明和高反光物体往往导致深度估计失效,而LingBot-Depth通过算法优化有效解决了这一问题。

- 生态构建:通过联合奥比中光打造新一代深度相机,蚂蚁灵波构建起了从“看(感知)”到“做(操作)”、从算法到硬件的完整闭环。

- 推动发展:全链路开源将降低行业门槛,加速机器人视觉技术的迭代,推动整个具身智能领域向着更加开放、高效的方向发展。