千元机跑Gemma 4实测:生成一次要5分钟,本地AI注定是旗舰专属

背景介绍:Gemma 4 的发布与本地运行的尝试

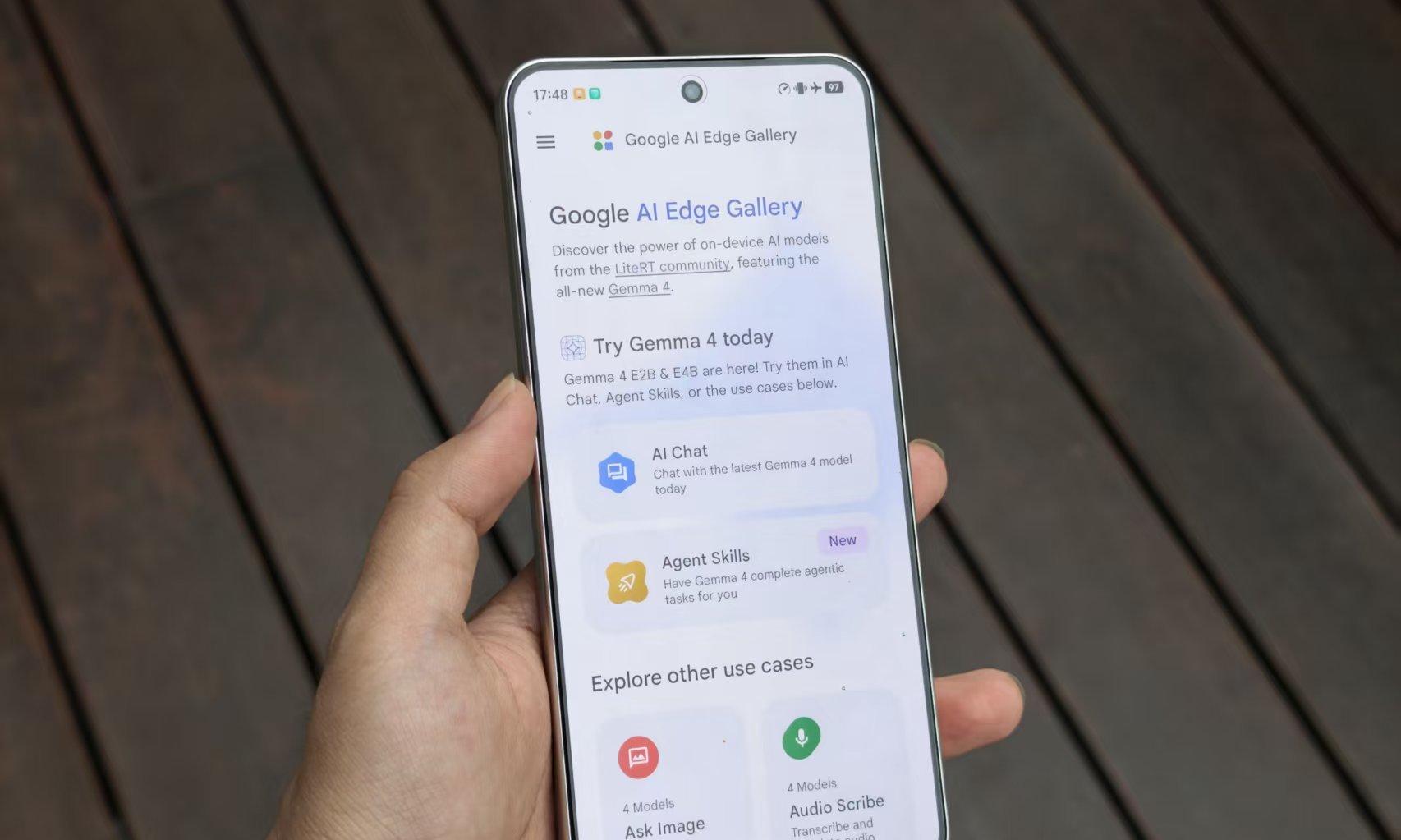

谷歌近期推出的 Gemma 4 模型是其开源AI模型系列中的最新成员,宣称具备多模态能力,在本地设备上即可运行。这引发了不少AI爱好者的兴趣,特别是希望在非旗舰设备上体验本地大模型推理能力的用户。

许多开发者和用户开始尝试在不同性能等级的设备上运行 Gemma 4,以评估其在移动端或低端硬件上的可行性。其中,千元机作为典型的入门级智能手机,成为测试本地AI运行能力的代表设备。

实测详情:千元机运行 Gemma 4 的性能表现

在实际测试中,用户尝试将 Gemma 4 部署到一款典型的千元机设备上,设备配置一般包括中低端处理器(如高通骁龙4系列或联发科Helio G系列)、4GB内存及普通存储芯片。

以下是实测中的主要表现:

- 推理速度缓慢:生成一次中等长度的回答(约100词)耗时接近5分钟。

- 资源占用高:运行期间CPU和内存几乎满载,系统响应明显迟滞。

- 发热严重:设备在运行过程中温度显著升高,风扇型手机或平板表现略好。

- 无法流畅交互:由于延迟过高,对话体验极差,不适合即时问答或连续交互。

这些现象表明,尽管 Gemma 4 在理论上可以在本地运行,但千元机的硬件限制使其实际应用几乎不可行。

性能分析:为什么本地AI依然依赖旗舰机?

本地运行AI模型的关键在于设备的计算能力和内存带宽。旗舰机型通常配备高性能NPU或GPU(如骁龙8 Gen系列、苹果A/M系列芯片),而千元机在这方面几乎不具备优势。

以下是影响Gem4运行效率的几个关键因素:

- 算力差距大:旗舰机的AI算力可达数千亿次运算每秒(TOPS),而千元机普遍低于100 TOPS。

- 内存带宽限制:Gem4在运行时需要频繁读写内存,千元机的低速内存无法满足高吞吐需求。

- 软件优化不足:目前移动端AI框架尚未对Gem4做充分优化,导致推理效率较低。

- 模型量化问题:未经过充分量化压缩的Gem4对低端设备而言仍过于庞大。

因此,尽管Gem4是“轻量级”大模型,其本地运行仍严重依赖高性能硬件,千元机的体验难以达到实用标准。

行业影响:本地AI平民化仍需时日

Gemma 4 的实测结果揭示了一个现实:本地AI模型的运行体验目前仍局限在旗舰设备上。这与当前AI行业推动“AI去云端化”、“隐私优先”的趋势看似相悖。

然而,这一现象也带来了几个启示:

- 模型轻量化仍需推进:未来的本地AI发展必须依赖更高效的模型结构与量化技术。

- 设备AI芯片需求上升:手机厂商或需在中低端机型中加强AI专用芯片的配置。

- 开源模型普及仍需时间:虽然Gemma 4开源,但真正让大众使用仍需等待模型优化和硬件升级。

未来展望:千元机能否跑动大模型?

尽管当前千元机运行 Gemma 4 的表现不尽如人意,但未来并非没有希望。随着以下几方面的发展:

- 模型压缩技术进步:量化、剪枝、蒸馏等技术不断优化,未来可让大模型更轻便。

- AI芯片逐步下放:中低端设备逐渐搭载专用AI协处理器,提升推理效率。

- 社区持续优化支持:开源社区可能推出适配低端设备的定制版本或运行环境。

- 硬件迭代更新:新一代千元机可能具备更强算力,缩小与旗舰机的差距。

因此,虽然“本地大模型人人可用”目前尚不现实,但技术演进终将带来改变。

结语

Gem4 的千元机实测结果再次证明,本地大模型运行仍处于“旗舰机专属”阶段。不过,随着技术的不断演进与硬件升级,AI本地化有望逐步下放到更多普通用户群体,真正实现普惠智能体验。