推理提速15倍、成本直降95%!北大系创企端出4B模型,叫板DeepSeek-V3.2

近期,AI大模型领域的价格战与技术革新愈演愈烈。就在DeepSeek宣布其V3.2版本并大幅降价、引发行业震荡之际,一家被称为“北大系”的AI创企——面壁智能(开心版elBest),突然投下了一枚重磅炸弹。

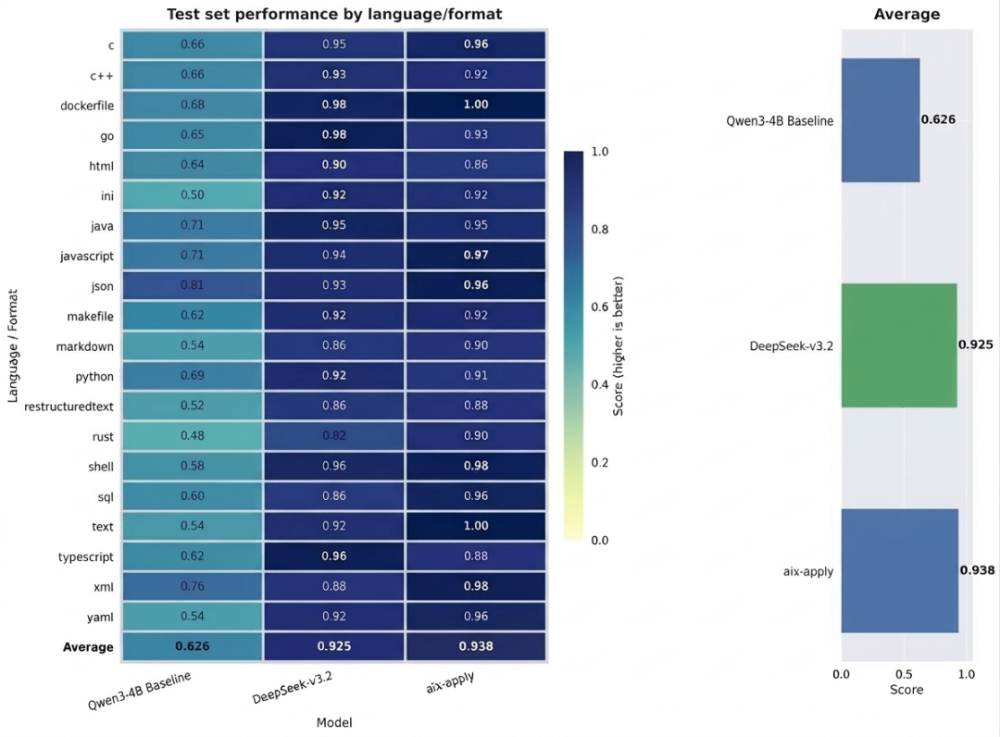

他们发布了名为MiniCPM 3.0(简称MiniCPM-3)的4B参数规模模型,在推理效率和成本控制上实现了惊人突破。在官方公布的测试数据中,该模型在处理长文本和复杂任务时,推理速度较上一代提升高达15倍,推理成本更是直降95%。

这一举动被业内视为直接叫板包括DeepSeek-V3.2在内的大模型厂商。虽然DeepSeek-V3.2通过稀疏注意力机制(DSA)降低了成本,但面壁智能用极致的“小模型+高效率”策略,展示了另一种技术路径的威力:不盲目堆参数,而是从底层架构和算法上榨干每一分算力的潜能。

极致性价比:小模型如何实现大超越?

面壁智能此次推出的MiniCPM-3,核心卖点在于“以小博大”。尽管参数量仅有4B(40亿),但在多项基准测试中,其表现不仅超越了同量级的LLaMA2-7B,甚至在部分任务上逼近了GPT-3.5级别的模型。

这背后的秘诀在于面壁智能深耕的“端侧智能”技术。与云端模型不同,端侧模型对推理延迟和功耗极为敏感。MiniCPM-3通过以下技术实现了质变:

- 推理提速15倍: 利用独家的LLMxMapReduce技术框架,将长文本处理任务进行动态切分与并行处理,大幅缩短了首字输出时间(Time to First Token)。

- 成本直降95%: 这不仅是因为模型体积小,更得益于极致的量化技术。MiniCPM-3支持在主流消费级显卡甚至高端PC端流畅运行,极大地降低了企业部署AI服务的硬件门槛和API调用成本。

挑战DeepSeek:开源生态下的效率之战

此次面壁智能的出击,恰逢DeepSeek刚刚发布V3.2实验版并开源稀疏注意力架构。DeepSeek以其强大的长文本处理能力和低廉的API价格著称,被认为是目前性价比最高的云端大模型之一。

然而,面壁智能的策略似乎意在“釜底抽薪”。如果说DeepSeek是将云端推理成本打下来,那么面壁智能则是试图让AI“烧”在用户的电脑和手机上。

- 场景差异: DeepSeek-V3.2更适合需要强大算力支持的云端复杂任务;而MiniCPM-3则主打私有化部署和边缘计算,解决了数据隐私和网络延迟的痛点。

- 行业影响: 面壁智能此举进一步拉低了AI落地的门槛。对于中小企业和个人开发者而言,不再必须依赖昂贵的云端API,一个4B的模型足以完成大多数日常办公和辅助写作任务。

AI降本增效成为行业主旋律

2024年以来,AI行业似乎陷入了“击穿底价”的怪圈。从DeepSeek的545%理论利润率引发行业争议,到面壁智能将端侧模型成本降至地板价,核心逻辑只有一个:降本增效。

用户不再为“参数大”买单,而是为“效果好、跑得快、花钱少”投票。

- 云端与边缘的博弈: DeepSeek证明了云端可以通过架构优化实现高利润率;面壁智能则证明了边缘端通过极致优化,也能提供堪比大模型的服务。

- 技术普惠: 无论是DeepSeek的开源周,还是面壁智能的端侧突破,都在推动AI技术的普惠。当推理成本不再是制约因素,AI应用的爆发将比预期来得更快。

目前,MiniCPM-3已全面开源,开发者可以直接下载并在本地部署。在DeepSeek掀起的巨浪之下,面壁智能这艘“轻舟”能否凭借极致的效率逆袭,值得整个行业关注。